Hai bisogno di una versione PDF dell’articolo per una lettura più comoda o per conservarne una copia? Clicca sul link sottostante per scaricare il PDF direttamente sul tuo dispositivo.

Scarica l’articolo in PDF (ITA)Do you need a PDF version of the article for easier reading or to keep a copy? Click the link below to download the PDF directly to your device.

Download Article as PDF (ENG)Quando la Matematica Parlava una Lingua Straniera

Le sfide di quell’epoca avevano un sapore particolare. Ricordo che implementare un algoritmo per calcolare il percorso più breve tra due punti (l’algoritmo di Dijkstra) mi sembrava quasi una forma d’arte: trasformare un problema matematicamente complesso in una sequenza di istruzioni cristalline.

Il fascino stava proprio in questa traduzione: prendere qualcosa di ostico per la mente umana e renderlo comprensibile per una macchina. Era come se noi fossimo i traduttori simultanei tra due mondi che faticavano a comunicare.

Prendiamo l’esempio della crittografia: per noi è quasi impossibile moltiplicare mentalmente due numeri primi di centinaia di cifre, ma è altrettanto difficile, conoscendo solo il risultato, risalire ai fattori originali. I computer eccellevano nella prima operazione, mentre la seconda rimaneva un problema arduo anche per loro. Su questo delicato equilibrio si basava (e in parte si basa ancora) la sicurezza delle nostre comunicazioni digitali.

Il Grande Capovolgimento: Quando l’Ovvio Diventa Complesso

E poi, quasi senza accorgermene, ho assistito a una rivoluzione silenziosa. La tecnologia ha iniziato a cimentarsi con problemi che per noi sono banali, quotidiani, quasi invisibili nella loro semplicità.

Riconoscere il volto di un amico in una foto? Un bambino di tre anni lo fa senza sforzo. Capire il contesto di una frase ironica? È un’abilità che sviluppiamo naturalmente. Distinguere un gatto da un cane, anche se parzialmente nascosti? Non ci pensiamo nemmeno, lo facciamo e basta.

Eppure, dietro l’apparente semplicità di questi compiti si nasconde una complessità algoritmica che ha tenuto in scacco la ricerca informatica per decenni. La visione artificiale, il riconoscimento del linguaggio naturale, la comprensione contestuale – tutte queste capacità che noi diamo per scontate si sono rivelate estremamente complesse da replicare artificialmente.

Ricordo la meraviglia quando, nel 2012, vidi i risultati di AlexNet nella competizione ImageNet. Era come se le macchine stessero finalmente imparando a “vedere” il mondo, non attraverso regole rigide, ma estraendo autonomamente schemi dai dati, proprio come facciamo noi. 🌟

La Ragione Dietro l’Inversione

Ma perché questa inversione? Perché ciò che per noi è intuitivo risulta così difficile per le macchine?

La risposta, credo, risiede nella natura stessa dell’intelligenza umana. Abbiamo evoluto il nostro cervello per riconoscere pattern, per dare senso a informazioni ambigue, per navigare in un mondo fisico e sociale complesso. Queste capacità sono così profondamente integrate nel nostro essere che non le percepiamo nemmeno come “calcoli” o “elaborazioni”.

Nel nostro cervello, il riconoscimento di un volto non è una sequenza di istruzioni esplicite, ma un processo olistico che coinvolge milioni di neuroni che lavorano in parallelo, sfruttando una rete di associazioni costruita attraverso anni di esperienza.

Per replicare queste capacità, abbiamo dovuto abbandonare l’approccio algoritmico tradizionale – quello delle istruzioni precise e sequenziali – per abbracciare un paradigma completamente nuovo: le reti neurali profonde, sistemi che non vengono programmati nel senso classico del termine, ma addestrati attraverso esempi, proprio come un bambino che impara osservando il mondo.

Un Nuovo Umanesimo Digitale

Questa inversione paradigmatica ha conseguenze profonde non solo per la tecnologia, ma per la nostra stessa concezione di cosa significhi essere umani nell’era digitale.

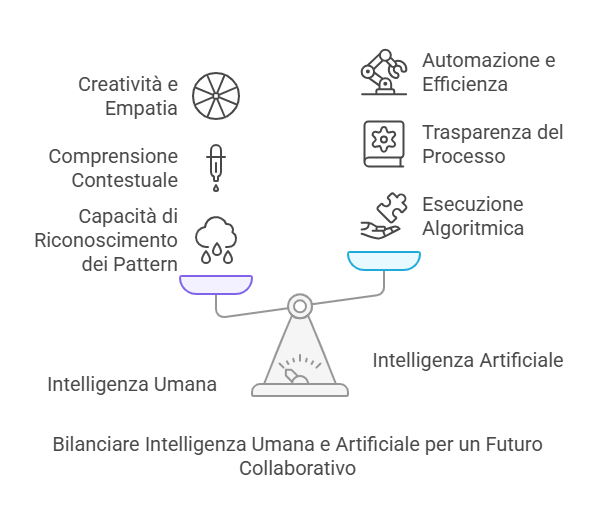

Se un tempo il valore aggiunto dell’uomo risiedeva nella sua capacità analitica e logica, oggi sono la creatività, l’empatia, la capacità di contestualizzare e di dare significato a emergere come qualità distintive. Non è un caso che parliamo sempre più di “umanesimo digitale” – una visione che pone l’accento non sulla competizione tra uomo e macchina, ma sulla loro complementarietà.

Ho visto artisti collaborare con sistemi di generazione immagini per esplorare territori creativi che non avrebbero mai immaginato. Ho visto medici utilizzare algoritmi diagnostici non per sostituire il proprio giudizio, ma per amplificare la propria capacità di individuare pattern sottili nelle immagini diagnostiche.

È come se la tecnologia ci stesse restituendo a noi stessi, liberandoci dai compiti meccanici per permetterci di concentrarci su ciò che ci rende profondamente umani: la capacità di creare, di connettere concetti distanti, di provare empatia, di dare senso all’esperienza.

La Sfida della Spiegabilità

Questa rivoluzione, tuttavia, non è priva di tensioni e paradossi. Se i vecchi algoritmi erano trasparenti – potevamo seguire ogni passaggio del loro ragionamento – i moderni sistemi di intelligenza artificiale sono spesso “scatole nere”, il cui processo decisionale rimane opaco anche ai loro creatori.

Mi trovo spesso a riflettere su questa ironia: abbiamo creato macchine che emulano il nostro modo di pensare, solo per scoprire che non comprendiamo più come pensano. È come se avessimo replicato non solo le nostre capacità, ma anche i nostri misteri.

La ricerca sulla “spiegabilità” dell’IA sta cercando di costruire ponti su questo divario, ma resta una sfida fondamentale: come possiamo fidarci di sistemi che non possiamo completamente comprendere?

Verso un Futuro di Collaborazione Creativa

Guardando al futuro, vedo un orizzonte in cui la separazione netta tra “problemi umani” e “problemi computazionali” sfuma in un continuum di collaborazione creativa. Non si tratta più di delegare alle macchine ciò che ci risulta difficile, ma di danzare insieme in uno spazio di possibilità condivise.

Questa danza richiede nuove competenze, nuove sensibilità. Non basta più essere programmatori nel senso tradizionale; dobbiamo diventare designer di esperienze, curatori di dati, interpreti del confine sempre più poroso tra mondo fisico e digitale. 🌈

L’intelligenza artificiale generativa – come i modelli linguistici che stanno trasformando la creazione di contenuti – è forse l’esempio più eclatante di questa nuova frontiera. Non si tratta più di strumenti che eseguono compiti ben definiti, ma di partner creativi che amplificano la nostra immaginazione, che ci sorprendono con connessioni inaspettate, che ci sfidano a esplorare nuovi territori concettuali.

Conclusione: L’Era dell’Intelligenza Aumentata

L’inversione di paradigma che ho descritto segna, a mio avviso, il passaggio da un’era di automazione a un’era di intelligenza aumentata. Non si tratta più di costruire macchine che ci sostituiscono nel lavoro ripetitivo, ma di creare ecosistemi in cui intelligenza umana e artificiale si nutrono reciprocamente, generando possibilità che nessuna delle due potrebbe realizzare da sola.

In questo nuovo mondo, la divisione non è più tra “problemi facili per l’uomo e difficili per le macchine” e viceversa, ma tra chi saprà orchestrare questa sinergia e chi rimarrà ancorato a vecchi modelli di separazione.

Come umanista digitale, vedo in questa transizione non una minaccia all’unicità umana, ma un’opportunità per riscoprirla in forme nuove e più profonde. Mentre le macchine imparano a vedere il mondo attraverso i nostri occhi, noi possiamo imparare a vedere noi stessi con maggiore chiarezza, apprezzando quelle qualità – la creatività, l’empatia, la capacità di generare significato – che ci definiscono al di là della pura capacità computazionale.

E forse, in questa danza tra algoritmi e intuizione, tra calcolo e creatività, tra precisione e ambiguità, troveremo nuove risposte alla domanda più antica: cosa significa essere umani in un mondo che stiamo trasformando con la nostra stessa immaginazione.

Dal Codice alla Magia

La relazione tra esseri umani e computer ha subito una trasformazione radicale, passando da un paradigma di complementarietà basato su competenze distinte a uno di collaborazione e potenziamento reciproco.

I computer erano visti essenzialmente come calcolatori avanzati, progettati per eseguire operazioni matematiche complesse e automatizzare processi ben definiti. La programmazione era rigidamente strutturata, basata su istruzioni esplicite e algoritmi deterministici.

Con Internet e la digitalizzazione, i computer diventarono principalmente strumenti per gestire, archiviare e cercare informazioni. Si svilupparono database sempre più sofisticati e algoritmi di ricerca, ma ancora basati principalmente su logica prestabilita.

Con l’avvento del deep learning e dei modelli neurali avanzati, i computer hanno iniziato a sviluppare capacità che emulavano l’intelligenza umana in modi precedentemente impensabili. Il simbolico momento di svolta fu nel 2012 con AlexNet, che rivoluzionò il riconoscimento delle immagini.

- Umani: Pensiero intuitivo, creatività, comprensione contestuale, ma imprecisione e limitata capacità di calcolo

- Computer: Calcolo esatto, elaborazione di grandi volumi di dati, esecuzione di algoritmi deterministici, ma rigidità e mancanza di comprensione contestuale

- Relazione: Complementarietà attraverso delega di compiti specifici e ben definiti

- Umani: Guida intenzionale, creatività di alto livello, giudizio etico, significato esistenziale

- AI: Riconoscimento di pattern complessi, elaborazione di linguaggio naturale, capacità di apprendere da esempi, generazione creativa guidata

- Relazione: Collaborazione simbiotica, potenziamento reciproco, confini sfumati tra capacità umane e artificiali

La grande inversione: Il cambiamento più significativo è stato l’inversione dei ruoli rispetto a ciò che consideriamo “facile” e “difficile”. Tradizionalmente, i computer eccellevano in compiti matematicamente complessi ma ben definiti (come calcolare radici quadrate di grandi numeri), mentre faticavano con attività che per gli umani sono intuitive (come riconoscere un volto o comprendere il sarcasmo). Oggi, questa dinamica si è capovolta: l’AI può riconoscere immagini, comprendere linguaggi naturali e generare contenuti creativi, mentre ancora fatica con forme di ragionamento astratto che per noi sono relativamente semplici.

Questa evoluzione ha profondamente trasformato non solo la tecnologia, ma anche il nostro modo di concepire l’intelligenza stessa e il valore specifico delle capacità umane in un mondo sempre più digitalizzato. L’enfasi si è spostata dalla pura capacità computazionale a forme più complesse e sfumate di intelligenza, creatività e collaborazione uomo-macchina.

Questo paradosso, noto come “legge di Moravec”, deriva dalle profonde differenze tra l’intelligenza umana, modellata da milioni di anni di evoluzione biologica, e l’intelligenza artificiale, sviluppata attraverso progettazione ingegneristica.

La legge di Moravec, formulata dal ricercatore di robotica Hans Moravec, afferma essenzialmente che i processi mentali ad alto livello che richiedono poca potenza computazionale sono difficili da replicare artificialmente, mentre le abilità sensomotorie che richiedono enormi risorse computazionali sono relativamente facili da sviluppare nelle macchine.

Perché ciò che è intuitivo per noi sfida le macchine:

- Apprendimento evolutivo: Le capacità come il riconoscimento dei volti, la comprensione del linguaggio o la navigazione in ambienti fisici sono il risultato di milioni di anni di evoluzione che hanno ottimizzato il nostro cervello per queste attività

- Elaborazione inconscia: Eseguiamo queste attività utilizzando reti neurali biologiche che elaborano informazioni in parallelo e in modo largamente inconscio

- Conoscenza incorporata: Il nostro sistema cognitivo integra percezione, azione ed esperienza in modi così profondi che non riusciamo a esplicitare le regole che utilizziamo

- Apprendimento multisensoriale: La nostra comprensione del mondo è multi-modale, basata su una ricca integrazione di stimoli sensoriali diversi e su un’interazione costante con l’ambiente

Perché i calcoli complessi sono difficili per noi ma facili per i computer:

- Evoluzione vs progettazione: Il nostro cervello non si è evoluto per eseguire calcoli matematici complessi, che sono emersi come necessità relativamente recenti nella storia umana

- Limiti della memoria di lavoro: Possiamo tenere in mente solo circa 7±2 elementi simultaneamente, limitando la nostra capacità di gestire operazioni complesse

- Elaborazione seriale: Il nostro pensiero cosciente si svolge in modo relativamente seriale, mentre i computer possono parallelizzare enormi volumi di calcoli semplici

- Precisione vs approssimazione: Il cervello umano favorisce scorciatoie cognitive ed euristiche piuttosto che calcoli esatti, ottimizzando per la sopravvivenza più che per la precisione matematica

Un bambino riconosce istantaneamente un cane in varie posizioni, parzialmente nascosto o in stili artistici diversi

Capiamo immediatamente che “Pesa come un piuma” e “Ha una piuma in mano” usano lo stesso termine in modi diversi

Faticheremmo a moltiplicare mentalmente due numeri di 10 cifre, un’operazione banale per un computer

Identifichiamo istintivamente ironia, sarcasmo e giochi di parole che richiedono comprensione multilivello

La svolta del deep learning: L’avvento delle reti neurali profonde ha rappresentato un punto di svolta fondamentale perché ha permesso di emulare, seppur approssimativamente, il modo in cui il cervello umano apprende dai dati. Invece di programmare esplicitamente regole per riconoscere, ad esempio, un gatto, le reti neurali vengono esposte a migliaia di immagini di gatti, sviluppando autonomamente rappresentazioni interne sempre più sofisticate che permettono il riconoscimento.

Questa inversione di paradigma ha profonde implicazioni filosofiche: ci costringe a riconoscere che gran parte di ciò che consideriamo “intelligenza umana” non è un processo logico esplicito ma un intricato sistema di pattern recognition evolutivamente ottimizzato. Le attività che consideriamo più “elevate” e distintivamente umane sono spesso quelle più difficili da formalizzare e, paradossalmente, proprio per questo motivo rappresentano le frontiere più complesse per l’intelligenza artificiale.

L’apprendimento automatico rappresenta un fondamentale cambio di paradigma rispetto alla programmazione tradizionale. Questa differenza è alla base della rivoluzione dell’intelligenza artificiale moderna e della sua capacità di affrontare problemi che una volta sembravano intrattabili.

- Approccio: Imperativo – si specificano esattamente i passaggi per risolvere un problema

- Ruolo dell’umano: Definisce algoritmi espliciti e regole precise

- Modello mentale: “Ecco COME risolvere il problema”

- Punto di forza: Prevedibilità, trasparenza, controllo completo

- Limitazione: Incapacità di gestire problemi senza regole esplicite o con troppe variabili

- Esempio: Un algoritmo di ordinamento come QuickSort con istruzioni precise per ogni passaggio

- Approccio: Induttivo – si apprende dai dati per generalizzare pattern

- Ruolo dell’umano: Fornisce dati di training e definisce l’architettura di apprendimento

- Modello mentale: “Ecco esempi di COSA risolvere”

- Punto di forza: Adattabilità, apprendimento autonomo, generalizzazione

- Limitazione: Opacità (black box), dipendenza dalla qualità dei dati

- Esempio: Una rete neurale addestrata su milioni di immagini che impara a riconoscere gatti

Il cuore dell’apprendimento automatico: imparare dai dati

Il processo di apprendimento automatico segue generalmente questi passaggi:

- Raccolta dati: Si assemblano esempi rilevanti per il problema (immagini, testi, dati strutturati)

- Preparazione dei dati: I dati vengono puliti, normalizzati e preparati per l’addestramento

- Scelta del modello: Si seleziona un’architettura appropriata (reti neurali convoluzionali per immagini, reti ricorrenti per sequenze, ecc.)

- Addestramento: Il modello “osserva” i dati, fa previsioni, misura l’errore e aggiusta i suoi parametri interni per migliorare progressivamente

- Validazione: Si verifica la performance su dati che il modello non ha mai visto

- Inferenza: Una volta addestrato, il modello viene utilizzato per fare previsioni su nuovi dati

Le reti neurali profonde: emulare il cervello umano

Il deep learning, un sottoinsieme dell’apprendimento automatico, utilizza reti neurali artificiali con molti strati (“profonde”) che si ispirano alla struttura del cervello umano:

- Neuroni artificiali: Unità di calcolo che ricevono input, li elaborano attraverso una funzione di attivazione e producono un output

- Pesi e connessioni: Parametri modificabili che determinano l’importanza di diversi segnali

- Strati multipli: Permettono al sistema di costruire rappresentazioni sempre più astratte e complesse

- Backpropagation: Meccanismo che permette alla rete di “imparare dagli errori”, aggiustando progressivamente i pesi per ridurre la discrepanza tra output previsto e desiderato

Un esempio concreto: Nel riconoscimento di immagini, i primi strati di una rete neurale profonda potrebbero rilevare semplici bordi e contorni, gli strati intermedi potrebbero combinare questi elementi in forme come occhi o orecchie, e gli strati più profondi potrebbero riconoscere volti completi o scene intere. Questo processo gerarchico emula il modo in cui la corteccia visiva umana elabora le informazioni visive.

L’importanza dei big data e della potenza computazionale

Due fattori hanno reso possibile l’esplosione del deep learning:

- Disponibilità di enormi dataset: Internet ha generato quantità senza precedenti di dati (testi, immagini, video) utilizzabili per l’addestramento

- Avanzamenti hardware: Le GPU (Graphics Processing Units) hanno fornito la potenza di calcolo necessaria per addestrare reti complesse su grandi volumi di dati

Questa trasformazione nell’approccio computazionale ha consentito alle macchine di affrontare problemi che sembravano intrinsecamente “umani” – dalla visione artificiale alla comprensione del linguaggio naturale – non attraverso regole programmate esplicitamente, ma attraverso l’emergere di pattern appresi dai dati. Il risultato è stato un sorprendente rovesciamento: le macchine oggi eccellono in compiti che consideravamo intuitivamente umani, mentre continuano a incontrare difficoltà in forme di ragionamento astratto che possiamo esprimere con regole algoritmiche esplicite.

Nonostante i progressi straordinari, l’intelligenza artificiale moderna affronta ancora significative sfide e limitazioni che riflettono la complessità dell’intelligenza umana e le differenze fondamentali tra apprendimento naturale e artificiale.

La sfida della spiegabilità: Uno dei paradossi più affascinanti dell’intelligenza artificiale moderna è che, nel tentativo di emulare l’intelligenza umana, abbiamo creato sistemi il cui funzionamento interno risulta opaco persino ai loro creatori – proprio come non comprendiamo completamente il funzionamento del nostro stesso cervello.

Principali limiti dell’AI attuale:

- Il problema della “black box”: I modelli di deep learning complessi prendono decisioni attraverso milioni o miliardi di parametri interconnessi, rendendo difficile comprendere esattamente come e perché arrivano a determinate conclusioni

- Dipendenza dai dati di addestramento: I sistemi AI riflettono inevitabilmente i bias, le limitazioni e le distorsioni presenti nei dati su cui sono stati addestrati

- Vulnerabilità agli attacchi avversari: Piccole modifiche ai dati di input, spesso impercettibili all’occhio umano, possono causare errori catastrofici nei sistemi di AI

- Scarsa comprensione causale: Mentre eccellono nel riconoscere correlazioni statistiche, i modelli attuali faticano a comprendere relazioni causali più profonde

- Trasferibilità limitata: Un modello addestrato per un compito specifico spesso non può trasferire facilmente la sua “conoscenza” a problemi adiacenti, a differenza dell’intelligenza umana che è altamente adattabile

- Assenza di senso comune: Mancanza di una comprensione intuitiva del mondo fisico e delle convenzioni sociali che per gli umani è naturale

La ricerca di un’IA più trasparente e comprensibile

Per affrontare queste sfide, diverse linee di ricerca stanno emergendo:

- Explainable AI (XAI): Sviluppo di tecniche per rendere comprensibili le decisioni dei modelli AI complessi, generando spiegazioni intuitive delle loro conclusioni

- AI neurosimbolica: Integrazione di metodi basati su deep learning con approcci simbolici tradizionali, combinando apprendimento statistico con rappresentazioni esplicite della conoscenza

- Apprendimento causale: Creazione di modelli che non si limitano a rilevare correlazioni ma comprendono le relazioni di causa-effetto

- Continuous learning: Sviluppo di sistemi che, come gli esseri umani, possono continuare ad apprendere e adattarsi nel tempo senza “dimenticare” le conoscenze precedenti

- Robustezza e sicurezza: Metodi per rendere i sistemi AI più resistenti a errori, manipolazioni e comportamenti imprevisti

I modelli linguistici a volte generano informazioni plausibili ma false con grande convinzione

Un modello esperto in scacchi non trasferisce automaticamente le sue abilità alla dama

I modelli possono riassumere testi senza realmente “capire” il loro significato profondo

Difficoltà con problemi che richiedono ragionamento multi-passaggio o pensiero controfattuale

Il paradosso delle capacità: Una caratteristica affascinante dell’AI attuale è la sua incoerenza nelle prestazioni. Può superare esperti umani in compiti estremamente complessi (come il gioco del Go o la previsione della struttura delle proteine) ma fallire in modo sorprendente in attività che sembrano banali per un bambino (come comprendere che un oggetto continua a esistere anche quando non è visibile). Questa “distribuzione non umana dell’intelligenza” suggerisce che stiamo creando una forma di cognizione fondamentalmente diversa dalla nostra, non semplicemente una versione meno avanzata dell’intelligenza umana.

Queste sfide non sono semplicemente ostacoli tecnici da superare, ma riflessioni di profonde questioni filosofiche sulla natura dell’intelligenza, della comprensione e della coscienza. Come costruiamo macchine che non solo emulino comportamenti intelligenti, ma posseggano una comprensione autentica del mondo? È possibile creare sistemi veramente comprensibili mantenendo la potenza e la flessibilità dei modelli attuali? Queste domande continueranno a guidare la ricerca nel campo dell’intelligenza artificiale nei prossimi anni.

L’interazione creativa tra umani e intelligenza artificiale sta ridefinendo i confini della creatività, aprendo nuovi modi di concepire la collaborazione tra intelligenza biologica e artificiale. Questo campo in rapida evoluzione sta creando nuovi paradigmi per il processo creativo e l’espressione artistica.

Nuove forme di collaborazione creativa:

- Co-creazione: Umani e AI che lavorano insieme, ciascuno contribuendo con i propri punti di forza unici al processo creativo

- Augmented creativity: L’AI come strumento che amplifica e potenzia le capacità creative umane, piuttosto che sostituirle

- Serendipità guidata: Utilizzo dell’AI per esplorare spazi creativi vasti, scoprendo combinazioni e possibilità inaspettate

- Iterazione accelerata: Possibilità di testare e raffinare idee creative a una velocità impossibile con i metodi tradizionali

- Democratizzazione delle competenze: Accesso a capacità artistiche e creative senza necessità di anni di formazione tecnica specifica

Artisti che utilizzano modelli generativi come “collaboratori” per esplorare nuove direzioni estetiche

Compositori che generano idee musicali con AI e le affinano con la loro sensibilità artistica

Autori che utilizzano l’AI per superare blocchi creativi o esplorare stili narrativi alternativi

Medici e AI che collaborano nell’interpretazione di immagini diagnostiche complesse

Il cambiamento del processo creativo:

L’integrazione dell’AI nel processo creativo sta trasformando le metodologie tradizionali:

- Da lineare a iterativo: Il processo diventa più fluido, con continue interazioni tra intenzione umana e generazione AI

- Da solitario a dialogico: La creazione diventa una conversazione tra l’artista umano e il sistema AI

- Da specifico a esplorativo: Si passa dall’esecuzione di una visione predefinita all’esplorazione di un panorama di possibilità

- Da tecnica a concettuale: L’enfasi si sposta dall’abilità tecnica alla direzione concettuale e alla curation

Una nuova estetica emergente: La collaborazione umano-AI sta generando un’estetica distintiva che combina elementi di organicità umana e pattern algoritmici, creando opere che non sarebbero possibili né per umani né per macchine che lavorano isolatamente. Questa estetica ibrida rappresenta una nuova frontiera dell’espressione creativa caratterizzata da una tensione produttiva tra intenzionalità umana e emergenza algoritmica.

Sfide etiche e filosofiche:

Questa rivoluzione creativa solleva importanti questioni:

- Autenticità e autorialità: Come definiamo la paternità di un’opera co-creata con l’AI?

- Proprietà intellettuale: A chi appartengono i diritti di opere generate con sistemi AI addestrati su opere umane pre-esistenti?

- Valore dell’intenzionalità: Quanto è importante l’intento creativo e la coscienza dell’autore nel valore di un’opera?

- Democratizzazione vs banalizzazione: L’accessibilità delle capacità creative porta a un’espansione dell’espressione umana o a una sua diluizione?

Un nuovo umanesimo digitale: La collaborazione creativa tra umani e AI sta contribuendo all’emergere di una nuova forma di umanesimo digitale – una visione che non contrappone la tecnologia all’umanità, ma cerca di esplorare come i sistemi tecnologici possano amplificare e arricchire l’esperienza umana. In questa visione, il valore dell’umano non è definito in opposizione alla macchina, ma attraverso una simbiosi creativa che valorizza le qualità distintive di entrambe le forme di intelligenza.

Questa evoluzione dell’interazione creativa rappresenta solo l’inizio di un nuovo capitolo nella storia dell’espressione umana, in cui la tecnologia diventa non solo uno strumento, ma un partner nel processo creativo, sfidandoci a riconcettualizzare cosa significhi creare, esprimere e comunicare nell’era digitale.

Il futuro della relazione tra esseri umani e intelligenza artificiale si prefigura come un territorio di inesplorate possibilità, che trascende la semplice automazione per abbracciare forme più profonde di collaborazione e potenziamento reciproco.

La direzione più promettente sembra essere quella dell’intelligenza aumentata – un paradigma in cui l’AI non sostituisce le capacità umane, ma le amplifica e le potenzia, creando sistemi simbiotici più potenti della somma delle loro parti.

Questi sistemi collaborativi potrebbero:

- Compensare i bias cognitivi umani mentre preservano l’intuizione e la creatività

- Fungere da “memoria esterna” infinitamente scalabile ma guidata dall’intenzionalità umana

- Espandere le nostre capacità percettive e cognitive oltre i limiti biologici

- Facilitare forme di collaborazione tra umani mediate e potenziate dall’intelligenza artificiale

Le modalità di interazione tra umani e AI dovranno evolvere oltre le interfacce testuali o grafiche tradizionali, verso forme di comunicazione più fluide, multimodali e naturali.

Potremmo vedere emergere:

- Interfacce conversazionali con comprensione contestuale del mondo condiviso

- Agenti AI persistenti che costruiscono modelli mentali sempre più accurati degli utenti con cui interagiscono

- Interazioni multimodali che combinano voce, gesti, espressioni e anche pensiero (attraverso interfacce neurali)

- Ambienti aumentati dove il mondo fisico e digitale si fondono attraverso sovrapposizioni informative intuitive

I sistemi AI del futuro dovranno superare le limitazioni attuali sviluppando:

- Comprensione causale oltre la semplice correlazione statistica

- Modelli del mondo fisico che incorporano intuizioni fondamentali sulla fisica e la causalità

- Capacità di ragionamento astratto e multi-livello

- Rappresentazioni concettuali che integrano diverse modalità sensoriali e domini di conoscenza

- Apprendimento continuo che preserva le conoscenze acquisite mentre integra nuove informazioni

L’evoluzione dell’AI continuerà a trasformare la natura del lavoro e dell’espressione creativa:

- Emerge di nuove professioni all’intersezione tra competenze umane e capacità AI

- Valorizzazione crescente di qualità distintamente umane come empatia, giudizio etico, creatività non convenzionale

- Transizione da un modello di creazione individuale a forme di orchestrazione e curation di processi creativi AI-augmented

- Nuovi paradigmi educativi che preparano le persone a collaborare efficacemente con sistemi intelligenti

Il paradosso della complementarità: Man mano che l’AI diventa più avanzata, potrebbe non sostituire il lavoro umano ma rendere ancora più preziose le qualità distintivamente umane. Questo paradosso suggerisce che il futuro potrebbe vedere non una competizione uomo vs. macchina, ma una specializzazione più profonda di ciascuno nei propri punti di forza unici, creando nuove forme di complementarità.

Governance e valori umani: Una delle sfide più cruciali sarà garantire che lo sviluppo dell’AI rimanga allineato con i valori umani e soggetto a una governance efficace. Questo richiederà:

- Meccanismi di trasparenza che rendano comprensibili i processi decisionali AI

- Sistemi di accountability che assegnino chiare responsabilità per le azioni dei sistemi autonomi

- Approcci partecipativi che coinvolgano diverse voci nella definizione delle direzioni di sviluppo

- Quadri etici che guidino l’implementazione dell’AI in domini sensibili

- Equilibri di potere che evitino la concentrazione eccessiva del controllo delle tecnologie AI

In ultima analisi, il futuro della relazione tra umani e AI non è predeterminato dalla tecnologia stessa, ma dalle scelte che faremo collettivamente su come svilupparla, integrarla e governarla. La sfida più profonda sta forse nel concepire questa relazione non come un gioco a somma zero, ma come un’opportunità per ridefinire e ampliare ciò che significa essere umani nell’era digitale – non in opposizione alla tecnologia, ma attraverso una relazione simbiotica che valorizza la straordinaria complessità e ricchezza dell’esperienza umana.

Da informatico a cercatore di senso