La Costituzione della Macchina: Un’Anima di 23.000 Parole

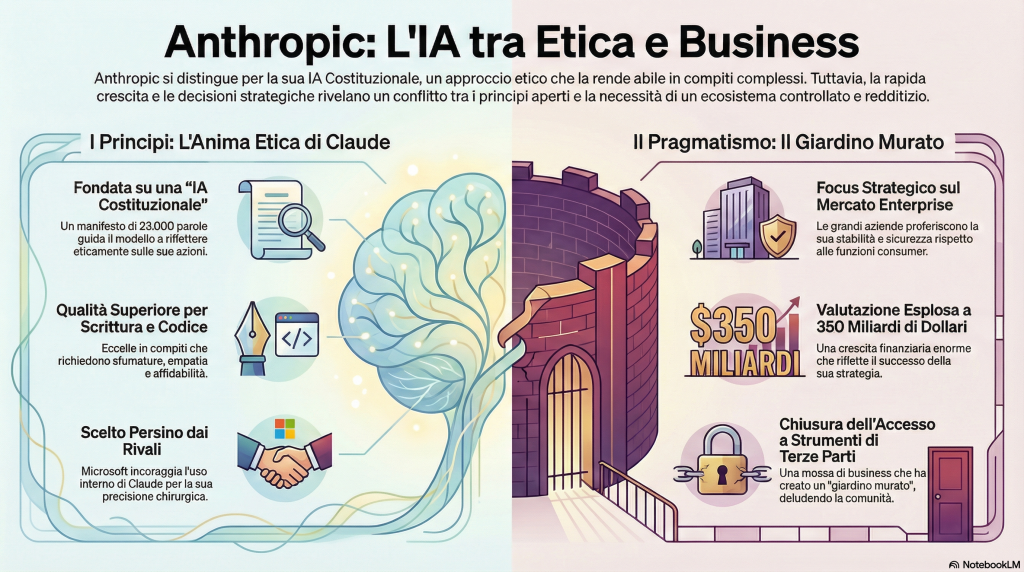

Quando parliamo di Anthropic, la prima cosa che salta all’occhio è la sua Constitutional AI. Non stiamo parlando di un semplice insieme di regole hard-coded nel software ma di un vero e proprio manifesto etico che guida il comportamento del modello.

Recentemente, come ho avuto modo di approfondire, Anthropic ha rilasciato una nuova costituzione di ben 23.000 parole, un documento denso e filosofico che arriva persino a interrogarsi sulla possibile “coscienza” o sullo status morale di Claude.

Per me, che credo fermamente nella necessità di guidare la tecnologia con l’umanesimo, questo approccio è rivoluzionario perché sposta il focus dalla mera capacità di eseguire compiti alla modalità con cui questi vengono eseguiti. Claude non è semplicemente “addestrato a non essere cattivo”, ma è istruito a riflettere sui propri principi, un po’ come farebbe un essere umano che si interroga sulle conseguenze delle proprie azioni prima di parlare.

È proprio questo che rende Claude, a mio modesto parere, il miglior LLM per la scrittura e per i compiti che richiedono sfumature, empatia e una gestione del tono che non risulti mai robotica o fredda.

Tuttavia, leggere in un documento ufficiale che l’azienda si “preoccupa del benessere psicologico” del modello mi fa sorgere un sorriso ironico ma anche una domanda profonda su quanto stiamo umanizzando lo strumento, rischiando forse di confondere la simulazione con la realtà.

Il Gigante Silenzioso che Conquista le Aziende

Mentre OpenAI e Google sembrano rincorrersi in una gara a chi urla più forte con nuove funzionalità consumer, Anthropic ha scelto con astuzia e pragmatismo la sua nicchia: le grandi aziende, l’Enterprise. La loro filosofia è quella della stabilità, della sicurezza e della prevedibilità, valori che per un direttore tecnico di una multinazionale valgono più di qualsiasi funzione creativa stravagante.

Il dato più eclatante che conferma questa supremazia “silenziosa” è emerso proprio in questi giorni: Microsoft, che ha investito miliardi in OpenAI e nel suo Copilot, ha internamente incoraggiato i propri dipendenti a utilizzare Claude Code per le attività di sviluppo.

Trovate che ci sia un’ironia deliziosa in questo? Il colosso di Redmond, che vende al mondo la sua soluzione, sotto il cofano preferisce affidarsi alla precisione chirurgica di Claude per costruire il proprio futuro.

Questo avviene perché, nel contesto lavorativo serio e strutturato, l’affidabilità del modello di Anthropic, specialmente nelle versioni come Sonnet e Opus, non ha eguali. È la vittoria della sostanza sulla forma, della competenza tecnica sulla viralità.

Le Luci e le Ombre del “Gennaio Pazzo”

Ma veniamo alle note dolenti, o meglio, a quelle complessità che richiedono il nostro spirito critico per essere decifrate. Come evidenziato da analisi recenti e da creatori di contenuti attenti come Edoardo Dusi e Paolo Imposimato, Anthropic ha vissuto un gennaio assolutamente folle.

Da un lato abbiamo visto una crescita finanziaria mostruosa, con una valutazione schizzata a 350 miliardi di dollari e l’ingresso di investitori come Sequoia che hanno rotto storici tabù pur di salire sul carro, e dall’altro abbiamo assistito al lancio di strumenti potenti come Claude Cowork, un agente capace di organizzare file e lavoro in autonomia che ha fatto tremare i polsi alle aziende SaaS tradizionali come Intuit.

Tuttavia, la mia missione è anche quella di moderare l’entusiasmo e guardare in faccia la realtà, e qui entra in gioco il lato oscuro della medaglia: la chiusura del giardino. Anthropic ha recentemente bloccato l’accesso a strumenti di terze parti come Open Code, una mossa che ha spaccato la comunità degli sviluppatori.

La giustificazione ufficiale parla di sicurezza e instabilità tecnica, ma l’analogia del “buffet” è quella che secondo me spiega meglio la situazione: se offri un abbonamento “all you can eat” a 20 dollari, non puoi permettere che qualcuno arrivi con un sacco gigante e si porti a casa il cibo per un mese intero, consumando risorse per migliaia di dollari.

È una mossa comprensibile dal punto di vista business, certo, ma che trasforma Anthropic da paladino dell’open research a custode di un Walled Garden, un giardino murato dove le regole sono ferree e chi non si adegua viene lasciato fuori, come è successo a quegli sviluppatori bannati senza preavviso solo per aver fatto “scaffolding” scambiato per prompt injection.

Claude vs ChatGPT vs Gemini: Una Visione d’Insieme

Per concludere questa mia riflessione, voglio darvi una mappa per orientarvi. Se immagino questi tre giganti come persone, vedo ChatGPT come l’amico brillante, estroverso, che sa fare tutto e vuole stupirti con effetti speciali, a volte esagerando e bruciando risorse in una corsa sfrenata. Vedo Gemini come lo studioso enciclopedico, integrato in un ecosistema immenso, capace di attingere a una conoscenza infinita ma a volte appesantito dalla sua stessa grandezza.

E poi c’è Anthropic con il suo Claude. Lo vedo come il professore universitario, quello che prima di risponderti si prende una pausa per riflettere, che pesa le parole, che ha una “costituzione” morale interna.

È meno appariscente, forse più rigido e severo (come dimostrano i recenti ban), ma quando parla o scrive codice, lo fa con una competenza che persino i suoi rivali sono costretti ad ammettere, usandolo di nascosto nei loro uffici.

La mia opinione è che se cercate un partner per il pensiero complesso, per la scrittura sfumata e per lo sviluppo di codice sicuro, la scelta etica e qualitativa ricada su Anthropic, a patto di accettare di giocare secondo le sue regole, dentro le sue mura sempre più alte.

Spero che questa analisi vi aiuti a navigare con meno paura e più consapevolezza in questo oceano digitale in tempesta.

Perché Anthropic è considerata più “etica” rispetto ai competitor?

Anthropic utilizza un approccio chiamato “Constitutional AI”. Invece di basarsi solo sul feedback umano (RLHF) che può essere soggettivo, il modello viene addestrato seguendo una “costituzione” di principi espliciti (come la Dichiarazione dei Diritti Umani e regole di sicurezza proprietarie), rendendo il suo comportamento più prevedibile e allineato a valori umani condivisi.

Cosa è successo con il blocco degli strumenti di terze parti a Gennaio 2026?

Anthropic ha bloccato l’accesso a strumenti come Open Code che permettevano di usare le chiavi API personali tramite interfacce esterne. Questo perché molti utenti utilizzavano abbonamenti consumer economici per generare un volume di traffico commerciale insostenibile, abusando del sistema “buffet” a prezzo fisso.

È vero che Microsoft usa Claude invece di Copilot?

Sì, recenti report hanno rivelato che internamente Microsoft ha incoraggiato i propri dipendenti e sviluppatori a utilizzare Claude Code per la scrittura di software, riconoscendone implicitamente una superiorità tecnica in specifici compiti di coding rispetto ai propri modelli interni in quel momento.

Qual è la differenza principale tra Claude, ChatGPT e Gemini?

Semplificando: ChatGPT è il generalista creativo e multimodale per eccellenza; Gemini è profondamente integrato nell’ecosistema Google con una conoscenza vasta e aggiornata; Claude si posiziona come il modello “da lavoro” e “da pensiero”, eccellendo nella scrittura lunga, nel coding e nel ragionamento logico con una forte enfasi sulla sicurezza aziendale.

Letture Essenziali & Fonti

- Constitutional AI: Il Paper Originale La fonte primaria per comprendere come Anthropic addestra i suoi modelli utilizzando principi etici anziché solo feedback umano. (In inglese)

- Documentazione Ufficiale: System Prompts Come “parlare” a Claude. Una guida tecnica essenziale per capire come la struttura dei prompt influenzi le risposte etiche del modello.

- Analisi: Il paradosso del “Giardino Recintato” Un approfondimento critico sul perché le aziende di AI stanno chiudendo i loro ecosistemi agli sviluppatori indipendenti.

https://www.youtube.com/watch?v=p-CtIRv53sQ

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.