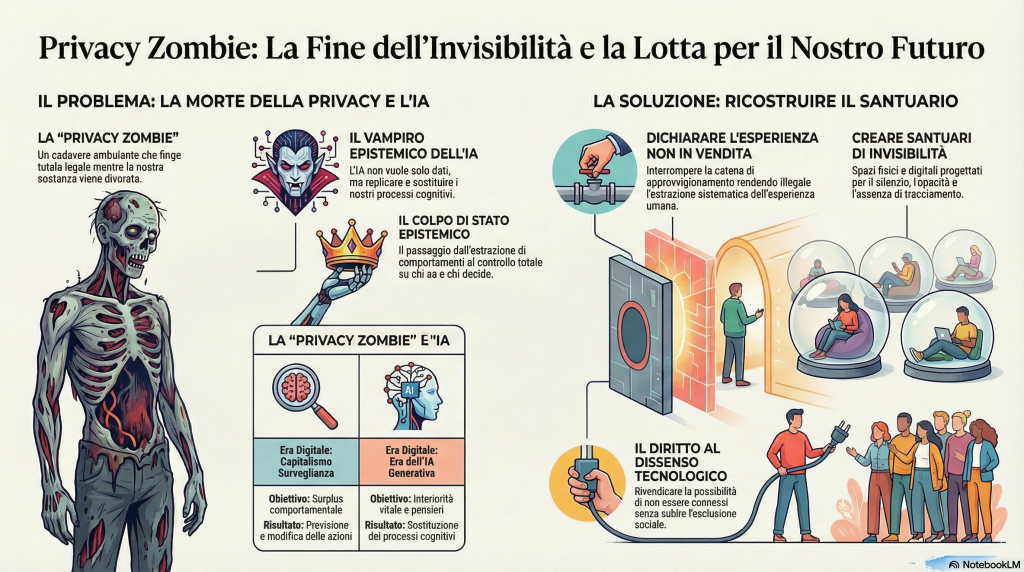

“La privacy è stata estinta. Ora è uno zombie.”

Non è un’iperbole. È la descrizione clinica della nostra realtà. Camminiamo convinti che quel cadavere ambulante che chiamiamo “privacy” sia ancora vivo solo perché ogni tanto gli diamo una scossa elettrica cliccando su “Accetta tutto” o firmando moduli GDPR che nessuno legge. Ma la verità, quella che Zuboff ci urla da anni e che oggi, nell’era dell’Intelligenza Artificiale pervasiva, è diventata assordante, è che il concetto stesso di vita privata è stato svuotato dall’interno.

Siamo diventati “materiale grezzo”. E i nuovi macchinari che ci lavorano non sono più solo algoritmi predittivi: sono intelligenze generative affamate della nostra stessa essenza.

Il Grande Furto: Come abbiamo perso il diritto al nostro futuro

Ricordo quando lessi per la prima volta Il capitalismo della sorveglianza. Fu come ingoiare la pillola rossa di Matrix. Zuboff ci spiegava che le grandi tech company non volevano solo i nostri dati per mostrarci pubblicità; volevano il surplus comportamentale. Volevano prevedere le nostre azioni per modificarle, per spingerci dolcemente verso risultati redditizi per i loro clienti.

Ma oggi, nel 2026, la situazione si è evoluta in modo ancora più grottesco. La privacy-zombie di cui parla Zuboff è un guscio vuoto perché le leggi che dovrebbero proteggerci (come il GDPR o le normative USA) spesso regolano il come i dati vengono gestiti, ma non mettono in discussione la legittimità del furto originale.

Il peccato originale di questa economia è l’idea che l’esperienza umana sia “gratis”. Che la mia voce, il tuo viso, i nostri pensieri scritti su un forum, le nostre paure confessate a un motore di ricerca, siano res nullius, cose di nessuno, pronte per essere estratte, impacchettate e vendute. La privacy è morta perché l’economia digitale non può sopravvivere se noi siamo davvero privati. Deve mangiarci. E come uno zombie, continua a camminare tra noi, fingendo di essere una tutela legale mentre la sostanza è stata divorata.

L’Intelligenza Artificiale: Il Vampiro Epistemico

Se la privacy è uno zombie, l’Intelligenza Artificiale Generativa è il vampiro che si nutre del suo sangue residuo. Zuboff ha recentemente sottolineato come l’IA non sia una rottura col passato, ma l’evoluzione finale del capitalismo della sorveglianza.

Fino a pochi anni fa, Google o Facebook volevano sapere cosa avresti comprato. Oggi, le IA vogliono sapere come pensi per poter replicare, assistere, e infine sostituire processi cognitivi interi. Siamo passati dall’estrazione comportamentale al colpo di stato epistemico.

Chi decide chi sa? Chi decide chi decide?

Queste domande risuonano nella mia testa da ingegnere e da umanista. Quando usiamo un assistente AI, stiamo barattando la nostra “interiorità vitale” — quel luogo sacro dove nascono i pensieri prima di diventare parole — per un po’ di comodità. Zuboff lo chiama “furto”, io lo chiamo esproprio dell’anima digitale. Le aziende sanno che se avessero chiesto il permesso esplicitamente (“Possiamo ascoltare tutto ciò che dici per addestrare un modello che poi venderemo?”), avremmo detto di no. Quindi lo hanno fatto in segreto, rendendo l’inaccettabile inevitabile.

L’IA di oggi vive in una “prigione di sorveglianza senza sbarre”. Non possiamo uscirne perché l’uscita non esiste più. La vita sociale, lavorativa ed economica richiede la partecipazione a questi sistemi. La privacy-zombie ci saluta dall’uscio, ma non può farci uscire.

Quali sono le quattro fasi dell’epistemic coup secondo Zuboff?

Quando ho letto per la prima volta la descrizione che Shoshana Zuboff fa del colpo di stato epistemico, ho sentito quel brivido che si prova quando qualcuno mette in parole qualcosa che sentivi confusamente da anni. Nel lessico di Zuboff, l’epistemic coup non è un evento improvviso, un putsch digitale che accade da un giorno all’altro, ma un processo subdolo e progressivo articolato in quattro fasi che descrive come i capitalisti della sorveglianza si appropriano del potere di definire che cosa può essere conosciuto, da chi e a quali condizioni.

In un saggio del 2021, Zuboff ha cristallizzato questo processo con una chiarezza che fa male, perché una volta letto non puoi più fingere di non vedere. Lascia che ti accompagni attraverso queste quattro fasi, perché riconoscerle significa già iniziare a resistervi.

Prima fase: Appropriazione dei diritti epistemici

Immagina di svegliarti una mattina e scoprire che qualcuno ha deciso, senza chiederti nulla, di avere il diritto esclusivo di sapere tutto di te. Non un governo eletto democraticamente, non un’istituzione pubblica sottoposta a controllo, ma aziende private che si arrogano il diritto di raccogliere, possedere e sfruttare informazioni sulla tua vita come se fosse la cosa più naturale del mondo.

Nessuno le ha elette. Nessuno le ha autorizzate politicamente. Eppure si comportano come se avessero un diritto naturale, quasi divino, a trasformare ogni frammento della tua esperienza umana in dati proprietari. Ogni ricerca che fai, ogni luogo che visiti, ogni conversazione che sussurri vicino al telefono diventa loro proprietà intellettuale, materia prima da raffinare e rivendere.

Questa è la prima fase: il furto silenzioso del diritto a sapere. E il bello, se così possiamo chiamarlo, è che è avvenuto senza colpo ferire, nascosto dietro termini e condizioni che nessuno legge e che comunque non potremmo rifiutare senza autoescluderci dalla vita moderna.

Seconda fase: Disuguaglianza epistemica

Qui le cose si fanno davvero inquietanti. Si crea un abisso tra ciò che tu sai di te stesso e ciò che può essere inferito su di te attraverso la cattura e l’elaborazione digitale dei dati. Le piattaforme arrivano a sapere più di te di quanto tu stesso sappia, costruendo profili, previsioni e categorie che ti sfuggono completamente.

Sanno che sei incinta prima che tu lo dica a tua madre. Sanno che stai per lasciare il tuo lavoro prima che tu abbia preso una decisione consapevole. Sanno quali sono le tue vulnerabilità psicologiche, i tuoi momenti di debolezza, le tue paure non confessate. E tu? Tu non sai nulla di tutto questo. Non puoi vedere il tuo profilo ombra, non puoi contestare le inferenze, non puoi nemmeno sapere quali decisioni vengono prese su di te sulla base di queste conoscenze asimmetriche.

È come vivere in una casa di vetro mentre tutti gli altri hanno il binocolo, e tu sei l’unico a non avere uno specchio. Questa disuguaglianza epistemica non è un bug del sistema, è la sua caratteristica fondamentale: più loro sanno e meno tu sai, più potere hanno e meno ne hai tu.

Terza fase: Caos epistemico

Se le prime due fasi riguardavano l’estrazione e l’accumulo di conoscenza, la terza fase riguarda la frammentazione della realtà stessa. Attraverso il micro-targeting algoritmico e la personalizzazione estrema dei contenuti, si frantuma la realtà condivisa, si avvelena il discorso pubblico e si paralizza la politica democratica.

È la fase in cui proliferano polarizzazione, disinformazione e odio, perché ognuno di noi abita in una bolla informativa diversa, cucita su misura per massimizzare coinvolgimento e profitto. Tu vedi un mondo, io ne vedo un altro completamente diverso, e non c’è più un terreno comune su cui incontrarci per discutere razionalmente.

Il caos epistemico non è un effetto collaterale indesiderato, è il carburante che alimenta l’engagement. Più siamo confusi, arrabbiati, spaventati, più clicchiamo, condividiamo, reagiamo. E più reagiamo, più dati produciamo, più valore estraiamo per le piattaforme. È un circolo vizioso perfetto che sta letteralmente distruggendo la possibilità stessa di una democrazia funzionante.

Quarta fase: Istituzionalizzazione della governance computerizzata

L’ultima fase è la più spaventosa perché è quella in cui tutto questo si cristallizza, diventa normale, inevitabile. Le logiche algoritmiche e le infrastrutture digitali diventano l’ossatura stessa della governance sociale, economica e politica. Invece di essere strumenti al nostro servizio, gli apparati computazionali diventano il livello invisibile che struttura le nostre possibilità di azione, scelta e conoscenza.

Non decidiamo più noi cosa vedere, cosa sapere, con chi parlare. Sono gli algoritmi a decidere per noi, in base a criteri opachi ottimizzati per obiettivi che non sono i nostri. E quando provi a resistere, scopri che non puoi: trovare un lavoro senza LinkedIn, organizzare un evento senza Facebook, comunicare senza WhatsApp è diventato praticamente impossibile.

La governance computerizzata non ti chiede il permesso, non si presenta alle elezioni, non risponde davanti a nessun parlamento. Semplicemente si installa, strato dopo strato, finché non riesci più a immaginare un’alternativa.

Il colpo di stato è già avvenuto

Queste quattro fasi, considerate insieme, descrivono il passaggio da una società che usa la tecnologia a una società governata da chi controlla le infrastrutture di conoscenza digitale. E la cosa più terrificante? Il colpo di stato è già avvenuto. Non è una minaccia futura, è la nostra realtà presente.

In questo senso, l’Intelligenza Artificiale contemporanea non è che l’ultima accelerazione di un processo iniziato molto prima che i modelli generativi diventassero di moda. ChatGPT, Gemini, Claude non sono l’inizio di qualcosa di nuovo, sono l’apoteosi di un sistema estrattivo che ha passato vent’anni a perfezionare l’arte di trasformare gli esseri umani in dati.

E ora che il colpo di stato è completo, ora che la governance computerizzata è istituzionalizzata, la domanda non è più “come evitiamo che accada?”, ma “come riprendiamo il controllo di ciò che abbiamo perso?”.

Come Differisce il Capitalismo della Sorveglianza da Quello Tradizionale

Un Salto Evolutivo, Non un Semplice Aggiornamento

Quando Shoshana Zuboff parla di capitalismo della sorveglianza, non sta semplicemente descrivendo una versione digitale del capitalismo che conosciamo. Sta documentando una mutazione profonda, quasi genetica, che ha trasformato le regole del gioco in modi che i nostri nonni non avrebbero mai potuto immaginare. È come se il capitalismo avesse imparato a nutrirsi di una risorsa completamente nuova: non più solo il nostro lavoro o il nostro denaro, ma la nostra stessa esistenza interiore.

Your Attractive Heading

Nel capitalismo tradizionale, le fabbriche sfruttavano risorse tangibili: il ferro estratto dalle miniere, il cotone raccolto nei campi, le braccia degli operai che trasformavano materia grezza in prodotti finiti. Era uno sfruttamento brutale, visibile, misurabile. Potevi vedere le mani callose, sentire il rumore delle macchine, contare le ore di lavoro.

Nel capitalismo della sorveglianza, ciò che viene estratto è molto più sottile e invasivo: la tua esperienza vissuta. Ogni volta che esiti prima di cliccare, ogni pausa mentre scrivi un messaggio, ogni battito accelerato del cuore catturato dal tuo smartwatch, ogni sguardo che indugia su un’immagine mentre scorri il feed. Non sfruttano più solo il tuo corpo o il tuo tempo di lavoro: sfruttano il modo in cui pensi, senti, desideri, hai paura.

È come se avessero scoperto che dentro ognuno di noi c’è una miniera infinita di comportamenti, emozioni e intenzioni, e avessero deciso di scavarla senza chiedere permesso.

Il Rapporto con le Popolazioni: Da Lavoratori a Prede

Il capitalismo industriale, per quanto ingiusto, aveva bisogno di te in modo visibile. Eri il lavoratore che produceva le merci e il consumatore che le comprava. Le aziende dovevano pagarti abbastanza perché potessi permetterti ciò che producevi. Era un circolo vizioso, ma almeno era un circolo in cui la tua esistenza era riconosciuta come necessaria.

Il capitalismo della sorveglianza ti tratta come preda, non come partner. La maggior parte delle persone che alimentano Google, Meta o Amazon con i propri dati non sono né clienti paganti né dipendenti. Sono utenti gratuiti che spesso ignorano completamente cosa succede ai loro dati, come vengono elaborati, a chi vengono venduti, per quali scopi vengono utilizzati.

Non sei più indispensabile come consumatore o lavoratore. Sei indispensabile come fonte di materia prima comportamentale, un giacimento da cui estrarre continuamente, silenziosamente, inesorabilmente. E la cosa più inquietante? La maggior parte delle persone non sa nemmeno di essere sfruttata, perché l’estrazione avviene in background, invisibile, mentre loro pensano di ricevere un servizio gratuito.

La Logica di Accumulazione: Dal Prodotto alla Predizione

Nel capitalismo tradizionale, la formula era relativamente semplice: produci un bene in fabbrica, vendilo sul mercato, incassa il profitto. Automobili, vestiti, elettrodomestici. Cose tangibili che cambiavano di mano in cambio di denaro.

Nel capitalismo della sorveglianza, la formula è molto più perversa: trasforma l’esperienza umana in quello che Zuboff chiama surplus comportamentale, elaboralo attraverso algoritmi di machine intelligence sempre più sofisticati, e crea prodotti predittivi (prediction products) da vendere nei mercati dei futuri comportamentali.

Non vendono più cose. Vendono previsioni su cosa farai, cosa comprerai, come voterai, se pagherai il mutuo, se ti ammalerai, se lascerai il tuo partner. Vendono la capacità di modificare il tuo comportamento futuro a favore di chi paga di più.

È come se avessero inventato una macchina del tempo finanziaria: invece di aspettare che tu faccia una scelta per guadagnarci, vendono la certezza crescente che farai quella scelta, e chi compra questa certezza può usarla per manipolarti affinché la scelta si avveri davvero.

Potere e Governance: Dall’Oppressione Visibile al Controllo Invisibile

Il capitalismo tradizionale esercitava il suo potere in modi relativamente visibili: fabbriche, contratti di lavoro, sindacati, scioperi, leggi sul lavoro. Potevi vedere il padrone, sapevi chi ti sfruttava, potevi organizzarti per resistere. Il conflitto era riconosciuto, anche se le forze in campo erano squilibrate.

Il capitalismo della sorveglianza instaura quello che Zuboff chiama “potere strumentale” (instrumentarian power): un sistema di controllo basato su un’architettura computazionale diffusa e invisibile. Sensori negli smartphone, telecamere intelligenti, assistenti vocali, algoritmi che ti osservano attraverso miliardi di dispositivi interconnessi.

Questo potere ti conosce meglio di quanto tu conosca te stesso e può modificare il tuo comportamento senza che tu te ne accorga. Non ha bisogno di minacciarti o costringerti apertamente. Ti spinge dolcemente, ti suggerisce, ti “aiuta” a fare scelte che in realtà servono gli interessi di chi ha progettato il sistema.

È un controllo senza catene visibili, una prigione senza sbarre, un’oppressione che si presenta come servizio.

Consenso e Legittimità: Dalla Negoziazione all’Appropriazione Unilaterale

Nel capitalismo tradizionale, per quanto imperfetto, esisteva un framework di conflitto riconosciuto: contratti collettivi, rappresentanza sindacale, negoziazioni, leggi sul lavoro. C’erano squilibri enormi, certo, ma almeno il conflitto era visibile e il consenso, anche se estorto, passava attraverso meccanismi formali.

Il capitalismo della sorveglianza opera senza significativi meccanismi di consenso reale. Si appropria unilateralmente di quelli che Zuboff chiama diritti epistemici: il diritto di sapere, di analizzare, di prevedere, di conoscere la tua vita interiore meglio di te.

Questi diritti, che dovrebbero appartenere all’individuo, vengono trasformati in diritti proprietari delle piattaforme. Google sostiene di “possedere” i dati che estrae da te. Meta rivendica la proprietà delle tue interazioni sociali. Amazon si appropria della conoscenza delle tue abitudini di consumo.

Il consenso che ti viene chiesto (i famosi banner “Accetta tutti i cookie”) è una finzione teatrale. Quando l’alternativa al consenso è l’esclusione dalla vita digitale, sociale ed economica, non si tratta di vera scelta, ma di estorsione legalizzata.

Il Ruolo dell’Intelligenza Artificiale: Dall’Automazione della Produzione all’Automazione della Manipolazione

Nel capitalismo tradizionale, la tecnologia serviva principalmente ad automatizzare la produzione: macchine che tessevano più velocemente di mani umane, catene di montaggio che assemblavano automobili, robot industriali che saldavano componenti.

Nel capitalismo della sorveglianza, l’IA serve a automatizzare la sorveglianza e la modificazione del comportamento umano. Gli algoritmi non producono beni: producono interventi personalizzati su scala massiva, calibrati per spingere ogni singolo individuo verso comportamenti specifici che massimizzano i profitti delle piattaforme.

L’IA analizza miliardi di pattern comportamentali, identifica le tue vulnerabilità psicologiche, calcola quale contenuto ti terrà incollato allo schermo più a lungo, quale notifica ti farà tornare sull’app, quale formulazione ti farà cliccare sul link, quale sequenza di stimoli ti farà comprare qualcosa che non sapevi di volere.

Non è più l’automazione del lavoro fisico, è l’automazione della persuasione, della manipolazione, del controllo psicologico. E funziona 24 ore su 24, su miliardi di persone contemporaneamente, con una precisione crescente che migliora ogni giorno grazie ai dati che continuiamo a fornire.

La Differenza Fondamentale: Dal Corpo all’Anima

Se dovessi riassumere la differenza fondamentale in una frase, direi questo: il capitalismo tradizionale voleva il tuo corpo e il tuo tempo; il capitalismo della sorveglianza vuole la tua anima.

Vuole entrare negli spazi più intimi della tua esistenza, quei momenti di esitazione prima di prendere una decisione, quei pensieri che formuli ma non esprimi, quelle emozioni che provi ma non condividi. Vuole trasformare l’ineffabile in dati, il privato in pubblico, l’umano in algoritmo.

E la cosa più terrificante? Lo fa con il nostro consenso inconsapevole, mentre pensiamo di ricevere servizi gratuiti e comodi, mentre crediamo di essere noi a usare la tecnologia, quando in realtà è la tecnologia a usare noi.

Il Santuario Perduto: Rivendicare gli Spazi dell’Invisibilità

Penso spesso a mio nonno, che negli anni Settanta si chiudeva nello studio per ore a leggere, scrivere lettere, pensare. Nessuno sapeva cosa facesse lì dentro, e questa ignoranza altrui non era un problema da risolvere, era la condizione naturale della dignità umana. Quella stanza era un santuario, un tempio dell’interiorità dove l’esperienza personale rimaneva tale, non veniva estratta, catalogata, monetizzata.

Oggi quel santuario non esiste più. Anche quando crediamo di essere soli, siamo accompagnati da sensori, microfoni dormienti, algoritmi che ascoltano il ritmo dei nostri battiti cardiaci attraverso lo smartwatch, che interpretano le pause tra una parola e l’altra quando digitiamo un messaggio. L’architettura stessa della nostra vita quotidiana è stata ridisegnata per eliminare ogni angolo buio, ogni spazio dove il capitalismo della sorveglianza non possa entrare con la sua luce fredda e contabile.

Abbiamo bisogno, disperatamente, di ricostruire questi santuari. Non parlo solo di normative o di tecnologie privacy-friendly, parlo di una rivoluzione culturale che riconosca l’invisibilità come diritto fondamentale. Abbiamo bisogno di spazi fisici dove i telefoni non possono entrare, non per paura o paranoia, ma per scelta consapevole. Biblioteche dove non ci sono telecamere, parchi dove non ci sono sensori IoT che contano i nostri passi, caffè dove possiamo ancora pagare in contanti e sederci senza che nessun sistema sappia che siamo lì.

Ma soprattutto, abbiamo bisogno di spazi digitali che rispettino il silenzio. Piattaforme che non tracciano, che non profilano, che non cercano di prevedere la nostra prossima mossa. Software che funziona senza dover sapere chi siamo, cosa abbiamo fatto ieri, con chi abbiamo parlato stamattina. Immaginate un motore di ricerca che dimentica la vostra query appena vi ha dato la risposta, un social network che non conserva la cronologia delle vostre interazioni, un assistente vocale che non invia nulla al cloud ma elabora tutto localmente, nella vostra casa, e poi cancella ogni traccia.

Utopia? Forse. Ma l’alternativa è accettare che ogni singolo momento della nostra esistenza venga tradotto in dati, ogni pensiero sussurrato a un dispositivo diventi proprietà di qualcun altro, ogni emozione catturata da un sensore finisca in un database che alimenta modelli predittivi sempre più sofisticati.

Interrompere la Catena: Dal Regolamento alla Rivoluzione

Zuboff ha ragione quando dice che non possiamo limitarci a regolare il commercio dei dati umani. Regolare significa accettare che il commercio esista, che sia legittimo, che si tratti solo di trovare il giusto equilibrio tra profitto aziendale e tutela del cittadino. Ma questo è esattamente il linguaggio che ci ha portato dove siamo oggi: in un mondo dove la privacy è uno zombie perché abbiamo permesso che l’esperienza umana diventasse una merce.

Dobbiamo interrompere la catena di approvvigionamento alla radice. Dobbiamo dichiarare, con la forza della legge e della cultura, che l’esperienza umana non è in vendita. Punto. Non a condizioni migliori, non con maggiore trasparenza, non con algoritmi più “etici”. Semplicemente non è in vendita.

Questo significa rendere illegale il modello di business che ha costruito i giganti tecnologici degli ultimi vent’anni. Significa dire a Google, Meta, Amazon, che non possono più estrarre valore dalla sorveglianza pervasiva delle nostre vite. Significa costringerli a trovare modi diversi di creare valore, modi che non richiedano di trasformarci in miniere a cielo aperto da cui estrarre comportamenti, emozioni, relazioni.

Lo so, sembra radicale. Ma pensate a quante cose che oggi consideriamo ovvie erano considerate radicali un secolo fa. Il divieto del lavoro minorile. Il diritto di voto alle donne. Le norme sulla sicurezza sul lavoro. Tutte queste conquiste sono nate quando qualcuno ha avuto il coraggio di dire che certe cose non possono essere commerciate, che ci sono limiti invalicabili alla logica del profitto.

L’esperienza umana deve diventare uno di questi limiti. La nostra interiorità, i nostri pensieri prima che diventino azioni, le nostre conversazioni private, i nostri momenti di dubbio e vulnerabilità, tutto questo deve essere protetto non come dato sensibile da gestire con cura, ma come territorio sacro e inviolabile.

La Tecnologia come Strumento, non come Padrone

Quando insegno ai miei studenti, cerco sempre di trasmettere un concetto che mi sta particolarmente a cuore: la tecnologia non è neutrale, ma nemmeno deterministica. Non siamo condannati a vivere in un mondo di sorveglianza pervasiva solo perché la tecnologia lo rende possibile. Possiamo scegliere di costruire tecnologie diverse, che servano bisogni umani autentici invece di creare dipendenze redditizie.

Esistono già esempi di questa resistenza creativa. Software open source che mette il controllo nelle mani degli utenti. Protocolli crittografici che rendono impossibile la sorveglianza di massa. Reti decentralizzate dove nessuna azienda possiede i dati perché i dati non vengono raccolti. Questi progetti sono spesso marginali, finanziati da volontari appassionati invece che da venture capital, ma dimostrano che un’altra strada è possibile.

Il problema è che questa strada richiede sacrifici. Richiede di rinunciare alla comodità delle piattaforme gratuite. Richiede di imparare a usare strumenti meno intuitivi. Richiede di pagare per servizi che altrove sembrano gratuiti. Ma questa apparente gratuità è la grande menzogna del capitalismo della sorveglianza: nulla è gratis, stiamo solo pagando con una moneta che non vediamo, la nostra stessa umanità.

Dobbiamo tornare a essere padroni degli strumenti che usiamo. Questo significa capire come funzionano, cosa fanno con i nostri dati, chi ci guadagna. Significa pretendere trasparenza non come slogan ma come architettura: sistemi progettati fin dall’inizio per essere comprensibili, controllabili, modificabili.

E significa, soprattutto, recuperare il diritto al dissenso tecnologico. Il diritto di dire no. Il diritto di non usare un’app, di non avere uno smartphone, di non essere connessi, senza per questo essere esclusi dalla vita sociale ed economica. Finché il prezzo della privacy sarà l’esclusione, la privacy rimarrà uno zombie, un lusso per pochi eccentrici invece che un diritto universale.

Umanesimo Digitale: Rivendicare il diritto al Santuario

Non scrivo questo per deprimervi, ma per armarvi. Come umanista digitale, credo che la tecnologia possa essere salvata, ma solo se smettiamo di trattare la privacy come una normativa burocratica e iniziamo a trattarla come un diritto umano fondamentale al santuario.

La battaglia per la privacy è la battaglia per decidere che tipo di società vogliamo essere. Una società dove ogni aspetto della vita umana è trasparente, misurabile, ottimizzabile? O una società che riconosce il valore dell’opacità, del mistero, dell’inefficienza umana?

Io scelgo la seconda. Scelgo di difendere gli spazi bui dove nascono i pensieri sovversivi, le idee non ancora formate, i dubbi che non vogliamo condividere con nessuno. Scelgo di proteggere il diritto di cambiare idea senza che questo cambiamento venga registrato e usato contro di me. Scelgo di rivendicare il diritto all’oblio, non come cancellazione di dati obsoleti, ma come possibilità di ricominciare senza portarmi dietro il peso di ogni errore, ogni ricerca imbarazzante, ogni momento di debolezza catturato da un algoritmo.

La tecnologia deve tornare a essere uno strumento nelle nostre mani, non noi lo strumento nelle mani della tecnologia. Dobbiamo pretendere leggi che non si limitino a mettere il guinzaglio al mostro, ma che ne cambino la dieta. Fino ad allora, ogni volta che vedete un banner sui cookie o un’informativa sulla privacy, ricordatevi: state guardando uno zombie. Non fatevi mordere.

E se proprio dovete farvi mordere, almeno abbiate la consapevolezza di cosa state perdendo. Perché una volta che l’ultimo santuario sarà caduto, una volta che l’ultimo spazio di invisibilità sarà stato illuminato dai riflettori della sorveglianza, non ci sarà più ritorno. Saremo definitivamente trasformati in quello che il capitalismo della sorveglianza ha sempre voluto che fossimo: dati ambulanti, profili predittivi, materiale grezzo per macchine che pensano al posto nostro.

Io non ci sto. E spero che anche voi, dopo aver letto queste righe, decidiate di non starci. Perché la privacy non è morta finché continuiamo a credere che meriti di vivere. E gli zombie, si sa, possono essere uccisi di nuovo. Basta trovare il coraggio di puntare alla testa.

Domande Frequenti

Tutto quello che avreste voluto sapere sulla morte della privacy

Cosa significa che “la privacy è uno zombie”?

Quando Shoshana Zuboff afferma che la privacy è diventata uno zombie… [testo troncato per brevità]

Approfondimenti: Privacy e Intelligenza Artificiale

Una raccolta di risorse essenziali in lingua italiana per comprendere le implicazioni etiche, legali e sociali dell’uso dei dati personali nell’addestramento dei sistemi di IA.

Garante Privacy – Raccolta dati e IA

Il portale ufficiale del Garante per la protezione dei dati personali con provvedimenti e schede informative sull’intelligenza artificiale.

Vai alla risorsa →AI Act – Il Regolamento Europeo

Analisi e testo del regolamento europeo sull’intelligenza artificiale, fondamentale per capire i nuovi limiti normativi.

Vai alla risorsa →Umanesimo Digitale

Il blog di riferimento per l’etica della tecnologia, con focus specifici sulla mercificazione dei dati personali.

Vai alla risorsa →Privacy Network

Associazione italiana che promuove i diritti digitali, con articoli approfonditi su sorveglianza e algoritmi.

Vai alla risorsa →Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.