Suggerimento 1

“L’unico abbonamento che ti serve è ChatGPT”.

Questa frase era vera fino a poco tempo fa. Oggi, nello scenario attuale, è una bugia che ti costa ore di produttività.

Il mercato dell’Intelligenza Artificiale si è frammentato e specializzato. Non esiste più “il migliore in assoluto”, esiste solo “il migliore per questo specifico compito”.

Se ti stai chiedendo quale intelligenza artificiale scegliere, sappi che continuare a usare ChatGPT per tutto è come cercare di costruire una casa usando solo un martello: puoi farlo, ma sarà faticoso e il risultato sarà mediocre.

Oggi abbiamo a disposizione una squadra di specialisti. C’è chi eccelle nella creatività, chi nell’analisi di dati enormi, chi nella ricerca in tempo reale e chi nella sicurezza aziendale.

Suggerimento 2

Prerequisiti Fondamentali

Il terreno di gioco: Perché non si può fare Intelligenza Artificiale senza le “vecchie” competenze digitali

Quando si parla di Intelligenza Artificiale, c’è un equivoco diffuso: si pensa che l’IA sia un “pulsante magico” che fa tutto da solo. La realtà è ben diversa. L’IA è un motore potente, ma ha bisogno di un pilota che sappia dove sta andando.

Per guidare l’IA, non serve essere programmatori, ma è obbligatorio possedere un solido set di competenze digitali tradizionali. Se non sai gestire un file, navigare il web in modo consapevole o strutturare un documento, l’IA non potrà aiutarti.

Ecco il set minimo di competenze digitali “non-AI” che devi possedere e perché sono il prerequisito fondamentale per il nostro corso.

Computer e Gestione dei File L’Armadietto Digitale

Di cosa si tratta:

Saper organizzare cartelle, spostare file, rinominarli, capire la differenza tra memoria locale (hard disk) e cloud (Google Drive, OneDrive, Dropbox). Conoscere le estensioni dei file (.docx, .pdf, .jpg, .mp4).

Perché è fondamentale per l’IA:

L’IA lavora sui file. Se l’IA ti genera un report, tu devi sapere dove salvarlo, come ritrovarlo e come condividerlo. Se devi usare un’IA per analizzare un documento, devi sapere dove quel documento è archiviato e come caricarlo (upload). La disorganizzazione digitale è il primo ostacolo all’adozione dell’IA.

Browsing e Ricerca Avanzata La Bussola

Di cosa si tratta:

Saper utilizzare un browser (Chrome, Edge, Safari), gestire le schede, usare i preferiti e, soprattutto, saper cercare informazioni usando parole chiave efficaci.

Perché è fondamentale per l’IA:

L’interfaccia principale dell’IA è web-based. Per usare ChatGPT o Midjourney, devi saper navigare su un sito, creare un account e capire le impostazioni del browser. Inoltre, l’abilità di “cercare bene” è la base del Prompt Engineering: chi sa cercare su Google usando parole precise, sa già come scrivere i comandi giusti all’IA.

Suite Ufficio e Produttività Il Foglio di Lavoro

Di cosa si tratta:

Conoscere Word (videoscrittura), Excel (basi dei fogli di calcolo) e PowerPoint (presentazioni).

Perché è fondamentale per l’IA:

L’IA spesso restituisce testi che vanno poi formattati, o tabelle di dati che vanno inserite in Excel. Se l’IA ti scrive una presentazione, tu devi saperla copiare, incollare e impaginare in PowerPoint.

Senza la conoscenza di questi strumenti, l’output dell’IA è solo testo grezzo inutile. Devi conoscere la meta per poter chiedere all’IA di raggiungerla.

Competenze Multimediali Immagini, Audio e Video

Di cosa si tratta:

Saper gestire un’immagine (capire cos’è la risoluzione, il peso del file, il formato), saper scaricare o registrare un audio, gestire un video base.

Perché è fondamentale per l’IA:

Il futuro dell’IA è “multimodale” (lavora con testo, immagini e suoni insieme). Se l’IA ti genera un’immagine perfetta per una presentazione, tu devi sapere se quel formato è utilizzabile o se è troppo pesante da inviare via email. Devi saper distinguere un file audio da un file video per poterli sottoporre all’IA per la trascrizione o l’analisi.

Comunicazione Digitale e Posta Elettronica Il Tuo Biglietto da Visita

Di cosa si tratta:

Gestire la casella email (ricevere, inviare, allegare, organizzare in cartelle), capire la differenza tra “A”, “Cc” e “Ccn”, scrivere email professionali.

Perché è fondamentale per l’IA:

L’IA può scrivere le email per te, ma tu devi saperle controllare e inviare. La posta elettronica è ancora il canale ufficiale del lavoro: saperla gestire è il primo passo per l’efficienza. Se non sai allegare un file generato dall’IA a un’email, tutto il processo di generazione perde valore.

Social Media e Comunicazione Online Il Contesto

Di cosa si tratta:

Conoscere le principali piattaforme (LinkedIn, Facebook, Instagram, TikTok) e capire il linguaggio specifico di ognuna (hashtag, storie, post brevi vs lunghi).

Perché è fondamentale per l’IA:

Molte aziende usano l’IA per generare contenuti social. Se non capisci la differenza tra un post su LinkedIn (professionale) e uno su Instagram (visivo e informale), non potrai chiedere all’IA di generare il contenuto giusto. Devi conoscere il “luogo” dove il contenuto vivrà per poter istruire l’IA.

Sicurezza e Privacy di Base Il Buonsenso Digitale

Di cosa si tratta:

Saper riconoscere una mail sospetta (phishing), gestire password sicure, capire cosa si condivide pubblicamente.

Perché è fondamentale per l’IA:

L’IA richiede l’accesso a servizi online e spesso ai nostri dati. Senza una cultura della sicurezza base, si rischia di condividere informazioni sensibili con i modelli di IA pubblici, violando la privacy propria o aziendale.

Il Mercato dell’IA:

Piattaforme e Modelli

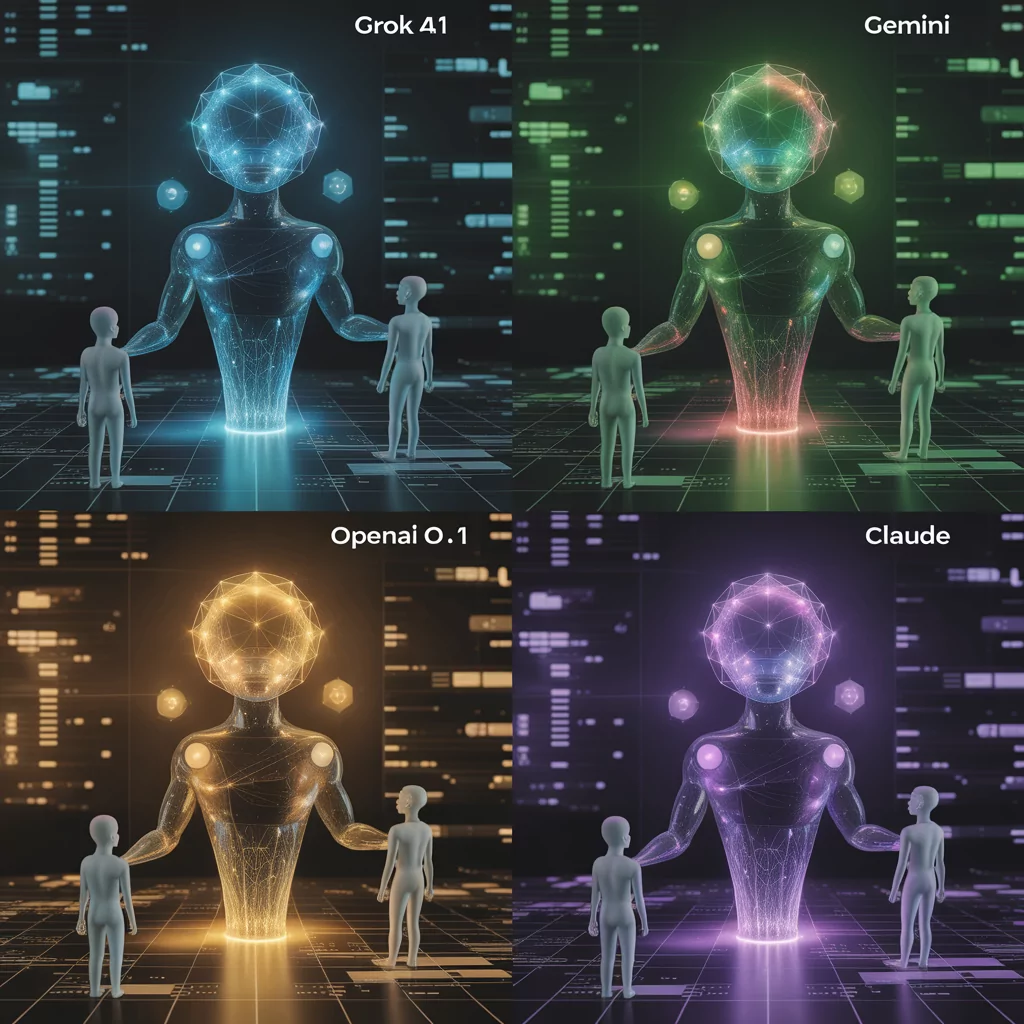

LLM occidentali a confronto: ChatGPT, Claude, Gemini, Grok, Llama e Mistral.

In questo articolo analizziamo alcuni tra i principali LLM occidentali, mettendo a confronto sia i modelli proprietari sia quelli open source o open weight. L’obiettivo non è solo descrivere le loro caratteristiche tecniche, ma anche capire per quali utilizzi risultano più adatti, quali sono i loro punti di forza, i limiti e le differenze strategiche.

Nota importante: Nel mondo degli LLM i nomi commerciali, le versioni e le famiglie di modelli cambiano molto rapidamente. Inoltre, alcune aziende non rendono pubblici tutti i dettagli tecnici. Per questo, una comparazione seria deve distinguere tra dati ufficialmente dichiarati, informazioni note in modo affidabile e aspetti non pubblici.

Perché confrontare gli LLM

Gli LLM non sono tutti uguali. Anche quando sembrano simili nell’uso quotidiano, differiscono per finestra di contesto, multimodalità, memoria, architettura, capacità di ragionamento, prestazioni nel coding, velocità, costo, livello di apertura e adattabilità.

Oggi conta molto anche come il modello si comporta in scenari reali: scrittura, analisi documentale, sviluppo software, assistenza clienti, automazione e uso enterprise.

I Modelli a Confronto

ChatGPT / GPT di OpenAI

ProprietarioChatGPT è oggi il prodotto più noto, trasformato in una piattaforma d’uso generale accessibile a utenti consumer, professionisti e aziende.

Punti di Forza

- Grande versatilità e esperienza utente matura.

- Forte multimodalità (testo, immagini, voce).

- Memoria utente integrata e personalizzazione.

- Ecosistema ampio e integrazione API.

Limiti

- Scarsa trasparenza tecnica.

- Costo potenzialmente elevato in uso intensivo.

- Dipendenza da piattaforma proprietaria.

- Non adatto al deployment locale.

Ideale per: Produttività personale, scrittura, brainstorming, analisi file, assistenza multimodale.

Claude (Sonnet e Opus) di Anthropic

ProprietarioAnthropic si distingue per sicurezza, affidabilità e ottima gestione dei testi lunghi. Sonnet è il compromesso velocità/costo, Opus il modello più potente.

Punti di Forza

- Finestra di contesto enorme (analisi PDF e contratti).

- Ottima capacità di seguire istruzioni articolate.

- Stile chiaro, ordinato e professionale.

- Eccellente nel coding.

Limiti

- Minore centralità consumer rispetto a ChatGPT.

- Meno ecosistema di massa.

- Trasparenza tecnica limitata.

Ideale per: Analisi legale, revisione policy, confronto contratti, coding professionale, uso enterprise.

Gemini Pro di Google

ProprietarioLa risposta di Google: sfrutta l’infrastruttura cloud e l’ecosistema Google. Fortemente multimodale fin dalla concezione.

Punti di Forza

- Multimodalità molto forte (testo, video, audio).

- Integrazione con ecosistema Google Workspace.

- Contesto ampio per analisi documenti.

Limiti

- Esperienza utente a volte meno uniforme di ChatGPT.

- Posizionamento complesso tra prodotti diversi.

Ideale per: Workflow multimodali, ambienti Google-centric, automazione cloud.

Grok di xAI

ProprietarioModello associato all’ecosistema di Elon Musk e integrato con X. Si distingue per accesso ai dati in tempo reale e tono meno filtrato.

Punti di Forza

- Integrazione con dati aggiornati da X.

- Stile diretto e “live”.

- Interessante per monitoraggio trend.

Limiti

- Ecosistema meno maturo.

- Minore standardizzazione enterprise.

- Affidabilità da valutare in ambiti formali.

Ideale per: Analisi di trend, monitoraggio attualità, social data.

Llama di Meta

Open WeightLa famiglia di modelli open weight più importante in Occidente. Ha democratizzato l’accesso agli LLM permettendo esecuzione locale.

Punti di Forza

- Ecosistema enorme e community attiva.

- Esecuzione locale e on-premise.

- Fine-tuning accessibile.

- Indipendenza da API esterne.

Limiti

- Servono competenze tecniche per il setup.

- Qualità “out of the box” inferiore ai top model chiusi.

- Licenza non completamente libera.

Ideale per: Ricerca, deployment on-premise, privacy, personalizzazione aziendale.

Mistral AI

Open Weight / MistiCaso europeo di eccellenza. Modelli molto efficienti (es. Mixtral) con ottimo rapporto prestazioni/dimensione.

Punti di Forza

- Efficienza architetturale (MoE).

- Ottimo rapporto qualità/costo inferenziale.

- Valore strategico europeo.

- Buone performance in coding.

Limiti

- Ecosistema più piccolo di Llama.

- Alcuni modelli di punta sono solo commerciali.

Ideale per: Aziende che cercano efficienza, deployment custom, sovranità tecnologica europea.

Confronto per Utilizzo

Uso Quotidiano Generalista

Vincitore: ChatGPT. Per interfaccia matura, multimodalità, memoria e versatilità.

Analisi Documenti Lunghi

Vincitori: Claude e Gemini. Eccellenti per PDF lunghi, contratti e ragionamento esteso.

Coding e Sviluppo

Vincitori: Claude Sonnet e ChatGPT. Molto forti anche Llama/Mistral se fine-tuned.

Privacy e Deployment Locale

Vincitori: Llama e Mistral. Unica scelta reale per controllo totale dati e on-premise.

Considerazioni Finali

Il panorama degli LLM occidentali è estremamente articolato. Non esiste un modello “migliore in assoluto”: esistono modelli più adatti a diversi contesti.

- ChatGPT è il più forte come assistente generalista.

- Claude brilla nell’analisi documentale e ragionamento.

- Gemini è fortissimo nella multimodalità e integrazione Google.

- Grok ha un’identità peculiare legata all’attualità.

- Llama è il pilastro dell’ecosistema open.

- Mistral è il campione dell’efficienza europea.

La scelta strategica

La vera scelta non va fatta solo guardando i benchmark, ma rispondendo a domande concrete: serve un assistente personale o una piattaforma enterprise? Conta di più la qualità immediata o il controllo del deployment? Il modello deve girare in locale? La comparazione tra LLM oggi è una comparazione tra visioni del prodotto, architetture industriali e strategie geopolitiche.

Risorse e Approfondimenti

Video Lezioni Consigliate

Confronto tra i principali LLM

AI Insights

Analisi comparativa delle prestazioni dei modelli leader.

Guarda il video →Claude vs GPT-4 vs Gemini

Tech Review

Quale modello scegliere per il lavoro quotidiano?

Guarda il video →Il futuro degli LLM Open Source

Open AI Dev

L’impatto di Llama e Mistral sul mercato globale.

Guarda il video →Tutorial: Scegliere il modello giusto

Practical AI

Guida pratica per sviluppatori e aziende.

Guarda il video →Analisi tecnica: Architetture a confronto

Deep Dive

Differenze tra Mixture of Experts e Transformer classici.

Guarda il video →Scheda Tecnica Comparativa:

LLM Occidentali a Confronto

ChatGPT, Claude, Gemini, Grok, Llama e Mistral: un’analisi tecnica e strategica.

In questo articolo analizziamo alcuni tra i principali LLM occidentali, mettendo a confronto sia i modelli proprietari sia quelli open source o open weight. Il focus sarà in particolare su ChatGPT, Claude Sonnet e Opus, Gemini Pro, Grok, Llama e Mistral. L’obiettivo non è solo descrivere le loro caratteristiche tecniche, ma anche capire per quali utilizzi risultano più adatti, quali sono i loro punti di forza, i limiti e le differenze strategiche.

Attenzione alla Versione

Va chiarito subito un punto: nel mondo degli LLM i nomi commerciali, le versioni e le famiglie di modelli cambiano molto rapidamente. Inoltre, alcune aziende non rendono pubblici tutti i dettagli tecnici, soprattutto su numero di parametri, dataset, architettura completa e pipeline di addestramento. Per questo, una comparazione seria deve distinguere tra:

- dati ufficialmente dichiarati;

- informazioni note in modo affidabile;

- aspetti non pubblici o solo parzialmente noti.

Opacità e Piattaforme

Un ulteriore elemento critico riguarda il fatto che il mercato degli LLM è sempre più dominato da interfacce commerciali, abbonamenti, piattaforme aggregate e servizi “all-in-one” che spesso semplificano l’accesso ai modelli, ma allo stesso tempo rendono più opaca la relazione tra utente, provider e infrastruttura reale. In molti casi l’utente non sa con precisione:

- quale modello stia davvero usando;

- se la versione sia aggiornata;

- quali dati vengano conservati;

- quali prompt siano registrati;

- se esistano filtri, limiti o rielaborazioni applicate dalla piattaforma;

- quanto sia stabile nel tempo l’accesso a quel modello.

Per questo motivo, oggi confrontare gli LLM significa anche analizzare i rischi commerciali, i problemi di trasparenza e il crescente fenomeno del lock-in di piattaforma.

Link di accesso alle piattaforme principali

Di seguito i principali punti di accesso ufficiali o di riferimento per i modelli e le piattaforme citate:

Nota critica: l’accesso tramite sito web non garantisce automaticamente trasparenza sul modello sottostante. In molte piattaforme aggregate il nome commerciale mostrato all’utente non coincide sempre con una documentazione chiara su:

- versione precisa del modello;

- limiti di utilizzo;

- policy sui dati;

- latenza e priorità;

- eventuali modifiche via proxy o middleware.

1. Perché confrontare gli LLM

Gli LLM non sono tutti uguali. Anche quando sembrano simili nell’uso quotidiano, differiscono per:

- finestra di contesto;

- multimodalità;

- memoria;

- architettura;

- capacità di ragionamento;

- prestazioni nel coding;

- velocità;

- costo;

- livello di apertura;

- facilità di integrazione;

- adattabilità a usi aziendali o locali.

Un confronto basato solo sui benchmark sarebbe riduttivo. Oggi conta molto anche come il modello si comporta in scenari reali: scrittura, analisi documentale, sviluppo software, assistenza clienti, automazione, ricerca, uso enterprise e deployment locale.

Ma conta anche chi controlla l’accesso. Un modello eccellente, se disponibile solo tramite una piattaforma costosa, poco trasparente o soggetta a cambiamenti improvvisi di policy, può diventare meno affidabile di un modello leggermente inferiore ma più stabile e controllabile. Questo è un punto spesso sottovalutato nel marketing delle AI platform.

2. I modelli presi in esame

In questa analisi consideriamo:

Modelli proprietari occidentali

- ChatGPT / GPT di OpenAI

- Claude Sonnet e Claude Opus di Anthropic

- Gemini Pro di Google

- Grok di xAI

Modelli open weight / open source-like

- Llama di Meta

- Mistral di Mistral AI

Nota importante: “Llama, Mistral e Meta”: Meta è l’azienda che sviluppa Llama, quindi non è una famiglia distinta di modelli. Si può parlare di Meta come attore strategico separatamente da Llama.

3. Parametri di confronto

Per fare una comparazione utile, useremo alcuni criteri comuni.

3.1 Finestra di contesto

La finestra di contesto indica quanti token il modello può considerare in una singola interazione. È fondamentale per:

- analizzare documenti lunghi;

- tenere traccia di conversazioni complesse;

- lavorare su codice esteso;

- fare reasoning su grandi quantità di testo.

3.2 Multimodalità

Indica la capacità di lavorare non solo con testo, ma anche con:

- immagini,

- audio,

- video,

- documenti strutturati,

- tabelle,

- interfacce visive.

3.3 Memoria

Qui bisogna distinguere due significati:

- memoria contestuale, cioè ciò che il modello ricorda nella sessione corrente;

- memoria persistente, cioè la capacità del sistema/applicazione di ricordare preferenze e dati dell’utente tra sessioni diverse.

3.4 Parametri

Il numero di parametri è stato a lungo l’indicatore principale della “grandezza” di un modello. Oggi però conta meno di un tempo se preso da solo. Modelli più piccoli ma ben addestrati possono superare modelli più grandi ma meno efficienti.

Inoltre, molti provider non rivelano il numero esatto di parametri.

3.5 Architettura

L’architettura riguarda il modo in cui il modello è costruito:

- transformer classico;

- mixture of experts (MoE);

- varianti ottimizzate;

- pipeline multimodali integrate.

L’architettura incide su:

- efficienza,

- costo inferenziale,

- scalabilità,

- capacità specialistiche.

3.6 Prestazioni per utilizzo

Infine, il criterio più importante: cosa sa fare bene davvero?

- scrittura e sintesi;

- coding;

- analisi di documenti;

- ricerca;

- agentic workflows;

- uso creativo;

- enterprise;

- deployment locale.

3.7 Trasparenza commerciale e rischio di lock-in

A questi criteri tecnici è necessario aggiungerne almeno due:

- trasparenza del fornitore;

- rischio di dipendenza commerciale.

Un modello può essere ottimo, ma se:

- non si conosce chiaramente la versione usata,

- il prezzo cambia spesso,

- le policy sui dati sono vaghe,

- l’accesso dipende da una sola interfaccia,

- le API possono essere modificate unilateralmente,

allora il rischio per aziende e professionisti aumenta sensibilmente.

4. ChatGPT / GPT di OpenAI

Posizionamento generale

ChatGPT è oggi il prodotto più noto nel mondo degli LLM. Il suo punto di forza principale è l’aver trasformato un modello linguistico in una piattaforma d’uso generale, accessibile a utenti consumer, professionisti e aziende.

Nota: Nel testo originale si cita “ChatGPT ultima versione 5.4”. Va detto con precisione che i nomi commerciali e tecnici di OpenAI possono cambiare e non sempre coincidono con una nomenclatura pubblica stabile. In un articolo serio conviene quindi parlare di ultima generazione di modelli GPT usati in ChatGPT, salvo indicare una versione ufficialmente confermata.

Finestra di contesto

I modelli OpenAI moderni hanno in genere contesti ampi, adatti a:

- analisi di documenti lunghi,

- coding articolato,

- conversazioni estese,

- task complessi multi-step.

Il contesto è uno dei punti forti del sistema, soprattutto quando integrato con strumenti di caricamento file e funzioni avanzate di workspace.

Multimodalità

OpenAI ha spinto molto sulla multimodalità:

- testo,

- immagini,

- voce,

- file,

- in alcuni ambienti anche interazioni più complesse.

Questo rende ChatGPT particolarmente adatto a un uso quotidiano trasversale, non solo testuale.

Memoria

Uno dei vantaggi competitivi di ChatGPT come prodotto è la memoria utente integrata in alcune modalità d’uso. Questo significa che il sistema può ricordare preferenze, stile, contesto personale e abitudini operative, migliorando la continuità dell’esperienza.

Ma proprio questa memoria apre questioni critiche:

- quali dati vengono davvero memorizzati;

- per quanto tempo;

- con quali garanzie di cancellazione;

- con quale separazione tra uso personale, aziendale e training futuro.

Parametri e architettura

OpenAI non pubblica in modo completo il numero di parametri e i dettagli architetturali dei modelli più recenti. Sappiamo però che si tratta di modelli altamente ottimizzati, con infrastruttura e allineamento molto avanzati.

Questa opacità è uno dei principali limiti per chi cerca auditabilità, comparazione scientifica o valutazione indipendente.

Punti di forza

- grande versatilità;

- ottima esperienza utente;

- forte multimodalità;

- buon equilibrio tra creatività, ragionamento e chiarezza;

- ecosistema ampio;

- integrazione API e strumenti.

Limiti

- scarsa trasparenza tecnica;

- costo potenzialmente elevato in uso intensivo;

- dipendenza da piattaforma proprietaria;

- non adatto al deployment locale;

- forte rischio di lock-in per team e aziende che costruiscono workflow interni su strumenti proprietari.

Utilizzi ideali

ChatGPT è particolarmente forte per: produttività personale, scrittura e revisione, brainstorming, supporto professionale generalista, analisi di file, automazione leggera, assistenza quotidiana multimodale.

5. Claude Sonnet e Claude Opus di Anthropic

Posizionamento generale

Anthropic si è distinta per un approccio molto focalizzato su: sicurezza, affidabilità, qualità del ragionamento, ottima gestione dei testi lunghi.

Le famiglie Sonnet e Opus rappresentano in genere due livelli diversi:

- Sonnet come compromesso tra costo, velocità e qualità;

- Opus come modello più potente e sofisticato.

Nota: Nel testo citiamo “Claude Sonnet ed Opus 4.6”. Per rigore, conviene usare le denominazioni ufficiali disponibili al momento della pubblicazione.

Finestra di contesto

Claude è noto soprattutto per la grande finestra di contesto, che lo rende eccellente per: leggere lunghi PDF, fare analisi contrattuale, confrontare documenti, seguire ragionamenti estesi, lavorare su basi testuali molto ampie. Questa è una delle sue caratteristiche più distintive.

Multimodalità

Claude ha sviluppato capacità multimodali, ma storicamente il suo punto di forza percepito è stato soprattutto il testo lungo e il ragionamento documentale più che la spettacolarità multimodale.

Memoria

La memoria persistente dipende molto dal prodotto e dal contesto d’uso. Più che sulla “memoria personale”, Claude si distingue per la qualità con cui gestisce il contesto lungo nella singola sessione.

Parametri e architettura

Anthropic non rende pubblici tutti i dettagli. Tuttavia, il comportamento dei modelli suggerisce una forte ottimizzazione per robustezza, coerenza, allineamento e ragionamento su testi complessi.

Anche in questo caso, l’assenza di trasparenza completa limita la possibilità di verifica esterna e rende difficile valutare con precisione costi, efficienza e replicabilità.

Sonnet vs Opus

- più rapido;

- più economico;

- ottimo per uso operativo e aziendale;

- molto competitivo in coding e analisi.

- più potente;

- migliore nei compiti complessi;

- più adatto a ragionamento profondo e output sofisticati;

- più costoso.

Punti di forza

- eccellente analisi documentale;

- ottima capacità di seguire istruzioni articolate;

- molto forte su testi lunghi;

- stile spesso chiaro, ordinato, professionale;

- buone performance nel coding.

Limiti

- minore centralità consumer rispetto a ChatGPT;

- meno “ecosistema di massa”;

- trasparenza tecnica limitata;

- alcune implementazioni possono apparire più conservative;

- dipendenza da un fornitore unico con policy di accesso e pricing modificabili.

Utilizzi ideali

Claude è spesso eccellente per: analisi legale e documentale, revisione di policy, confronto tra contratti, scrittura strutturata, coding professionale, uso enterprise ad alta affidabilità.

6. Gemini Pro di Google

Posizionamento generale

Gemini è la risposta di Google alla competizione sugli LLM generalisti e multimodali. Il suo vantaggio strategico deriva dal fatto che Google possiede: enorme infrastruttura cloud, lunga esperienza in AI, ecosistema di prodotti integrati, competenze forti nella multimodalità.

Nota: Nel testo compare “Gemini 3.1 Pro”. In un articolo conviene verificare la denominazione ufficiale esatta al momento della pubblicazione.

Finestra di contesto

Gemini si è distinto per contesti molto ampi in alcune versioni, diventando particolarmente interessante per: analisi di grandi documenti, retrieval avanzato, workflow enterprise, progetti che combinano testo e altre modalità.

Multimodalità

Questo è uno dei suoi punti più forti. Gemini nasce con un’impostazione fortemente multimodale: testo, immagini, audio, video, documenti complessi. In prospettiva, è probabilmente uno dei modelli più strategici per applicazioni che richiedono interazione tra più forme di dato.

Memoria

La memoria dipende dal prodotto finale e dall’integrazione con l’ecosistema Google. Più che una memoria “personale” in senso stretto, il vantaggio può stare nell’integrazione con strumenti, documenti e ambienti cloud.

Questo però implica un altro rischio: l’inserimento dell’LLM dentro un ecosistema già dominante può aumentare il grado di dipendenza infrastrutturale da Google.

Parametri e architettura

Google non pubblica tutto, ma Gemini è generalmente percepito come una famiglia di modelli altamente avanzata, con forte investimento su efficienza, multimodalità e integrazione infrastrutturale.

Punti di forza

- multimodalità molto forte;

- integrazione con ecosistema Google;

- contesto ampio;

- buona capacità analitica;

- potenziale enorme in contesti enterprise e cloud.

Limiti

- esperienza utente non sempre percepita come uniforme quanto ChatGPT;

- meno centralità simbolica nel dibattito pubblico;

- complessità di posizionamento tra prodotti diversi;

- scarsa trasparenza completa su architettura e dati;

- elevato rischio di lock-in per organizzazioni già dipendenti dal cloud Google.

Utilizzi ideali

Gemini è molto adatto per: workflow multimodali, ambienti enterprise Google-centric, analisi documentale ampia, automazione integrata con cloud e produttività, applicazioni che combinano testo, immagini e dati.

7. Grok di xAI

Posizionamento generale

Grok è il modello sviluppato da xAI, fortemente associato all’ecosistema di Elon Musk e integrato con la piattaforma X. Il suo posizionamento è particolare: vuole essere un modello capace di combinare buone prestazioni con accesso dinamico a informazioni in tempo reale e uno stile meno filtrato rispetto ad altri competitor.

Finestra di contesto

Grok ha migliorato progressivamente le sue capacità contestuali, ma il suo elemento distintivo non è solo la finestra di contesto: è soprattutto il collegamento con l’ecosistema informativo di X e l’idea di modello più “live”.

Multimodalità

Anche Grok si muove verso la multimodalità, ma la sua identità pubblica è stata finora più legata a: accesso a dati aggiornati, tono distintivo, integrazione con piattaforma sociale.

Memoria

La memoria dipende molto dal prodotto e meno da una caratteristica universalmente nota come nel caso di ChatGPT. Il valore aggiunto è più nell’accesso informativo dinamico che nella personal memory.

Parametri e architettura

I dettagli completi non sono sempre pubblici. Come altri modelli proprietari, Grok resta relativamente opaco sul piano architetturale.

In più, la forte associazione con un ecosistema social introduce rischi specifici:

- dipendenza da segnali rumorosi;

- possibile amplificazione di contenuti polarizzati;

- difficoltà nel valutare la qualità delle fonti in tempo reale.

Punti di forza

- forte integrazione con dati e flussi aggiornati;

- stile più diretto;

- interessante per monitoraggio informativo;

- posizionamento differenziato rispetto ai modelli più “istituzionali”.

Limiti

- ecosistema meno maturo rispetto a OpenAI e Google;

- minore standardizzazione enterprise;

- percezione pubblica molto legata al brand e alla figura di Musk;

- affidabilità da valutare caso per caso in ambiti formali;

- trasparenza limitata sul funzionamento effettivo e sulle policy di trattamento dei dati.

Utilizzi ideali

Grok può essere utile soprattutto per: analisi di trend, monitoraggio dell’attualità, uso connesso a social data, scenari dove serve accesso rapido a informazioni recenti e tono meno formale.

8. Llama di Meta

Posizionamento generale

Llama è la famiglia di modelli open weight di Meta ed è probabilmente la più importante nel panorama aperto occidentale. Ha avuto un ruolo decisivo nel rendere possibile un ecosistema di sviluppo indipendente basato su modelli eseguibili anche localmente.

Finestra di contesto

La finestra di contesto varia a seconda della versione e delle implementazioni. In generale, Llama offre buone capacità, ma il vero valore sta nella flessibilità del deployment più che nel primato assoluto sul contesto.

Multimodalità

Le versioni base di Llama sono state storicamente più centrate sul testo, anche se l’ecosistema si è allargato con estensioni, adattamenti e integrazioni multimodali.

Memoria

La memoria persistente non è una caratteristica nativa “consumer” come nei prodotti chiusi. Tuttavia, chi sviluppa su Llama può costruire sistemi con memoria applicativa personalizzata.

Parametri e architettura

A differenza dei modelli proprietari, Llama rende disponibili molti più elementi pratici: pesi del modello, taglie differenti, documentazione tecnica più accessibile, possibilità di quantizzazione e fine-tuning.

Il numero di parametri dipende dalla versione: esistono modelli più piccoli e più grandi, pensati per casi d’uso diversi.

Va però evitata una lettura ingenua: Llama non è “open source puro” nel senso classico. La disponibilità dei pesi non coincide automaticamente con piena trasparenza su dataset, training completo e libertà totale di utilizzo.

Punti di forza

- ecosistema enorme;

- possibilità di esecuzione locale;

- fine-tuning relativamente accessibile;

- adatto a progetti custom;

- forte community;

- grande importanza strategica per l’open ecosystem.

Limiti

- spesso inferiore ai migliori modelli chiusi di frontiera in esperienza “out of the box”;

- richiede competenze tecniche per ottenere il massimo;

- licenza non completamente libera in senso classico;

- multimodalità e allineamento dipendono molto dalle implementazioni;

- rischio di frammentazione e qualità molto variabile tra fork e versioni derivate.

Utilizzi ideali

Llama è ideale per: ricerca e sperimentazione, sviluppo on-premise, privacy e controllo del deployment, personalizzazione aziendale, prodotti che richiedono indipendenza da API esterne.

9. Mistral

Posizionamento generale

Mistral AI rappresenta uno dei casi più interessanti del panorama occidentale, soprattutto europeo. La società si è distinta per la capacità di produrre modelli molto efficienti, con ottime performance rispetto alla dimensione.

Finestra di contesto

Le capacità contestuali variano per modello, ma Mistral si è fatta apprezzare soprattutto per il rapporto tra efficienza, costo e qualità, più che per il marketing della sola finestra di contesto.

Multimodalità

Mistral si sta muovendo anche verso la multimodalità, ma il suo tratto distintivo storico è stato soprattutto l’eccellenza nei modelli testuali compatti ed efficienti.

Memoria

Come per Llama, la memoria persistente dipende dal sistema costruito attorno al modello, non tanto da una funzione consumer nativa.

Parametri e architettura

Qui Mistral è molto interessante perché ha puntato su: modelli compatti, architetture efficienti, in alcuni casi Mixture of Experts (MoE), come nella linea Mixtral.

Questo consente di ottenere qualità elevata senza costi inferenziali proporzionali a un modello denso enorme.

Punti di forza

- efficienza eccellente;

- ottimo rapporto prestazioni/dimensione;

- molto interessante per deployment aziendali;

- forte valore strategico europeo;

- buone performance in coding e NLP generale.

Limiti

- ecosistema più piccolo di Llama;

- alcuni modelli di punta restano commerciali;

- meno centralità mediatica rispetto ai giganti USA;

- apertura solo parziale, con strategia ibrida tra open e chiuso.

Utilizzi ideali

Mistral è molto adatto per: aziende che cercano efficienza, deployment custom, applicazioni professionali con costi controllati, ambienti europei sensibili alla sovranità tecnologica.

10. Confronto sintetico per parametro

10.1 Finestra di contesto

- Claude e Gemini sono spesso percepiti come leader nei contesti molto ampi.

- ChatGPT offre contesti molto solidi e ben integrati nell’esperienza utente.

- Grok è più interessante per aggiornamento dinamico che per il solo contesto.

- Llama e Mistral dipendono molto dalla specifica versione e implementazione.

10.2 Multimodalità

- Gemini è tra i più forti per impostazione multimodale.

- ChatGPT è molto avanzato e ben fruibile lato utente.

- Claude è forte ma storicamente più centrato sul testo lungo.

- Grok evolve in questa direzione, con identità ancora distinta.

- Llama e Mistral hanno capacità più variabili e spesso meno native.

10.3 Memoria

- ChatGPT è forte nella memoria utente come prodotto.

- Claude eccelle nel contesto lungo più che nella memoria personale.

- Gemini può sfruttare l’ecosistema Google.

- Grok punta più sull’accesso live.

- Llama e Mistral richiedono memoria applicativa costruita dagli sviluppatori.

10.4 Parametri e trasparenza

- Llama e in parte Mistral offrono maggiore trasparenza pratica.

- ChatGPT, Claude, Gemini e Grok sono molto più opachi su parametri reali e architettura.

10.5 Architettura

- i modelli chiusi usano architetture non del tutto pubbliche e fortemente ottimizzate;

- Mistral si distingue per l’uso intelligente di approcci efficienti come MoE;

- Llama resta il riferimento più importante per l’ecosistema open weight generalista.

10.6 Rischio commerciale

- ChatGPT, Claude e Gemini sono molto forti ma espongono a lock-in elevato.

- Grok ha un rischio aggiuntivo legato alla dipendenza da un ecosistema social specifico.

- Llama e Mistral riducono il lock-in tecnico, ma richiedono più competenze e infrastruttura interna.

11. Confronto per utilizzo

11.1 Uso quotidiano generalista

Vince spesso ChatGPT, grazie a: interfaccia matura, multimodalità, memoria, versatilità, facilità d’uso.

11.2 Analisi di documenti lunghi

Claude è spesso tra i migliori, soprattutto per: PDF lunghi, contratti, policy, comparazioni testuali complesse. Anche Gemini è molto forte in questo campo.

11.3 Multimodalità avanzata

Gemini e ChatGPT sono i riferimenti principali.

11.4 Coding

Dipende molto dal task:

- Claude Sonnet è spesso apprezzatissimo nel coding pratico;

- ChatGPT resta molto forte e versatile;

- Mistral e Llama possono essere eccellenti se ben fine-tuned;

- Grok è interessante ma meno standard enterprise.

11.5 Deployment locale e personalizzazione

Qui i migliori sono chiaramente: Llama, Mistral.

I modelli proprietari non competono davvero su questo terreno, perché il loro business è basato su API e piattaforme controllate.

11.6 Privacy e controllo

Per organizzazioni che vogliono: controllo totale dei dati, esecuzione on-premise, audit del comportamento, customizzazione profonda, le scelte migliori sono i modelli open weight come Llama e Mistral.

11.7 Enterprise integrato

- ChatGPT è forte per produttività generalista;

- Claude eccelle in contesti professionali document-heavy;

- Gemini è molto competitivo in ambienti Google-centric;

- Llama/Mistral sono forti quando l’azienda vuole costruire internamente.

11.8 Attualità e segnali dal web sociale

Grok ha un vantaggio distintivo in scenari legati a: trend in tempo reale, segnali social, monitoraggio live.

12. Tabella comparativa tra piattaforme aggregate e AI hub

Di seguito una tabella comparativa tra alcune piattaforme che offrono accesso a più modelli o servizi AI integrati. La tabella non valuta solo la comodità d’uso, ma anche il grado di trasparenza e i rischi commerciali.

| Piattaforma | Link | Funzione principale | Modelli multipli | Trasparenza su versioni/modelli | Rischio lock-in | Uso ideale | Criticità principali |

|---|---|---|---|---|---|---|---|

| Perplexity | perplexity.ai | AI search e answer engine | Sì, in parte | Media | Medio-alto | ricerca, sintesi web, domande con fonti | dipendenza dalla piattaforma, modello non sempre centrale rispetto al layer di ricerca |

| Hix.ai | hix.ai | suite di scrittura e produttività AI | Sì/variabile | Bassa-media | Alto | content generation, marketing, scrittura rapida | forte logica commerciale, poca chiarezza tecnica, rischio output standardizzati |

| NinjaChat | ninjachat.ai | accesso aggregato a più modelli | Sì | Bassa | Alto | utenti che vogliono più modelli in un solo abbonamento | opacità su versioni reali, dipendenza da intermediario, sostenibilità incerta |

| Abacus AI | abacus.ai | piattaforma AI enterprise e agenti | Sì | Media | Medio | aziende, workflow AI, agenti e automazione | complessità di pricing, forte dipendenza dal vendor, trasparenza tecnica non totale |

| GlobalGPT | globalgpt.com | hub per accesso a modelli multipli | Sì | Bassa | Alto | test comparativi, accesso centralizzato | poca chiarezza su governance, modelli e policy dati |

| Giz.ai | giz.ai | AI workspace / accesso a strumenti multipli | Sì | Bassa-media | Alto | produttività personale, sperimentazione | rischio di intermediazione opaca e scarsa chiarezza sui backend |

| OmniGPT | omnigpt.co | accesso unificato a più LLM | Sì | Bassa-media | Alto | utenti che vogliono un solo pannello per più modelli | dipendenza da piattaforma terza, stabilità del servizio da verificare, trasparenza parziale |

Lettura critica della tabella

Queste piattaforme hanno un vantaggio evidente: semplificano l’accesso. Invece di pagare più abbonamenti o gestire più account, l’utente ha un unico punto di ingresso. Tuttavia, i rischi sono significativi:

- Intermediazione opaca – L’utente spesso non ha visibilità completa sul backend reale.

- Versioni non sempre chiare – “Claude”, “GPT” o “Gemini” possono essere etichette commerciali non accompagnate da dettagli tecnici precisi.

- Dipendenza da un intermediario – Se la piattaforma cambia accordi, prezzi o policy, l’utente perde accesso o continuità.

- Problemi di privacy – I prompt passano attraverso un soggetto in più, con implicazioni importanti per dati sensibili e riservatezza.

- Sostenibilità commerciale incerta – Molte piattaforme aggregate dipendono da margini sottili, accordi variabili o modelli di business ancora non consolidati.

In breve: sono strumenti comodi, ma non sempre ideali per usi professionali critici o per dati sensibili.

13. Proprietari vs open: differenze profonde

Il confronto non è solo tecnico, ma anche strategico.

Modelli proprietari

Vantaggi

- qualità “pronta all’uso” molto alta;

- allineamento raffinato;

- interfacce mature;

- tool integrati;

- aggiornamenti centralizzati.

Svantaggi

- poca trasparenza;

- lock-in;

- costi ricorrenti;

- scarso controllo sul modello;

- dipendenza da roadmap commerciali non controllabili dall’utente.

Modelli open weight

Vantaggi

- maggiore controllo;

- esecuzione locale;

- personalizzazione;

- costi più prevedibili nel lungo periodo;

- valore strategico per sovranità digitale.

Svantaggi

- qualità iniziale spesso inferiore ai top closed models;

- maggiore complessità tecnica;

- necessità di infrastruttura interna;

- allineamento e sicurezza da curare direttamente;

- apertura solo parziale in molti casi.

14. Considerazioni finali

Il panorama degli LLM occidentali è oggi estremamente articolato. Non esiste un modello “migliore in assoluto” per tutto: esistono modelli più adatti a diversi contesti.

- ChatGPT è probabilmente il più forte come assistente generalista e prodotto completo.

- Claude Sonnet e Opus brillano nell’analisi documentale, nel ragionamento e in molti scenari professionali.

- Gemini Pro è fortissimo nella multimodalità e nell’integrazione con l’ecosistema Google.

- Grok ha un’identità peculiare, molto interessante per attualità e integrazione con flussi informativi live.

- Llama resta il pilastro dell’ecosistema open weight occidentale.

- Mistral è il campione dell’efficienza e una delle realtà più strategiche per l’Europa.

Ma una lettura davvero critica impone di aggiungere altro: il mercato degli LLM sta diventando sempre più un mercato di accessi mediati, marchi forti, ecosistemi chiusi e interfacce che nascondono l’infrastruttura reale. L’utente finale spesso vede un chatbot, ma non vede:

- chi controlla i dati;

- chi cambia il modello;

- chi decide i filtri;

- chi conserva i prompt;

- chi può interrompere il servizio;

- chi impone il prezzo.

La vera scelta, quindi, non va fatta solo guardando i benchmark, ma rispondendo a domande più concrete:

- serve un assistente personale o una piattaforma enterprise?

- conta di più la qualità immediata o il controllo del deployment?

- è importante la multimodalità?

- servono memoria, strumenti e interfacce integrate?

- il modello deve girare in locale?

- il costo è per token, per abbonamento o per infrastruttura propria?

- il caso d’uso è generalista, documentale, creativo, tecnico o industriale?

- quanto rischio commerciale siamo disposti ad accettare?

- quanto è importante sapere davvero quale modello stiamo usando?

In definitiva, la comparazione tra LLM oggi è una comparazione tra visioni del prodotto, architetture industriali, strategie geopolitiche e regimi di opacità commerciale, oltre che tra modelli linguistici.

Usare Google

Oggi “usare l’AI di Google” significa in pratica muoversi dentro tre ambienti diversi, che però poggiano tutti (direttamente o indirettamente) sulla stessa famiglia di modelli Gemini.

1. Gemini: l’assistente “per persone”

Qui parliamo dell’app/chat che usi da browser o smartphone, l’equivalente di ChatGPT lato Google.

- Interfaccia conversazionale per scrivere, riassumere, fare coding, analizzare documenti, generare immagini, fare “deep research”, ecc.

- Integrato nell’ecosistema Google (Gmail, Drive, Calendar, Maps, YouTube…) con capacità sempre più “agentiche”: recupera info, organizza contenuti, compie micro‑azioni.

- Target: utente finale (studente, docente, professionista), non per forza sviluppatore.

In sintesi: Gemini è il front‑end umano della famiglia di modelli, l’assistente quotidiano.

2. Google AI Studio: il laboratorio per sviluppatori (e power user)

Google AI Studio è una piattaforma web per progettare, testare e preparare al deploy applicazioni che usano i modelli Gemini (e modelli media come Imagen, Veo, ecc.).

- IDE nel browser per sperimentare prompt, catene di chiamate, strumenti multimodali (testo, immagini, video, audio).

- Genera snippet di codice e chiavi API per integrare Gemini in app, backend, bot, plugin, ecc.

- Include funzioni avanzate: structured output (JSON, tabelle), grounding con Google Search, URL come contesto, streaming in tempo reale, ecc.

- Target: sviluppatori, team prodotto, ma anche “no/low‑code” con un minimo di dimestichezza tecnica.

In sintesi: AI Studio è il ponte tra modello e software: qui “plasmi” il comportamento del modello e poi lo porti nelle tue applicazioni.

3. Google Labs: il parco giochi sperimentale

Google Labs (e Search Labs) è l’ombrello sotto cui Google rilascia esperimenti AI dentro Search, Chrome e altri prodotti.

- Include cose come Search Generative Experience (AI Overviews), prototipi nel browser, strumenti creativi e di produttività sperimentali.

- Usa dietro le quinte i modelli Gemini e affini, ma tu li vivi come “feature di prodotto”: nuove modalità di ricerca, Workspace, Chrome, app creative, tool educativi, ecc.

- Target: early adopter e utenti curiosi che vogliono provare in anteprima funzioni non ancora “mainstream”.

In sintesi: Labs è la vetrina sperimentale dove vedi come Google infila l’AI nei suoi servizi prima che diventi standard.

Schema riassuntivo

| Cosa è | Ruolo principale | Target | Livello tecnico richiesto |

|---|---|---|---|

| Gemini | Assistente AI conversazionale | Utenti finali | Basso |

| Google AI Studio | IDE per app con Gemini | Dev / power user | Medio‑alto |

| Google Labs | Feature AI sperimentali | Early adopter | Basso |

Panoramica dell’Indice di Intelligenza Artificiale

L’Artificial Intelligence Index Report 2025 è una risorsa completa che monitora e analizza i progressi e l’impatto dell’IA in diversi ambiti. Rappresenta uno strumento fondamentale per decisori politici, ricercatori, giornalisti e pubblico per prendere decisioni informate sullo sviluppo e l’implementazione dell’IA. Il rapporto è riconosciuto a livello globale per i suoi dati rigorosamente validati e forniti a livello globale.

LMArena

HuggingFace

Due Portali Fondamentali per Esplorare l’AI: Hugging Face e LMArena

Per chi si avvicina oggi al mondo dell’Intelligenza Artificiale, navigare tra migliaia di modelli, versioni e paper scientifici può sembrare un compito impossibile. Per trasformare questa complessità in un’opportunità di apprendimento pratico, esistono due piattaforme imprescindibili: Hugging Face e LMArena. Questi due siti rappresentano rispettivamente la più grande biblioteca di strumenti open-source e il principale tribunale dove i modelli vengono giudicati dal pubblico.

Il primo video (Hugging Face) ci introduce in quello che viene definito il “GitHub dell’Intelligenza Artificiale”. Hugging Face non è solo un sito di download, ma un ecosistema vitale per studenti e sviluppatori. Qui troverete:

- Il Hub dei Modelli: Migliaia di modelli pre-addestrati (come Llama, BERT, Stable Diffusion) pronti per essere scaricati e utilizzati nei vostri progetti.

- Datasets e Documentazione: Risorse essenziali per capire su quali dati sono stati istruiti i modelli e come implementarli.

- Gli Spaces: Un’area demo interattiva dove è possibile testare modelli di generazione immagini, audio o testo direttamente dal browser, senza scrivere una riga di codice. Per uno studente, Hugging Face è il laboratorio dove la teoria incontra la pratica: permette di non ripartire da zero, imparando a modificare e riutilizzare tecnologie all’avanguardia.

Il secondo video (LMArena – Large Model Arena) ci porta sul lato competitivo e valutativo dell’AI. Spesso i benchmark accademici (i test standardizzati) non raccontano l’intera storia di come un modello si comporta nella vita reale. LMArena risolve questo problema con un approccio democratico:

- Blind Test (Test alla Cieca): L’utente pone una domanda e due modelli anonimi rispondono. Voi, come giudici, votate la risposta migliore.

- Classifica ELO: Ogni voto aggiorna una classifica dinamica. Questo permette di vedere non solo chi è il “campione” (spesso GPT-4 o Claude), ma anche quali modelli open source si stanno avvicinando alle prestazioni dei giganti. Utilizzare LMArena sviluppa il pensiero critico: non dovete credere ciecamente al marketing di un’azienda, ma potete verificare con i vostri occhi le differenze qualitative tra un modello e l’altro.

In sintesi: Hugging Face vi dà gli strumenti per costruire, LMArena vi dà la bussola per valutare. Entrambi sono essenziali per formare una visione completa e consapevole del futuro dell’AI. Vi invitiamo a guardare i video per una guida passo-passo su come iniziare a esplorare queste risorse.

LLM occidentali a confronto: ChatGPT, Claude, Gemini, Grok, Llama e Mistral

Negli ultimi anni i Large Language Models sono passati dall’essere una tecnologia per specialisti a uno strumento centrale nella vita digitale di milioni di persone. Oggi vengono usati per scrivere testi, analizzare documenti, programmare, tradurre, sintetizzare informazioni, creare immagini, gestire flussi di lavoro aziendali e persino interagire vocalmente in tempo reale. Ma dietro la sigla LLM non esiste un unico modello dominante: esiste invece un ecosistema molto competitivo, in cui si confrontano piattaforme proprietarie e modelli open weight, ciascuno con caratteristiche tecniche e casi d’uso differenti.

In questo articolo analizziamo i principali LLM occidentali, con un focus su ChatGPT di OpenAI, Claude Sonnet e Claude Opus di Anthropic, Gemini di Google, Grok di xAI e sui modelli aperti più influenti, cioè Llama di Meta e Mistral. Il confronto non si limita ai benchmark, ma prende in considerazione parametri concreti come finestra di contesto, multimodalità, memoria, architettura, trasparenza, flessibilità e utilizzi reali.

Un mercato che non si misura solo in benchmark

Per molto tempo il dibattito sugli LLM si è concentrato quasi esclusivamente sulle prestazioni nei test standardizzati. Oggi però questo approccio non basta più. Un modello può essere eccellente in un benchmark e risultare meno efficace nell’uso quotidiano; al contrario, un sistema con numeri meno impressionanti può offrire un’esperienza migliore per scrittura, coding, lavoro su documenti o integrazione aziendale.

Per questo, confrontare gli LLM significa guardare almeno a sei dimensioni fondamentali: quanto contesto riescono a gestire, quanto sono multimodali, se dispongono di memoria persistente, quanto sono trasparenti sul piano tecnico, quanto sono facili da integrare e soprattutto per quali utilizzi sono realmente più adatti.

ChatGPT: il modello più completo come prodotto

ChatGPT resta il punto di riferimento più noto e più usato nel mercato occidentale. Il suo vantaggio non sta solo nel modello sottostante, ma nel fatto di essere diventato un vero prodotto AI generalista, capace di unire qualità linguistica, multimodalità, strumenti, interfaccia e memoria utente.

Dal punto di vista della finestra di contesto, i modelli di OpenAI offrono capacità molto solide, sufficienti per gestire conversazioni lunghe, analizzare file, lavorare su codice articolato e affrontare task multi-step. Sul piano della multimodalità, ChatGPT è tra i sistemi più maturi: può lavorare con testo, immagini, file e voce, e in molte configurazioni offre un’esperienza d’uso molto fluida anche per utenti non tecnici.

Uno dei suoi punti di forza più evidenti è la memoria persistente integrata nel prodotto, che permette al sistema di ricordare preferenze, stile e contesto dell’utente tra sessioni diverse. Questo lo rende particolarmente efficace come assistente personale o professionale continuativo. Sul fronte tecnico, OpenAI non pubblica in modo completo dettagli come il numero di parametri o l’architettura precisa dei modelli più recenti, e questo limita la trasparenza. Tuttavia, in termini di esperienza complessiva, ChatGPT resta probabilmente il sistema più equilibrato per l’uso generalista.

È particolarmente indicato per produttività personale, scrittura, brainstorming, supporto professionale, analisi di documenti, automazione leggera e assistenza multimodale quotidiana. Il suo limite principale è quello tipico dei modelli proprietari: forte dipendenza dalla piattaforma, poca trasparenza tecnica e impossibilità di deployment locale.

Claude: il re dei testi lunghi e dell’analisi documentale

Se ChatGPT è il modello più completo come prodotto, Claude di Anthropic è spesso considerato il più forte quando il lavoro ruota intorno a testi lunghi, documenti complessi e ragionamento strutturato. Le versioni Sonnet e Opus coprono esigenze diverse: la prima punta a un ottimo equilibrio tra costo, velocità e qualità; la seconda è pensata per compiti più sofisticati e ad alta intensità cognitiva.

La caratteristica che più distingue Claude è la grande finestra di contesto, che lo rende particolarmente efficace nella lettura di PDF estesi, contratti, policy, documentazione tecnica e raccolte di testi da confrontare. È un modello molto apprezzato anche per la sua capacità di seguire istruzioni articolate e restituire risposte ordinate, leggibili e coerenti.

Sul piano della multimodalità, Claude si è evoluto, ma il suo vantaggio competitivo resta soprattutto nella gestione del testo lungo. Quanto alla memoria, più che sulla personalizzazione persistente, Anthropic ha costruito il proprio valore sulla robustezza del contesto nella sessione corrente. Anche qui i dettagli architetturali completi non sono pubblici.

Claude Sonnet è spesso scelto per coding, analisi professionale e workflow aziendali, mentre Opus è più adatto a ragionamento profondo, scrittura sofisticata e analisi ad alta complessità. In ambito enterprise, Claude è uno dei modelli più credibili per contesti document-heavy come legale, compliance, policy e revisione di contenuti.

Gemini: la forza della multimodalità e dell’ecosistema Google

Gemini rappresenta la risposta di Google alla corsa agli LLM. Il suo vantaggio strategico non è solo nel modello, ma nell’integrazione con l’enorme infrastruttura e l’ecosistema del gruppo: cloud, produttività, ricerca, ambienti di sviluppo e strumenti multimodali.

Gemini è particolarmente forte nella multimodalità, cioè nella capacità di combinare testo, immagini, audio, video e documenti complessi. In questo senso è uno dei modelli più interessanti per il futuro delle interfacce AI, perché nasce con un’impostazione meno puramente testuale rispetto ad altri sistemi. Anche la finestra di contesto è molto competitiva, soprattutto in scenari di analisi documentale ampia e workflow enterprise.

La memoria in senso stretto dipende molto dal prodotto finale, ma il vero vantaggio di Gemini sta nella sua potenziale integrazione con gli strumenti Google, dai documenti al cloud fino alle applicazioni di produttività. Per organizzazioni già immerse nell’ecosistema Google, Gemini può rappresentare una scelta molto naturale.

I suoi casi d’uso ideali sono workflow multimodali, analisi documentale, automazione in ambienti cloud e applicazioni che combinano testo, immagini e dati. Più che un semplice chatbot, Gemini va letto come un tassello di una strategia più ampia di Google sull’AI integrata.

Grok: il modello più vicino al tempo reale

Grok, sviluppato da xAI, occupa una posizione particolare nel panorama occidentale. Non punta tanto a essere il modello più istituzionale o il più “neutro”, quanto a differenziarsi per accesso all’informazione aggiornata, integrazione con la piattaforma X e stile più diretto.

La sua identità è legata soprattutto alla capacità di lavorare in un ambiente informativo dinamico, dove attualità, segnali social e trend in tempo reale contano molto. In questo senso, più che per la sola finestra di contesto o per la memoria, Grok si distingue per il suo legame con un flusso informativo “live”.

Questo lo rende interessante per monitoraggio dell’attualità, analisi dei trend, uso connesso ai social data e scenari in cui serve una risposta rapida su eventi recenti. Il rovescio della medaglia è che Grok, almeno rispetto ai concorrenti più maturi, appare ancora meno standardizzato per l’uso enterprise tradizionale e più dipendente dal proprio ecosistema di riferimento.

Llama: il pilastro dell’ecosistema open weight

Sul fronte dei modelli aperti, Llama di Meta è probabilmente la famiglia più importante. Il suo ruolo storico è stato decisivo perché ha permesso la nascita di un intero ecosistema di strumenti, quantizzazioni, fine-tuning, deployment locali e applicazioni indipendenti.

Llama non compete con i modelli proprietari tanto sul piano dell’esperienza pronta all’uso, quanto su quello del controllo, della personalizzazione e della libertà di implementazione. La finestra di contesto varia a seconda delle versioni e delle implementazioni, mentre la multimodalità non è sempre nativa come nei grandi modelli chiusi. Anche la memoria persistente non è una funzione “di prodotto”, ma qualcosa che gli sviluppatori possono costruire a livello applicativo.

Il vero punto di forza di Llama è la trasparenza pratica: pesi disponibili, possibilità di esecuzione locale, fine-tuning, quantizzazione e integrazione in ambienti privati. Per questo è ideale per ricerca, sviluppo custom, deployment on-premise, applicazioni che richiedono privacy e controllo, e progetti che vogliono evitare il lock-in delle API proprietarie.

Mistral: efficienza e sovranità europea

Se Llama è il riferimento open weight globale, Mistral è il caso più interessante in Europa. La società francese si è imposta rapidamente grazie a modelli molto efficienti, spesso capaci di offrire prestazioni elevate rispetto alla loro dimensione.

Mistral ha puntato molto su architetture intelligenti e, in alcuni casi, su approcci Mixture of Experts, che permettono di ottenere buoni risultati mantenendo relativamente bassi i costi inferenziali. Come Llama, anche Mistral è particolarmente interessante per deployment personalizzati, ambienti aziendali e casi d’uso in cui efficienza e controllo sono più importanti del brand consumer.

Il suo valore è doppio: da un lato tecnico, perché offre un ottimo rapporto tra qualità e costo; dall’altro strategico, perché rappresenta una delle poche risposte europee credibili al dominio americano nel settore AI. Mistral è quindi molto adatto a aziende che cercano modelli performanti ma efficienti, deployment controllati e soluzioni compatibili con esigenze di sovranità tecnologica.

Il confronto per utilizzo

Guardando all’uso concreto, emergono alcune tendenze abbastanza chiare.

Per uso quotidiano generalista, il modello più forte resta ChatGPT, grazie alla sua interfaccia, alla memoria, alla multimodalità e all’equilibrio complessivo. Per analisi di documenti lunghi, Claude è spesso il più convincente, soprattutto in ambiti professionali. Per multimodalità avanzata, i riferimenti principali sono Gemini e ChatGPT. Nel coding, la sfida è più aperta: Claude Sonnet è molto apprezzato, ChatGPT resta fortissimo, mentre Llama e Mistral diventano competitivi quando vengono ben adattati a casi specifici.

Per privacy, controllo e deployment locale, i vincitori sono chiaramente Llama e Mistral, perché i modelli proprietari non sono pensati per questo tipo di utilizzo. Per attualità e segnali dal web sociale, Grok ha un posizionamento unico. In ambito enterprise, invece, la scelta dipende molto dall’ambiente: ChatGPT è forte nella produttività generalista, Claude nei contesti documentali, Gemini negli ecosistemi Google-centric, mentre Llama e Mistral sono preferibili quando l’azienda vuole costruire una soluzione interna.

Conclusione

Il panorama degli LLM occidentali non è dominato da un unico vincitore assoluto. Ogni modello incarna una diversa idea di intelligenza artificiale: ChatGPT come piattaforma generalista completa, Claude come specialista del testo lungo e del ragionamento documentale, Gemini come motore multimodale integrato nell’ecosistema Google, Grok come modello orientato al tempo reale, Llama come infrastruttura aperta per sviluppatori e Mistral come risposta efficiente e strategica europea.

La vera domanda, quindi, non è quale modello sia “il migliore” in astratto, ma quale sia il più adatto al contesto d’uso. Oggi scegliere un LLM significa scegliere non solo una tecnologia, ma anche un equilibrio tra prestazioni, costo, controllo, trasparenza, integrazione e visione strategica.

STESURA FINALE – VERSIONE ACCADEMICA/ANALITICA

Analisi comparativa dei principali LLM occidentali: ChatGPT, Claude, Gemini, Grok, Llama e Mistral

Introduzione

Il mercato dei Large Language Models (LLM) ha conosciuto una rapida evoluzione, trasformandosi da settore sperimentale a infrastruttura centrale per applicazioni consumer, enterprise e di ricerca. I modelli linguistici di ultima generazione non si limitano più alla generazione testuale, ma integrano capacità di ragionamento, coding, gestione di contesti estesi, interazione multimodale e supporto a workflow complessi. In tale scenario, i principali attori occidentali possono essere suddivisi in due grandi categorie: modelli proprietari, come quelli sviluppati da OpenAI, Anthropic, Google e xAI, e modelli open weight, come Llama di Meta e Mistral.

Il presente contributo propone una comparazione tra ChatGPT/GPT, Claude Sonnet e Claude Opus, Gemini, Grok, Llama e Mistral, prendendo in esame alcuni parametri condivisi: finestra di contesto, multimodalità, memoria, trasparenza sui parametri, architettura, flessibilità d’uso e adeguatezza rispetto a specifici scenari applicativi. L’obiettivo è mostrare come la valutazione di un LLM non possa più basarsi esclusivamente su benchmark astratti, ma debba considerare anche il comportamento operativo, la governance della piattaforma e il grado di controllabilità del modello.

Criteri di comparazione

L’analisi si struttura attorno a sei dimensioni principali.

La prima è la finestra di contesto, cioè la quantità di token che il modello può elaborare in una singola interazione. Questo parametro è particolarmente rilevante in compiti quali analisi documentale, coding su basi di codice estese e reasoning multi-step.

La seconda è la multimodalità, intesa come capacità di elaborare non solo testo, ma anche immagini, audio, video e documenti complessi. In prospettiva, essa costituisce uno dei principali fattori di differenziazione tra i modelli.

La terza dimensione è la memoria, che va distinta in memoria contestuale di sessione e memoria persistente tra sessioni. Quest’ultima non dipende solo dal modello in senso stretto, ma anche dal prodotto e dall’infrastruttura applicativa che lo circonda.

Il quarto criterio riguarda i parametri e l’architettura. In molti modelli proprietari tali informazioni non sono pubbliche in modo esaustivo, mentre nei modelli open weight risultano maggiormente accessibili. Oggi, tuttavia, il numero di parametri non è più sufficiente a spiegare le prestazioni: contano anche qualità dei dati, ottimizzazione architetturale e tecniche di allineamento.

La quinta dimensione è la trasparenza e controllabilità, che distingue in modo netto i modelli chiusi da quelli aperti o semi-aperti.

Infine, il sesto criterio è l’adeguatezza rispetto agli usi concreti, vale a dire la capacità del modello di rispondere efficacemente a esigenze reali come produttività personale, analisi di documenti, coding, deployment locale, automazione aziendale e monitoraggio informativo.

ChatGPT / GPT di OpenAI

ChatGPT rappresenta il caso più emblematico di trasformazione di un LLM in piattaforma generalista. Il suo vantaggio competitivo non risiede esclusivamente nelle prestazioni del modello, ma nell’integrazione tra modello, interfaccia, strumenti, multimodalità e memoria utente.

Dal punto di vista della finestra di contesto, i modelli GPT di ultima generazione offrono capacità elevate, adeguate alla gestione di documenti lunghi, task articolati e conversazioni estese. Sul piano della multimodalità, OpenAI ha sviluppato un ecosistema capace di combinare testo, immagini, file e interazione vocale, rendendo ChatGPT uno dei sistemi più completi per l’utente finale.

Un ulteriore elemento distintivo è la presenza, in alcune configurazioni, di memoria persistente, che consente al sistema di personalizzare l’interazione nel tempo. Ciò rafforza il ruolo di ChatGPT come assistente continuativo. Rimane tuttavia un forte limite di trasparenza: OpenAI non rende pubblici in modo completo né il numero di parametri né l’architettura dettagliata dei modelli più recenti.

Nel complesso, ChatGPT appare particolarmente adatto a uso generalista, produttività personale, scrittura, analisi di file, brainstorming e supporto professionale trasversale. Risulta invece meno adatto a contesti che richiedono pieno controllo del deployment o audit approfondito del modello.

Claude Sonnet e Claude Opus

Claude, sviluppato da Anthropic, si distingue per un posizionamento centrato su affidabilità, sicurezza, coerenza del ragionamento e capacità di lavorare su contesti estesi. Le varianti Sonnet e Opus rispondono a esigenze differenti: Sonnet privilegia il compromesso tra costo e prestazioni, Opus punta invece a massimizzare la qualità nei task più complessi.

La caratteristica più rilevante di Claude è l’ampiezza della finestra di contesto, che lo rende particolarmente efficace nell’analisi di grandi documenti, contratti, policy, basi testuali e materiali tecnici. Tale capacità lo rende uno strumento privilegiato in contesti professionali document-centric. Anche nella scrittura strutturata e nel coding Claude mostra prestazioni molto competitive.

Per quanto riguarda la multimodalità, il modello si è evoluto, ma il suo tratto distintivo resta il trattamento del testo lungo. La memoria persistente non costituisce il suo principale elemento differenziante; il valore è piuttosto nella qualità del mantenimento del contesto all’interno della sessione. Anche in questo caso, parametri e architettura non sono completamente noti.

Claude risulta particolarmente indicato per analisi documentale, revisione di policy, legal tech, compliance, coding professionale e scrittura ad alta struttura argomentativa.

Gemini di Google

Gemini va interpretato non soltanto come un modello, ma come parte di una strategia più ampia di Google sull’intelligenza artificiale. Il suo punto di forza è la combinazione tra capacità modellistica, infrastruttura cloud e integrazione con l’ecosistema Google.

Sul piano della finestra di contesto, Gemini si colloca tra i modelli più competitivi, soprattutto in scenari di analisi estesa e uso enterprise. Tuttavia, il suo principale vantaggio comparativo è la multimodalità nativa, che lo rende particolarmente adatto a task che coinvolgono testo, immagini, audio, video e documenti complessi. In prospettiva, questa caratteristica è centrale per l’evoluzione delle interfacce AI.

La memoria dipende in larga misura dal prodotto e dal livello di integrazione con gli strumenti Google, più che da una funzione autonoma del modello. Quanto a parametri e architettura, Google mantiene un livello di opacità simile a quello degli altri provider proprietari.

Gemini appare particolarmente efficace in workflow multimodali, contesti enterprise legati al cloud, automazione documentale e applicazioni che richiedono integrazione con ambienti Google-centric.

Grok di xAI

Grok occupa una posizione atipica nel panorama degli LLM occidentali. Il suo valore distintivo non è tanto nella sola performance linguistica, quanto nella capacità di inserirsi in un ecosistema informativo dinamico, fortemente connesso alla piattaforma X.

Più che per la memoria o per la sola ampiezza del contesto, Grok si segnala per la sua prossimità all’informazione aggiornata e per un posizionamento meno istituzionale rispetto ai concorrenti principali. Questo lo rende particolarmente interessante in scenari di monitoraggio dell’attualità, analisi di trend e osservazione di segnali provenienti dai social media.

Dal punto di vista enterprise, tuttavia, Grok appare meno maturo e meno standardizzato rispetto a ChatGPT, Claude o Gemini. Rimane quindi un modello promettente, ma con una specializzazione più evidente in ambiti informativi dinamici che non in workflow professionali tradizionali.

Llama di Meta

Llama costituisce il pilastro fondamentale dell’ecosistema open weight occidentale. Il suo impatto non deriva soltanto dalle prestazioni, ma soprattutto dall’aver reso disponibile una base modellistica su cui la comunità di ricerca e sviluppo ha potuto costruire strumenti, adattamenti, quantizzazioni e deployment locali.

A differenza dei modelli proprietari, Llama offre una maggiore trasparenza pratica: i pesi sono accessibili, il fine-tuning è possibile, l’inferenza locale è realizzabile e l’integrazione in ambienti privati risulta relativamente agevole. La finestra di contesto e la multimodalità dipendono dalla specifica versione e dalle implementazioni derivate; la memoria persistente non è una funzione nativa del modello, ma può essere costruita a livello applicativo.

Llama è quindi particolarmente adatto a ricerca, sperimentazione, sviluppo custom, deployment on-premise, ambienti sensibili alla privacy e applicazioni che richiedono controllo diretto dell’infrastruttura. Rispetto ai migliori modelli proprietari, può risultare meno rifinito nell’esperienza out of the box, ma compensa con un grado di controllabilità molto superiore.

Mistral

Mistral rappresenta uno degli attori più rilevanti del panorama europeo. Il suo tratto distintivo è l’efficienza: la società ha dimostrato che architetture ben progettate e modelli relativamente compatti possono raggiungere prestazioni molto competitive.

Anche nel caso di Mistral, la finestra di contesto varia per modello, mentre la memoria persistente dipende dall’implementazione applicativa. Il punto più interessante è l’attenzione all’ottimizzazione architetturale, inclusi approcci di tipo Mixture of Experts, che consentono di migliorare il rapporto tra qualità e costo inferenziale.

Mistral risulta particolarmente indicato per deployment aziendali efficienti, personalizzazione, scenari europei attenti alla sovranità tecnologica e applicazioni professionali che richiedono un buon equilibrio tra prestazioni e costo. Il suo ecosistema è meno ampio di quello di Llama, ma il valore strategico e tecnico della piattaforma è in costante crescita.

Confronto per scenari d’uso

Se si osservano i modelli dal punto di vista dell’uso concreto, emergono alcune linee di tendenza.

Per uso quotidiano generalista, ChatGPT appare il più completo, grazie alla qualità dell’interfaccia, alla memoria, alla multimodalità e alla versatilità generale. Per analisi di documenti lunghi, Claude si colloca ai vertici, soprattutto in contesti professionali e document-centric. Per multimodalità avanzata, Gemini e ChatGPT risultano i riferimenti principali. Per monitoraggio dell’attualità e segnali social, Grok presenta un vantaggio distintivo.

Quando invece il criterio prioritario è il controllo dell’infrastruttura, la privacy o il deployment locale, i modelli open weight come Llama e Mistral risultano superiori ai modelli proprietari. In ambito enterprise, la scelta dipende fortemente dall’ecosistema di riferimento: ChatGPT è competitivo nella produttività generalista, Claude nella document analysis, Gemini negli ambienti Google-centric, mentre Llama e Mistral risultano preferibili laddove l’organizzazione voglia costruire una soluzione interna e controllata.

Conclusione

L’analisi comparativa mostra che il panorama degli LLM occidentali è ormai fortemente differenziato. Non esiste un unico modello ottimale per ogni scenario; esistono piuttosto modelli che incarnano differenti equilibri tra prestazioni, multimodalità, trasparenza, controllo, integrazione e specializzazione d’uso.

ChatGPT emerge come il sistema più completo per l’uso generalista; Claude eccelle nell’analisi documentale e nel ragionamento su contesti estesi; Gemini si distingue per la multimodalità e l’integrazione ecosistemica; Grok per il legame con l’informazione in tempo reale; Llama e Mistral per la controllabilità, la personalizzazione e la rilevanza strategica dell’open ecosystem.

Di conseguenza, la scelta di un LLM non può essere ridotta a una graduatoria assoluta. Essa richiede invece una valutazione contestuale, che tenga conto del tipo di utilizzo, del livello di controllo desiderato, dei vincoli di costo, dei requisiti di privacy e del grado di dipendenza accettabile da una piattaforma proprietaria.

TABELLA COMPARATIVA FINALE

| Modello | Tipo | Punto di forza principale | Contesto | Multimodalità | Memoria | Trasparenza tecnica | Uso ideale |

|---|---|---|---|---|---|---|---|

| ChatGPT / GPT | Proprietario | Esperienza completa e versatile | Alto | Molto forte | Sì, in alcune configurazioni | Bassa | Uso generalista, produttività, scrittura, assistenza |

| Claude Sonnet / Opus | Proprietario | Testi lunghi e analisi documentale | Molto alto | Buona | Più contestuale che persistente | Bassa | Documenti, policy, legale, coding |

| Gemini | Proprietario | Multimodalità ed ecosistema Google | Molto alto | Molto forte | Dipende dal prodotto | Bassa | Workflow multimodali, cloud, enterprise |

| Grok | Proprietario | Informazione aggiornata e segnali social | Buono | In crescita | Limitata/variabile | Bassa | Trend, attualità, monitoraggio live |

| Llama | Open weight | Controllo, personalizzazione, ecosistema | Variabile | Variabile | Da costruire a livello app | Media/alta | Deployment locale, ricerca, privacy |

| Mistral | Open weight / ibrido | Efficienza e ottimo rapporto qualità/costo | Variabile | Variabile | Da costruire a livello app | Media | Aziende, deployment efficienti, sovranità tecnologica |

Tabella comparativa degli LLM occidentali

La tabella seguente non pretende di fissare valori assoluti e immutabili, perché il settore evolve rapidamente e molte aziende aggiornano spesso i modelli. Serve piuttosto come mappa ragionata per capire dove ogni famiglia di modelli tende a collocarsi.

| Modello | Tipo | Finestra di contesto | Multimodalità | Memoria | Trasparenza su parametri/architettura | Deployment locale | Punto di forza principale | Utilizzo ideale |

|---|---|---|---|---|---|---|---|---|

| ChatGPT / GPT | Proprietario | Alta | Molto alta | Alta lato prodotto | Bassa | No | Versatilità generale | produttività, scrittura, assistenza, analisi file |

| Claude Sonnet | Proprietario | Molto alta | Buona | Media | Bassa | No | equilibrio tra qualità e costo | coding, documenti, uso enterprise |

| Claude Opus | Proprietario | Molto alta | Buona | Media | Bassa | No | ragionamento e profondità | task complessi, analisi avanzata |

| Gemini Pro | Proprietario | Molto alta | Molto alta | Media/alta in ecosistema | Bassa | No | multimodalità e integrazione Google | cloud, enterprise, documenti, media |

| Grok | Proprietario | Alta | In crescita | Media | Bassa | No | attualità e dati live | trend analysis, social intelligence |

| Llama | Open weight | Variabile | Variabile | Bassa nativa / alta se costruita | Medio-alta | Sì | flessibilità e community | local AI, custom apps, ricerca |

| Mistral | Open / ibrido | Variabile | Variabile | Bassa nativa / alta se costruita | Medio-alta | Sì | efficienza | enterprise custom, cost optimization |

Come gestire l’Ecosistema AI

L’UNICA Guida AI che ti serve nel 2026 perché ogni settimana esce un nuovo tool AI e ti dicono che se non lo usi sei già indietro. Il risultato? Salti da un’app all’altra senza padroneggiarne nessuna. La verità è che l’AI non è più solo un chatbot: è un ecosistema enorme. In questo video scoprirai i 5 fondamentali definitivi che separano chi ottiene risultati reali da chi perde solo tempo. Non ti serve un nuovo strumento, ti serve un sistema.Cosa imparerai in questa guida all’Intelligenza Artificiale:

- Costruzione del Prompt: Il framework CO-STAR (Context, Objective, Style, Tone, Audience, Response) per smettere di trattare l’AI come Google.

- I 4 Strumenti Essenziali: Cervelli generali (ChatGPT, Claude, Gemini), Motori di ricerca, Specialisti e Automatizzatori.

- Agenti AI: Come delegare interi flussi di lavoro invece di scrivere semplici prompt.

- AI + I Tuoi Dati: Come usare i tuoi dati (Custom GPTs, Claude Projects, Gemini Gems) per ottenere un vantaggio competitivo inarrestabile.

- Vibe Coding: Come creare app e software descrivendoli a parole, senza sapere una riga di codice (usando tool come Lovable).

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI