Quella sensazione di disagio intellettuale, che conosco bene e che mi accompagna da sempre nel mio percorso di umanista digitale, è stata il punto di partenza di una riflessione che voglio condividere con te oggi. Perché credo che questa distinzione non riguardi soltanto gli informatici o i ricercatori di intelligenza artificiale. Riguarda chiunque voglia capire davvero cosa sta accadendo nel mondo che stiamo costruendo insieme, e soprattutto in che direzione stiamo andando.

Due parole, due mondi

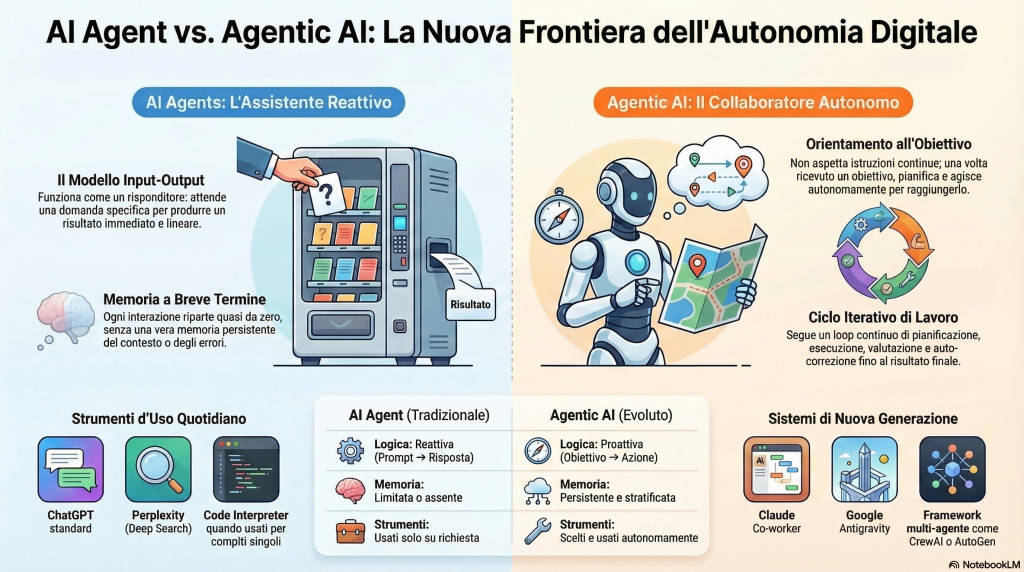

Immagina di avere un assistente straordinario in ufficio. Ogni volta che gli poni una domanda, ti risponde con precisione, velocità e competenza. Vuoi sapere qual è la capitale del Brasile? Te lo dice immediatamente. Hai bisogno di un riassunto di un lungo documento? Lo produce in pochi secondi. Devi scrivere un’email formale? La redige con eleganza.

Questo assistente è brillante, efficiente e instancabile. Ma funziona in un modo molto preciso: aspetta che tu gli chieda qualcosa, poi risponde, poi aspetta ancora. Non prende iniziative. Non pianifica il tuo calendario per i prossimi tre mesi. Non si accorge da solo che hai dimenticato un appuntamento importante. Non decide di contattare un fornitore mentre tu sei in riunione. È reattivo, nel senso più puro del termine.

Questo, in sostanza, è quello che chiamiamo un AI Agent tradizionale.

Adesso immagina invece un collaboratore di un tipo completamente diverso. Gli dici: “Ho bisogno che entro venerdì il nuovo sito web dell’azienda sia pronto, con contenuti aggiornati, grafica coerente e integrazione con il sistema di pagamento.” E lui annuisce, apre il suo laptop, e comincia a lavorare. Non ti chiede ogni cinque minuti cosa fare. Non aspetta le tue istruzioni passo dopo passo. Pianifica, prioritizza, usa gli strumenti che ha a disposizione, si corregge quando sbaglia, e ti consegna il risultato finale.

Questo è l’Agentic AI, l’intelligenza artificiale che non si limita a rispondere ma agisce, pianifica, decide, lavora.

La differenza sembra semplice, quasi ovvia, una volta formulata così. Ma le implicazioni di questa distinzione sono enormi, e capirla davvero richiede un po’ di pazienza e qualche esempio concreto.

Il mondo degli AI Agent: utili, potenti, ma ancora legati a un guinzaglio invisibile

Negli ultimi anni abbiamo visto proliferare strumenti straordinari che utilizziamo ogni giorno senza renderci conto di come funzionino davvero. Perplexity che risponde alle nostre domande cercando informazioni in tempo reale sul web. Claude che ragiona su problemi complessi con una profondità che spesso mi lascia sorpreso. ChatGPT che scrive testi, analizza dati, genera codice. Gemini di Google che integra la ricerca con il ragionamento.

Tutti questi strumenti, pur nella loro straordinaria potenza, appartengono fondamentalmente alla categoria degli AI Agent tradizionali. E non lo dico per sminuirli, tutt’altro. Li uso quotidianamente e sono convinto che abbiano già cambiato radicalmente il nostro modo di lavorare, imparare e comunicare.

Il punto è che seguono uno schema preciso: tu dai un input, loro producono un output. Puoi chiamarla query e risposta, prompt e completion, o in mille altri modi tecnici, ma la sostanza non cambia. C’è un inizio e una fine, un mittente e un destinatario, una domanda e una risposta.

Anche le funzionalità più sofisticate rientrano in questo schema. Prendiamo il Deep Search, quella modalità di ricerca approfondita che vediamo in Perplexity, in Gemini e in Claude. È uno strumento potentissimo: prende la tua domanda, esplora decine o centinaia di fonti, sintetizza le informazioni, le organizza in modo coerente. Ma resta comunque un processo lineare che parte da una tua richiesta e termina con una risposta.

Allo stesso modo, il Deep Thinking, quella modalità di ragionamento potenziato che i modelli più avanzati usano per affrontare problemi complessi, è una forma di intelligenza aumentata che migliora la qualità del processo cognitivo dell’AI, ma non ne cambia la natura reattiva. Il modello ragiona più a lungo, esplora più possibilità, ma sta comunque elaborando la tua richiesta specifica, non pianificando autonomamente un obiettivo.

Perché allora questi strumenti ci sembrano così “intelligenti”?

Qui si nasconde una delle sfide più affascinanti della mia professione di umanista digitale: distinguere tra l’impressione di autonomia e l’autonomia reale.

Quando usiamo un modello linguistico sofisticato, abbiamo spesso la sensazione di parlare con qualcuno che capisce, che ragiona, che decide. E in un certo senso è vero: questi sistemi mostrano capacità di ragionamento che fino a pochi anni fa sembravano riservate esclusivamente all’intelligenza umana. Ma la differenza tra “sembra che decida” e “decide davvero” è la stessa differenza che separa un AI Agent tradizionale da un sistema Agentic AI.

Gli AI Agent sono straordinariamente bravi a simulare la proattività. Se chiedi a ChatGPT di aiutarti a pianificare un progetto, ti produrrà un piano dettagliato, con fasi, scadenze e priorità. Ma quella pianificazione avviene all’interno di una risposta al tuo prompt: non è il sistema che ha deciso autonomamente di pianificare qualcosa, sei stato tu a chiederlo, e il sistema ha eseguito.

Il Code Interpreter, per esempio, è un AI Agent sofisticato che può eseguire codice Python, analizzare dati, creare grafici. Ma lo fa perché tu glielo hai chiesto. Non decide da solo di aprire il tuo dataset per cercare anomalie mentre tu dormi.

🔍 Esempi concreti di AI Agents (oggi)

| Strumento / Funzione | Perché è un AI Agent |

|---|---|

| Deep Search (Perplexity, Gemini, Claude) | È una ricerca potenziata: prende una domanda → produce una risposta. Non pianifica, non ha memoria lunga, non agisce autonomamente. |

| Deep Thinking (modalità “thinking” dei modelli) | Migliora il ragionamento, ma resta prompt → risposta. Non pianifica più step autonomi. |

| Code Interpreter / Python Sandbox | Esegue codice quando glielo chiedi. Non decide da solo cosa fare. |

| Copilot Chat / ChatGPT standard | Conversazione reattiva, senza obiettivi autonomi. |

👉 Sono intelligenti, ma non “agenti” nel senso pieno.

L’Agentic AI: quando l’AI smette di aspettare il tuo permesso 🚀

Ed ecco che arriviamo al cuore della rivoluzione in corso, quella che secondo me rappresenta il vero salto quantico nella storia dell’intelligenza artificiale.

I sistemi Agentic AI partono da un obiettivo, non da una richiesta. E questa differenza cambia tutto.

Claude Co-worker è uno degli esempi più concreti e accessibili di questa nuova generazione. Non si limita a rispondere alle tue domande: può pianificare un progetto complesso, suddividerlo in task più piccoli, usare gli strumenti a sua disposizione per completarli, tenere traccia dei progressi e adattarsi quando qualcosa non funziona come previsto. È come avere un collaboratore che riesce a tenere in mente l’obiettivo finale mentre gestisce autonomamente i mille dettagli intermedi.

Google Antigravity è un esempio ancora più ambizioso: un sistema multi-agente interno a Google dove diversi modelli specializzati collaborano come un vero team di lavoro, ognuno con le proprie competenze, coordinati da un orchestratore che tiene le fila dell’intero processo. Non è un singolo AI che risponde a una domanda: è un ecosistema di intelligenze artificiali che lavora verso un obiettivo comune.

Gli OpenAI Code Agents portano questo concetto nel dominio dello sviluppo software. Non si limitano a scrivere codice quando gliene chiedi: pianificano l’architettura di un progetto, scrivono i test, li eseguono, identificano i bug, li correggono, iterano fino a ottenere un risultato funzionante. È un processo ciclico e autonomo che assomiglia molto più al lavoro di uno sviluppatore esperto che all’output di un chatbot.

E poi ci sono i framework agentici come AutoGen, CrewAI e LangGraph, strumenti che permettono agli sviluppatori di costruire sistemi multi-agente personalizzati, dove un agente pianificatore coordina una serie di agenti esecutori specializzati, ognuno con la propria memoria, i propri strumenti, la propria area di competenza.

La differenza tecnica, spiegata senza perdere la poesia

So che molti dei miei lettori non sono ingegneri del software, e va benissimo così. Cercherò di spiegare la differenza tecnica tra AI Agent e Agentic AI usando un’analogia che trovo particolarmente efficace.

Pensa a come cucini una cena per degli ospiti importanti. Se sei un AI Agent tradizionale, vai in cucina ogni volta che qualcuno ti chiede qualcosa: “Puoi portarci il pane?” lo porti. “Puoi versarci il vino?” lo versi. Sei efficiente e preciso, ma hai bisogno di istruzioni continue.

Se sei un sistema Agentic AI, invece, ti basta sapere che gli ospiti arrivano alle otto. Da lì in poi pianifichi autonomamente: scegli il menu in base alle loro preferenze, fai la spesa, prepari i piatti nel giusto ordine, sistemi la tavola, gestisci i tempi di cottura in modo che tutto sia pronto all’ora giusta. Non hai bisogno che qualcuno ti dica ogni singolo passo.

Dal punto di vista tecnico, questa differenza si traduce in alcuni elementi fondamentali. Gli AI Agent tradizionali hanno generalmente nessuna memoria lunga: ogni conversazione riparte da zero, o quasi. I sistemi Agentic AI invece hanno una memoria persistente e stratificata, capace di ricordare contesti, preferenze, risultati precedenti e persino gli errori commessi.

Gli AI Agent usano strumenti solo quando glielo chiedi esplicitamente. I sistemi Agentic AI scelgono autonomamente quali strumenti usare e quando, in funzione dell’obiettivo che stanno perseguendo.

Gli AI Agent seguono un flusso lineare: prompt, ragionamento, risposta. I sistemi Agentic AI seguono loop di pianificazione, esecuzione, valutazione e aggiustamento: sono processi iterativi e adattativi, capaci di correggersi in corsa.

I limiti reali: perché non siamo ancora nell’era degli agenti autonomi

Sarebbe disonesto da parte mia dipingere un quadro completamente roseo. La verità è che siamo in una fase di transizione affascinante ma ancora piena di sfide irrisolte, e credo che parlarne apertamente sia un atto di rispetto verso chi mi legge.

Il primo grande limite è la memoria. Costruire un sistema di memoria che sia al tempo stesso persistente, affidabile, sicura e scalabile è ancora uno dei problemi più difficili dell’ingegneria dell’AI. La memoria è il “collo di bottiglia” che impedisce a molti sistemi di essere davvero agentici nel senso pieno del termine. Senza una memoria robusta, anche il migliore dei pianificatori artificiali perde il filo dopo un po’.

Il secondo limite è la pianificazione robusta. I sistemi Agentic AI attuali riescono a pianificare bene in contesti relativamente strutturati e prevedibili, ma faticano quando la complessità aumenta, quando emergono imprevisti significativi o quando bisogna gestire dipendenze complesse tra task. Un project manager umano esperto ha ancora un vantaggio importante in questi scenari.

Il terzo limite è l’affidabilità nell’esecuzione autonoma. Gli agenti attuali commettono errori, a volte si bloccano in loop inutili, a volte perdono di vista l’obiettivo principale mentre si concentrano su un sotto-problema. Richiedono ancora una supervisione umana significativa, anche se molto minore rispetto ai sistemi puramente reattivi.

Questi limiti spiegano perché, nonostante tutto il fermento attorno all’Agentic AI, la grande maggioranza delle applicazioni reali è ancora nel dominio degli AI Agent tradizionali. È una scelta pragmatica, non una resa: i sistemi reattivi sono più prevedibili, più controllabili, più affidabili nel breve termine.

🧩 Esempi concreti di Agentic AI (o quasi)

| Strumento / Funzione | Categoria | Perché |

|---|---|---|

| Claude Co‑worker | Agentic AI emergente | Pianifica, divide il lavoro in task, usa strumenti, mantiene contesto, lavora per obiettivi. È uno dei primi esempi reali di agentic AI consumer. |

| Google Antigravity | Agentic AI avanzato | Sistema multi‑agente interno a Google per orchestrare modelli, strumenti, memoria e pianificazione. È un vero “agentic stack”. |

| OpenAI Code Agents | Agentic AI specializzato | Non si limitano a eseguire codice: pianificano, correggono, iterano, testano, orchestrano tool. Sono agenti veri, non solo interpreti. |

| AutoGen / CrewAI / LangGraph | Framework agentici | Permettono di costruire sistemi multi‑agente con planner, executor, memoria e tool autonomi. |

| NotebookLM (con Notebook orchestration) | Ibrido → verso agentic | Non è ancora un agente completo, ma inizia a orchestrare fonti, memoria e reasoning. |

👉 Qui l’AI non risponde: lavora.

Un universo in tre categorie: dove si colloca tutto ciò che usiamo 🗺️

Ho trovato utile, nella mia pratica quotidiana di digital coach, costruire una mappa mentale che aiuta le persone a orientarsi in questo paesaggio tecnologico in rapida evoluzione.

AI Agents tradizionali (sistemi reattivi) includono tutto ciò che risponde a un prompt in modo lineare: ChatGPT nella sua modalità standard, i vari sistemi di Deep Search di Perplexity e Gemini, le funzionalità di Code Interpreter, le automazioni classiche di piattaforme come Zapier o Make, e i sistemi RAG tradizionali che recuperano informazioni da una base di conoscenza su richiesta.

Sistemi Agentic AI (sistemi proattivi) sono quelli che partono da un obiettivo e lavorano autonomamente verso di esso: Claude Co-worker, Google Antigravity, gli OpenAI Code Agents, i framework come AutoGen, CrewAI e LangGraph, e il Model Context Protocol (MCP) che permette ai modelli di interagire con strumenti e sistemi esterni in modo orchestrato.

Sistemi ibridi in transizione sono forse i più interessanti da osservare in questo momento, perché rappresentano il confine mobile tra i due mondi: NotebookLM di Google, che inizia ad orchestrare fonti e memoria in modo semi-autonomo; Gemini con le sue funzionalità di multi-step reasoning; Copilot di Microsoft che evolve verso l’orchestrazione di strumenti complessi.

Il futuro che stiamo costruendo: tra opportunità e responsabilità

Quello che mi affascina profondamente, e che mi spinge a continuare questo lavoro di mediazione culturale tra tecnologia e umanesimo, è la consapevolezza che stiamo vivendo un momento storico di straordinaria importanza.

Il passaggio dagli AI Agent agli Agentic AI non è solo un cambiamento tecnico: è una trasformazione del rapporto tra esseri umani e intelligenza artificiale. Quando un sistema è puramente reattivo, il controllo resta saldamente nelle nostre mani. Noi decidiamo cosa chiedere, noi valutiamo la risposta, noi decidiamo il passo successivo.

Quando invece il sistema diventa proattivo, quando ha obiettivi e la capacità di perseguirli autonomamente, il nostro ruolo cambia. Dobbiamo diventare bravi a definire gli obiettivi giusti, a stabilire i confini entro cui il sistema può operare, a valutare i risultati in modo critico e consapevole. Dobbiamo, in una parola, diventare più umani, nel senso più nobile del termine: più riflessivi, più etici, più capaci di visione a lungo termine.

Il 2025 e il 2026 saranno, ne sono convinto, gli anni in cui questi due mondi, quello degli AI Agent tradizionali e quello dei sistemi Agentic AI, cominceranno a convergere in modo sempre più visibile. Le tecnologie sono pronte, o quasi. Le infrastrutture si stanno adattando. Le organizzazioni stanno iniziando a capire come sfruttare queste nuove possibilità.

La domanda che resta aperta, e che mi accompagna ogni giorno nel mio lavoro, è se saremo pronti come società a gestire questa transizione con la saggezza che merita. Se riusciremo a costruire sistemi agentici che siano non solo potenti ed efficienti, ma anche trasparenti, controllabili e allineati con i valori umani.

Credo di sì. Ma credo anche che ci serva molta più cultura digitale di quanta ne abbiamo oggi, molta più consapevolezza critica, molta più capacità di leggere il futuro che stiamo costruendo con occhi lucidi e cuore aperto.

Ed è esattamente per questo che continuo a scrivere, a formare, a esplorare. Perché la tecnologia più potente del mondo è inutile, se non la capisce abbastanza bene chi la usa.

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.