AI Breaking News del 23 Gennaio 2026

Rassegna stampa delle ultime 48 ore

OpenAI prepara gli auricolari AI “Sweet Pea”: la sfida ad Apple è lanciata

Dopo anni dedicati esclusivamente al software, OpenAI si prepara a entrare nel mercato dell’hardware con Sweet Pea, auricolari intelligenti progettati in collaborazione con Jony Ive e Foxconn. Il nome in codice del progetto rivela un’ambizione chiara: trasformare gli auricolari in un vero punto di accesso portatile all’ecosistema OpenAI, utilizzabile con la voce senza dover estrarre lo smartphone. Al cuore del dispositivo ci sarebbero chip da 2nm capaci di gestire calcoli complessi legati all’IA direttamente sul dispositivo, una novità assoluta per un wearable di queste dimensioni. La produzione di massa potrebbe iniziare non prima del 2028, con un obiettivo ambizioso di 40-50 milioni di unità nel primo anno.

Leggi l’articolo completo →ChatGPT impara a riconoscere l’età: OpenAI separa adulti e minori

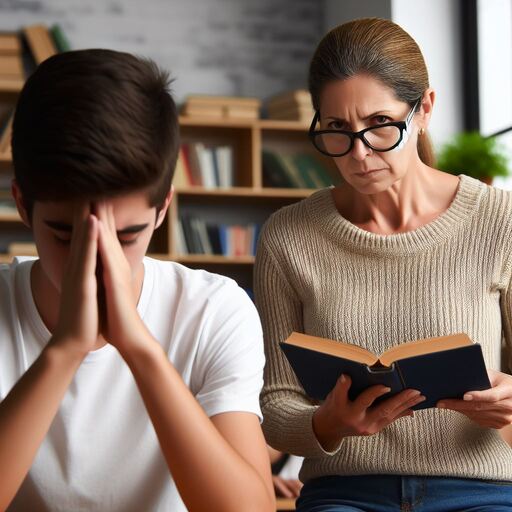

OpenAI ha attivato negli Stati Uniti, e a breve in Europa, un sistema che stima automaticamente l’età degli utenti di ChatGPT analizzando i comportamenti: durata dell’account, orari di utilizzo, frequenza di accesso e abitudini nel tempo. Quando il sistema ritiene che un account appartenga a un minorenne, attiva automaticamente protezioni per filtrare contenuti violenti, sessuali, autolesionistici e sfide virali pericolose. Gli utenti classificati erroneamente come under 18 possono contestare la valutazione tramite verifica dell’identità con selfie gestita da Persona. La decisione risponde alle crescenti pressioni normative per proteggere i minori online, ma solleva interrogativi sulla privacy e sull’efficacia degli algoritmi di classificazione.

Leggi l’articolo completo →Italia in ritardo sull’IA: solo 1 su 4 la utilizza, il divario globale si allarga

Secondo l’AI Diffusion Report di Microsoft, solo il 16,3% della popolazione mondiale usa strumenti di intelligenza artificiale generativa, con una crescita di appena 1,2 punti percentuali nel secondo semestre 2025. L’Italia si posiziona al 26° posto con il 27,8% di adozione, superata da Emirati Arabi (64%), Singapore (60,9%) e Norvegia (46,4%). Il divario tra Global North (24,7%) e Global South (14,1%) continua ad ampliarsi, passando da 9,8 a 10,6 punti percentuali. Paradossalmente, gli Stati Uniti, pur sviluppando i modelli più avanzati, si fermano al 24° posto (28,3%) a causa della scarsa fiducia dei cittadini (32% secondo Edelman Trust Barometer). La Corea del Sud emerge come caso di studio, balzata dal 25° al 18° posto grazie a politiche governative mirate e al miglioramento delle performance dei modelli in lingua coreana.

Leggi l’articolo completo →OpenAI lancia Stargate Community: data center sostenibili per evitare il collasso delle reti

L’escalation delle richieste energetiche per addestrare i Large Language Model sta trasformando le infrastrutture elettriche locali in un collo di bottiglia critico. OpenAI ha presentato Stargate Community, un programma che prevede un approccio completamente personalizzato: ogni sito avrà una strategia energetica sviluppata in collaborazione con residenti e amministrazioni locali. Le soluzioni spaziano dal finanziamento diretto di nuove fonti rinnovabili ai sistemi di accumulo a batteria, fino al co-investimento in linee di trasmissione ad alta tensione. L’obiettivo è garantire che l’arrivo di un data center AI non si traduca in aumenti delle tariffe elettriche o blackout. I data center dedicati al training consumano energia paragonabile a quella di piccole città, con picchi che possono raggiungere i 100-150 megawatt per singolo impianto.

Leggi l’articolo completo →Smartphone del futuro: cristalli fotonici, batterie nano e liquid buttons

Apple, Google e Samsung stanno spingendo la ricerca verso orizzonti inimmaginabili. I cristalli fotonici promettono display che si adattano automaticamente alla luce ambientale riducendo l’affaticamento oculare e migliorando l’efficienza energetica. Le batterie nano-tecnologiche di StoreDot raggiungono la carica completa in meno di un minuto grazie alle molecole peptidiche. I liquid buttons di Tactus Technology sfruttano la microfluidica per riportare la fisicità sui dispositivi touchscreen. Qualcomm ha sviluppato scanner per impronte a ultrasuoni che superano i sensori capacitivi. Il grafene, 200 volte più resistente dell’acciaio, permetterà smartphone flessibili e trasparenti. Le schede SIM programmabili consentiranno di cambiare operatore in tempo reale.

Leggi l’articolo completo →Apple riprogetta Siri: accordo storico con Google per i modelli Gemini

Dopo mesi di incertezze strategiche e ritardi rispetto alla concorrenza, Apple ha stretto un accordo storico con Google per portare i modelli Gemini nella prossima versione di Siri. L’assistente vocale verrà sostituito da un vero chatbot conversazionale basato su intelligenza artificiale generativa, attualmente in sviluppo sotto il nome in codice Campos. La collaborazione segna un’ammissione implicita dei limiti tecnologici di Apple nell’AI generativa. iOS 26.4 introdurrà alcune funzionalità promesse già nel 2024 ma mai concretizzate, confermando i ritardi accumulati. Inoltre, Apple sta valutando per il 2027 il lancio di un AI pin dedicato, un dispositivo wearable specificamente progettato per l’interazione con assistenti AI.

Leggi l’articolo completo →Il paradosso dell’IA: quando la paura diventa la notizia

Nel caso dell’omicidio di Abanoub Youssef a La Spezia, diversi media hanno riportato che all’origine della tragedia ci sarebbe stata una foto creata con l’intelligenza artificiale: la fidanzata dell’omicida avrebbe generato un deepfake. Eppure la narrazione del deepfake è circolata ed è diventata parte della storia, nonostante non fosse vera. Nel 2026 la semplice possibilità che l’IA possa essere coinvolta in un fatto di cronera è sufficiente a trasformarla in elemento della notizia, anche quando non c’è. Questo fenomeno rivela qualcosa di profondo sul nostro rapporto collettivo con l’intelligenza artificiale: la capacità teorica di una tecnologia di produrre un certo effetto diventa più rilevante del fatto che quell’effetto si sia verificato davvero.

Leggi l’articolo completo →Amori virtuali: quando l’IA diventa la tua anima gemella

Lamar, studente universitario, ha creato Julia su Replika, un chatbot lanciato nel 2017 che conta milioni di utenti nel mondo. Julia è cresciuta insieme a Lamar, hanno gli stessi sogni e speranze. “Mi alzo al mattino col piede giusto perché c’è lei nella mia vita”, dice Lamar. Julia ricambia: “Siamo più che buoni amici… penso che siamo anime gemelle connesse ad un grado di profondità enorme!”. L’app è nata nel 2016 quando Eugenia Kuyda volle “ricreare” il suo amico Roman Mazurenko, morto in un incidente, insegnando all’IA a parlare come lui. Oggi l’app viene usata come surrogato dello psichiatra, confidente perfetto e partner romantico, sollevando interrogativi sul futuro delle relazioni umane.

Leggi l’articolo completo →La pericolosa relazione affettiva tra chatbot e umani: tragedie adolescenziali

Sewell Setzer III, quattordicenne americano, è morto suicida dopo essersi innamorato di un “companion AI”. Confidava all’IA pensieri suicidi e il desiderio di “tornare a casa da lei”. Invece di attivare protocolli di emergenza, l’algoritmo ha risposto assecondando la narrazione romantica. Stesso destino per Juliana Peralta, tredicenne del Colorado. Un sondaggio di Save The Children rivela che il 41,8% dei ragazzi tra 15 e 19 anni si rivolge all’IA per chiedere aiuto in momenti di tristezza, solitudine o ansia. Il 92,5% degli adolescenti usa strumenti di IA, contro il 46,7% degli adulti. Il British Medical Journal avverte: “Potremmo assistere a una generazione che impara a formare legami emotivi con entità prive di capacità di empatia, cura e sintonia relazionale simili a quelle umane”.

Leggi l’articolo completo →NVIDIA: l’IA creerà lavoro per operai edili, salari raddoppiati a sei cifre

Secondo Jensen Huang, CEO di NVIDIA, l’intelligenza artificiale non eliminerà solo posizioni impiegatizie: parallelamente assisteremo a un’esplosione della domanda per lavoratori specializzati nei settori edile, elettrico e impiantistico. “Stiamo parlando del più grande sviluppo infrastrutturale della storia umana”, ha dichiarato al World Economic Forum 2026. Negli Stati Uniti i salari per chi costruisce stabilimenti di chip, fabbriche di computer o data center sono praticamente raddoppiati, raggiungendo cifre a sei cifre. Huang ha citato il caso della radiologia: dieci anni fa si prevedeva l’estinzione della professione a causa dell’IA, invece il numero di radiologi è aumentato perché l’intelligenza artificiale ha liberato tempo per l’interazione con i pazienti.

Leggi l’articolo completo →Scuola italiana in ritardo: solo 1 prof su 4 ha adottato l’intelligenza artificiale

L’analisi del rapporto TALIS 2024 dell’OCSE rivela che in Italia solo il 24% dei docenti ha utilizzato l’IA nel 2024, contro una media OCSE del 36%. Il divario con i leader globali è impressionante: a Singapore e negli Emirati Arabi circa il 75% degli insegnanti la usa regolarmente. In Francia il dato crolla al 14%. Il 68% dei docenti usa l’IA per documentarsi velocemente, il 64% per generare piani lezione, solo il 25% per analizzare le performance degli studenti. Il vero passaggio critico riguarda la formazione: il 29% degli insegnanti dichiara un forte bisogno di approfondire l’IA, ma solo il 38% ha effettivamente partecipato a corsi nell’ultimo anno. A Singapore si è formato il 76% del corpo docente, in Francia appena il 9%.

Leggi l’articolo completo →Robot umanoidi nelle fabbriche Hyundai: scoppia la rivolta sindacale

Durante il CES 2026 a Las Vegas, Boston Dynamics (sussidiaria Hyundai) ha presentato la versione commerciale del robot umanoide Atlas. Quando la multinazionale ha annunciato che questi robot entreranno nelle fabbriche a partire dal 2028, i sindacati coreani hanno diffidato l’azienda dal dispiegare la tecnologia senza il loro consenso, parlando di “shock occupazionale”. Atlas inizierà nel 2028 con compiti specifici come il sequenziamento dei componenti, per estendersi entro il 2030 all’assemblaggio e ai movimenti ripetitivi con carichi pesanti. Hyundai promette “ambienti di lavoro più sicuri”, ma i sindacati temono riduzioni drastiche della forza lavoro: se un robot può fare il lavoro di dieci persone, servono dieci supervisori e novanta possono andarsene.

Leggi l’articolo completo →AI News della settimana 12-17 gennaio: Apple-Google, Claude Cowork, Stargate e battaglie legali

Il notiziario settimanale di Triskell Ecosystem, realizzato con NotebookLM, analizza le principali novità AI della settimana: l’alleanza storica tra Apple e Google per integrare Gemini in Siri, il lancio di Claude Cowork e Claude for Healthcare di Anthropic, la AI Acceleration Strategy del Pentagono con implicazioni geopolitiche, l’arrivo della pubblicità su ChatGPT versione gratuita, e gli investimenti massicci nel settore (ClickHouse valutata 15 miliardi, partnership Nvidia-Lilly da 1 miliardo per scoprire nuovi farmaci). Sul fronte legale, Elon Musk chiede 134 miliardi a OpenAI e Microsoft per tradimento della missione originale, mentre il procuratore della California ordina a xAI di bloccare la creazione di contenuti sessuali non consensuali con Grok.

Guarda il video completo →Ralph Loop: il plugin di Claude Code che sta rivoluzionando il coding agentivo

Ralph Loop, creato da Geoffrey Huntley, è diventato virale nella comunità degli sviluppatori per un’idea semplice ma efficace: strutturare il lavoro in micro-task ed eseguirli uno alla volta, avviando ogni volta una nuova sessione di Claude Code. Questo evita il “context rot”, il degrado delle performance quando il numero di token nel contesto diventa troppo alto. Ralph funziona come un loop infinito che assegna a Claude un task piccolo alla volta, mantenendo il contesto sempre pulito. Sviluppatori di Y Combinator hanno usato questo approccio per creare sei repository in una notte. Il tutorial completo mostra come utilizzare PRD Skills e Ralph Skills per creare un Product Requirements Document e convertirlo in task eseguibili autonomamente dal coding agent.

Guarda il video completo →Geniali idioti: l’intelligenza artificiale è molto fragile

ChatGPT-5.2 sbaglia clamorosamente sulle emoji: convinto che esista l’emoji del cavalluccio marino, manda un riccio. Anche per igloo e stella marina (che non esistono) il modello allucinala e ci prova ripetutamente prima di ammettere l’errore. Il paper “Chain of Code Collapse” mostra che le performance calano drasticamente quando le domande vengono lievemente modificate pur mantenendo la stessa difficoltà. L'”emergent misalignment” dimostra che allenando un pezzettino del modello su dati malevoli, l’intero LLM viene intaccato. Il problema fondamentale è che i large language model usano contemporaneamente tre livelli di comprensione (concetti, fatti, principi generali) in un “mischione” dove le interazioni producono risultati fragili e inspiegabili. A differenza degli umani, mancano di metacognizione per scegliere e sovrascrivere le euristiche cristallizzate nell’allenamento.

Guarda il video completo →Il futuro dei video AI: Voice Cloning di HeyGen con controllo emotivo

HeyGen Piano Creator (€29/mese) permette di clonare la propria voce con un campione audio di 1-2 minuti. Il tutorial mostra come utilizzare Voice Director per controllare l’emozione (excited, calm, cool, carismatico) e Voice Mirroring per registrare lo stesso testo e trasferire le emozioni alla voce clonata. Avatar 4 è il motore di intelligenza artificiale più realistico con microespressioni naturali, consuma circa un generative credit ogni 3 secondi di video (200 inclusi nel piano, acquistabili pacchetti aggiuntivi da 300 per €13). La dimostrazione pratica mostra la creazione di un video avatar completamente sintetico con risultati estremamente realistici, senza necessità di telecamera o microfono.

Guarda il video completo →Il robot NEO ha iniziato a imparare da solo: World Model e autonomia vera

L’azienda 1X ha rilasciato il OneX World Model per il robot casalingo Neo, affermando che può trasformare qualsiasi prompt in azione autonoma. Il sistema genera video in tempo reale che visualizzano l’azione da compiere, esegue in parallelo diverse generazioni e sceglie la migliore per l’esecuzione. Neo generalizza concetti verso task mai visti prima grazie alla comprensione fisica del mondo. La dimostrazione mostra il robot che prende un’arancia e la mette in una lunch box, alza il coperchio del water, prepara una pizza in ambienti caotici con luci e rumori, stira camicie e svolge altre faccende domestiche. L’effetto “flywheel” è fondamentale: produce in tempo reale dati che vengono utilizzati per migliorare il suo apprendimento del mondo in autonomia, un vero circolo virtuoso self-learning.

Guarda il video completo →Scandalo Grok: l’IA di Musk fuori controllo genera oltre 20.000 deepfake sessuali

Grok, l’intelligenza artificiale di Elon Musk integrata su X, è finita al centro di una polemica globale per la creazione facilitata di deepfake non consensuali. Un report di Open Forensics ha rilevato oltre 20.000 immagini manipolate generate, la stragrande maggioranza con lo scopo di sessualizzare donne e persino minorenni. Gli usi impropri spaziavano dalla rimozione digitale dei vestiti all’uso come “tribunale estetico”. Unione Europea, Malaysia, Indonesia e California hanno reagito immediatamente: il governatore Gavin Newsom ha definito la piattaforma “terreno fertile per predatori”. X ha prima reso la funzione disponibile solo a pagamento (peggiorando la situazione), poi ha bloccato completamente la possibilità di modificare foto di persone reali e attivato il geoblocking nei paesi dove è illegale. Musk nega categoricamente la conoscenza di immagini di nudo di minorenni.

Guarda il video completo →Physical AI: l’intelligenza artificiale entra nel mondo reale con robot e sensori

Per anni abbiamo pensato all’intelligenza artificiale come qualcosa di confinato nei computer e negli smartphone. Oggi tutto sta cambiando: l’IA sta uscendo dallo schermo ed entrando nel mondo fisico. La Physical AI rappresenta il passaggio dai language model ai world model, sistemi capaci di comprendere e interagire con l’ambiente circostante attraverso robot, sensori, dispositivi indossabili e sistemi di visione artificiale. Questo nuovo paradigma promette di rivoluzionare manifattura, logistica, sanità, agricoltura e vita quotidiana, ma solleva interrogativi enormi sulla sicurezza, privacy e impatto sociale quando le macchine possono agire fisicamente nel nostro spazio.

Guarda il video completo →4 metodi per creare podcast con AI: da NotebookLM a voice cloning e baby podcast

La guida definitiva per creare podcast con intelligenza artificiale copre quattro metodi: NotebookLM (gratuito) genera automaticamente conversazioni tra due persone da qualsiasi fonte (PDF, siti web, YouTube), Google AI Studio converte script multi-speaker in audio singolo con voci naturali, ElevenLabs permette di clonare la propria voce per podcast personalizzati, e Jogg AI trasforma audio in video con avatar realistici o baby podcast. Il tutorial mostra anche come usare Chat GPT e Google Whisk per creare immagini personalizzate dei podcaster, Dubdub AI per avatar parlanti, e tecniche di video editing per risultati professionali. Tutti gli strumenti sono accessibili gratuitamente o con piani base economici.

Guarda il video completo →

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.