L’Ecosistema Google AI:

Le 3 Porte di Accesso

Dall’interfaccia consumer alla sperimentazione avanzata fino all’enterprise. Ecco come navigare l’universo creativo e produttivo di Google.

Introduzione: Mappa del Territorio

Non esiste un unico “Google AI”. Esistono tre porte principali per accedere alle capacità di intelligenza artificiale di Google, ciascuna progettata per un tipo di utente e un obiettivo specifico:

- Google Gemini: La porta principale per tutti. L’assistente conversazionale.

- Google AI Studio: La porta per creator e sviluppatori. Il “parco giochi” tecnico.

- Google Labs: La porta del futuro. Sperimentazione pura.

1. Google Gemini: L’Assistente Universale

Gemini (ex Bard) è l’interfaccia consumer. È dove la maggior parte delle persone interagisce con i modelli Google. È progettata per essere intuitiva, multimodale (capisce testo, immagini, audio) e integrata nell’ecosistema Google Workspace.

Punti di forza

Integrazione nativa con Google (Flights, Hotels, Maps, YouTube), capacità di ragionamento complesso (modello “Ultra”) e interfaccia pulita per la produttività quotidiana.

2. Google AI Studio: Il Laboratorio per Creator

Mentre Gemini è il “prodotto”, Google AI Studio è il “motore a nudo”. È un ambiente gratuito e web-based che permette di testare i modelli (come Gemini Pro e Flash) con un controllo granulare impossibile da ottenere nella chat normale.

Caratteristiche Tecniche Chiave

- Prompt Engineering Avanzato: Puoi definire “System Instructions” (istruzioni di sistema) per cambiare radicalmente il comportamento del modello.

- Temperatura e Parametri: Controlli slider per regolare la creatività (temperatura) e la lunghezza delle risposte.

- Safety Settings: Filtri granulari per bloccare o permettere contenuti sensibili.

- Progetti e Versioning: Puoi salvare i tuoi prompt come “prompt templates” e ottenere un codice API immediato.

Perché usarlo?

Se Gemini non risponde come vuoi, AI Studio è il luogo dove vai a “costruire” la risposta perfetta. È il ponte tra l’uso casuale e lo sviluppo software.

3. Google Labs: L’Arsenale Sperimentale

Google Labs è dove i nuovi strumenti vengono testati dal pubblico prima del rilascio ufficiale. È il cuore pulsante dell’innovazione visiva e creativa di Google.

Whisk è lo strumento di punta di Google Labs. Permette di creare immagini originali definendo l’oggetto, la scena e lo stile grafico separatamente.

Hai il controllo totale sulla tua creazione, costruendo una coerenza visiva perfetta con il tuo stile.

4. Utilizzo Enterprise: Google Workspace Studio

Automatizzare i processi non è un “più”, è l’unico modo per scalare. Google Workspace Studio è la soluzione nativa per utenti Business che promette di rendere l’automazione accessibile anche a chi non ha mai scritto codice.

5 vantaggi chiave di Workspace Studio rispetto a Zapier

- Sicurezza Nativa: Nessuna intermediazione esterna, zero rischi di fuga dati.

- Linguaggio Naturale: Grazie all’AI, potete “dettare” l’automazione.

- Costo Zero (o quasi): È già incluso nelle licenze Business/Enterprise.

- Centralizzazione: Gestite tutto da un’unica dashboard.

- Potenza di Gemini: Accesso diretto al modello linguistico di Google.

FAQ: Tutto quello che devi sapere

| Caratteristica | Google Workspace Studio | Zapier |

|---|---|---|

| Integrazione | Nativa (ambiente Google) | Multi-piattaforma |

| Sicurezza | Dati blindati in Google | Dati su server terzi |

| Costi | Incluso nell’abbonamento | Costi crescenti a consumo |

Google potenzia AI Studio con l’agente Antigravity

Nel nuovo aggiornamento di Google AI Studio novità rilevanti trasformano la piattaforma da semplice ambiente di test a strumento completo per sviluppare applicazioni pronte per la produzione.

Da prototipo a stack completo per applicazioni

Google ha annunciato un importante upgrade di AI Studio, introducendo una nuova esperienza di sviluppo basata sull’agente di coding Antigravity. L’obiettivo è trasformare semplici prompt in applicazioni complete, funzionanti e pronte per l’ambiente produttivo.

In origine AI Studio era pensato come interfaccia per sperimentare i modelli Gemini e creare prototipi di applicazioni AI. Con questo aggiornamento, però, la piattaforma evolve in un vero stack di sviluppo.

Gli sviluppatori possono ora costruire applicazioni con servizi di backend senza appoggiarsi a strumenti esterni.

Integrazione Firebase e servizi automatici

L’agente è in grado di rilevare quando un’applicazione richiede un database o un sistema di login e di predisporre automaticamente i servizi necessari tramite Firebase.

Cloud Firestore

Database NoSQL configurato automaticamente per archiviazione dati in tempo reale.

Firebase Auth

Sistema di autenticazione utenti gestito nativamente dalla piattaforma.

Librerie automatiche

Installazione automatica di librerie esterne, animazioni e componenti UI.

Supporto ai framework web moderni

La nuova esperienza di sviluppo supporta i principali framework:

Gestione sicura delle API e dei segreti

Google introduce un gestore di segreti integrato per supportare le integrazioni API in sicurezza.

Questo cambio indica una spinta verso applicazioni a livello produttivo, superando la logica del semplice demo.

Sessioni persistenti e app in tempo reale

La piattaforma consente di costruire applicazioni multiplayer in tempo reale. Casi d’uso:

- Editor condivisi per documentazione collaborativa

- Giochi online multiutente

- Strumenti di progetto con sincronizzazione in tempo reale

Sviluppo agentico

L’aggiornamento riflette la tendenza verso lo sviluppo software guidato da agenti.

La strategia di Google si inserisce in un panorama competitivo in cui strumenti puntano sempre più allo sviluppo autonomo o semi-autonomo di software, spesso descritto come agentic development.

Concorrenza e roadmap futura

Google ha dichiarato che la nuova esperienza di AI Studio è già stata utilizzata internamente per sviluppare centinaia di migliaia di applicazioni.

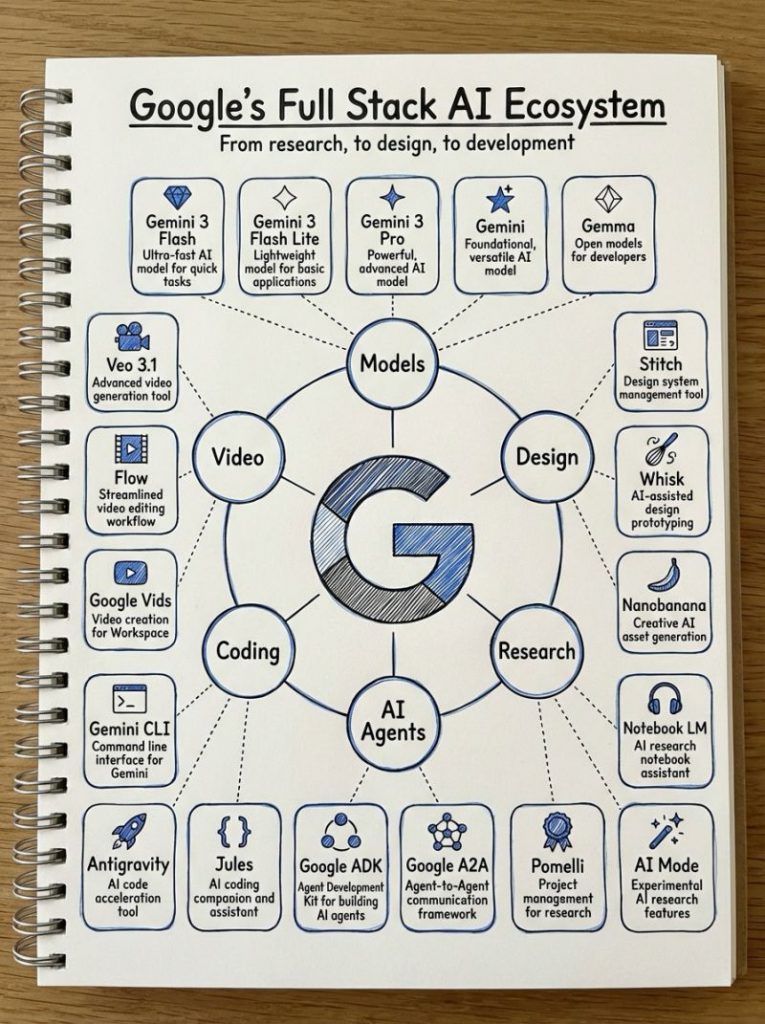

Google Full Stack AI

Un’analisi dettagliata dell’ecosistema integrato, dalla ricerca allo sviluppo.

🧠 Modelli (Core Engine)

Il cuore pulsante è la serie Gemini 3. Si articola in versioni Flash per la bassa latenza, Pro per ragionamenti complessi e Lite per efficienza su larga scala. Gemma completa l’offerta come modello open per chi necessita di personalizzazione on-premise.

🎬 Produzione Video

Google chiude il cerchio creativo: Veo 3.1 genera video ad alta fedeltà, Flow ottimizza i flussi di editing, mentre Google Vids integra la creazione video direttamente nei flussi di lavoro Workspace (Documenti/Slide).

🎨 Design & Asset

L’IA entra nel processo UI/UX: Stitch gestisce la coerenza dei sistemi di design, Whisk accelera la prototipazione rapida e Nanobanana automatizza la creazione di asset grafici unici pronti all’uso.

💻 Coding Acceleration

Per gli sviluppatori, Jules funge da compagno di programmazione avanzato, mentre Antigravity accelera l’esecuzione del codice. La Gemini CLI permette di invocare la potenza dei LLM direttamente dal terminale.

🔬 Research & Insight

Notebook LM trasforma i tuoi documenti in basi di conoscenza interrogabili. Pomelli gestisce i progetti di ricerca complessi e AI Mode sblocca funzionalità sperimentali per l’analisi dei dati di frontiera.

🤖 AI Agents & Orchestration

Il futuro è l’automazione autonoma: con Google ADK si costruiscono agenti intelligenti, mentre il framework A2A (Agent-to-Agent) permette a diverse IA di comunicare e collaborare tra loro per risolvere task multi-step.

Ultimo Upgrade

1. Gemini 3.1 Flash Live: L’AI che parla (e ascolta) come un umano

Immagina di parlare al telefono con un amico che non solo ti risponde all’istante, ma capisce anche se sei ironico, triste o di fretta dal tono della tua voce. Questo è Gemini 3.1 Flash Live.

- Cos’è: È il modello più veloce di Google, ottimizzato per la voce e il video in tempo reale.

- La differenza: Rispetto alle versioni precedenti, la latenza (il tempo di attesa tra la tua domanda e la sua risposta) è quasi zero. Può vedere ciò che inquadri con la fotocamera e commentarlo mentre accade.

- Esempio concreto: Sei davanti a un motore che non parte. Inquadri i cavi con il telefono e dici: “Gemini, guarda qui, quale devo collegare?”. Lui ti risponde a voce in un secondo: “Collega il cavo rosso al morsetto di sinistra, lo vedo un po’ allentato”.

2. Gemini Search Live: Google non ti dà più solo link, ma risposte “vive”

Dimentica la vecchia barra di ricerca dove scrivevi parole chiave. Search Live trasforma Google in un assistente che esplora il web per te in diretta.

- Cos’è: Un’evoluzione di Google Search integrata con Gemini che permette conversazioni multimodali (voce + immagini).

- La differenza: Invece di darti una lista di siti, Gemini naviga tra le ultime notizie e i dati aggiornati al secondo per comporre una risposta completa e parlata.

- Esempio concreto: “Gemini, cercami i biglietti per il concerto di domani a Roma, ma solo se non piove e se il posto ha accesso per disabili”. Gemini controlla il meteo live, i siti dei biglietti e le mappe del locale, confermandoti tutto a voce senza che tu debba aprire dieci schede diverse.

3. Sviluppo Software: Gemini diventa il tuo “CTO” personale

Questa è la rivoluzione più grande per chi crea siti e app. Gemini non scrive più solo il codice, ma fa il lavoro sporco di configurazione e pubblicazione.

A. Deploy su Vercel e Netlify

Prima dovevi configurare i file, collegare GitHub e gestire le impostazioni di deploy. Ora Gemini ha accesso diretto a queste piattaforme.

- Esempio: Hai finito di scrivere una pagina web? Dici a Gemini: “Pubblicala su Vercel”. Lui crea il progetto, configura il dominio e ti dà il link del sito funzionante in pochi secondi.

B. Accesso al Database (Firebase)

Gemini ora interagisce direttamente con Firebase (il database di Google). Può creare collezioni di dati, gestire gli utenti e scrivere le regole di sicurezza.

- Esempio: “Crea una tabella utenti su Firebase che salvi nome ed email”. Gemini entra nella tua console Firebase, configura il database e ti scrive il codice per collegarlo alla tua app.

C. Sviluppo del Backend

Gemini non si limita più alla parte “estetica” (frontend). Ora gestisce la logica complessa del server (backend).

- Esempio: “Crea un sistema che invii un’email automatica ogni volta che un cliente compra un prodotto sul mio sito”. Gemini scrive il codice del server, configura il servizio di invio email e lo collega al carrello.

In sintesi: Cosa cambia per te?

Se prima Gemini era un bravo assistente che ti dava suggerimenti, oggi è un operatore attivo. Se sei un programmatore, ti toglie ore di noiosa configurazione; se sei un utente comune, ti permette di interagire con la tecnologia usando solo la voce e gli occhi, come se avessi un assistente personale sempre al tuo fianco.

Google Antigravity è un ide come visual studio

Google Antigravity è un IDE cloud-based sviluppato da Google, lanciato a novembre 2025. A differenza di Visual Studio Code, che è un editor di testo estremamente potente ma costruito come piattaforma modulare a cui si aggiungono estensioni, Antigravity è stato costruito con l’intelligenza artificiale come architettura fondamentale. Google definisce Antigravity come un “AI-Powered IDE”, il che implica un approccio innovativo e integrato all’intelligenza artificiale nell’IDE.

I tre pilastri della creazione Google

Possiamo immaginare questi tre strumenti come tre fasi o modi diversi di “costruire” un’applicazione, ognuno con una specializzazione diversa.

1. Google Stitch (Il “Creatore Istantaneo”)

È la novità più recente e performante.

- Cosa fa: Si concentra sulla velocità e sull’interfaccia visiva.

- Come funziona: Tu parli (“Voglio una pagina login moderna”) e lui genera istantaneamente l’immagine dell’interfaccia e il codice (UCG). È pensato per sbloccare la creatività: l’interazione vocale ti permette di iterare velocemente, provare varianti e vedere subito il risultato.

- Il suo ruolo nel flusso: È il punto di partenza. Trasforma un’idea vaga in qualcosa di concreto (codice React o bozza) in pochi secondi.

2. Google Antigravity (L’Ambiente “Senza Vincoli”)

Qui sta la differenza fondamentale. Se Stitch è il “disegnatore veloce”, Antigravity (nell’accezione degli esperimenti Labs) rappresenta uno spazio di creazione generativa e fluida.

- Cosa fa: È un ambiente dove l’AI non si limita a disegnare quello che dici, ma può generare intere esperienze applicative sperimentali. È spesso definito “Antigravity” proprio perché mira a togliere i vincoli tradizionali del coding o del design standard.

- Differenza con Stitch: Mentre Stitch è ottimizzato per produrre codice pulito e standard (React) da riutilizzare subito, Antigravity è più un “parco giochi” generativo dove l’applicazione prende vita in modo più autonomo o sperimentale, perfetto per testare concetti nuovi che non seguono i schemi classici.

3. Google AI Studio – Sezione BUILD (Il “Motore” o il Laboratorio)

Questo è il terreno degli sviluppatori puri.

- Cosa fa: Qui si gestisce la logica complessa.

- Come funziona: Prendi il codice generato da Stitch o l’idea sperimentata in Antigravity e la porti qui. In BUILD, non ti occupi più solo dell’aspetto, ma colleghi l’applicazione ai dati, ai server, e definisci come l’intelligenza artificiale deve “pensare” e rispondere.

Come funzionano insieme (Il flusso lavorativo)

Grazie all’integrazione di cui parlavi, il processo oggi è diventato lineare e potentissimo:

- Fase Creativa (Stitch): Parli con Stitch. Lui crea l’interfaccia grafica (UCG) istantaneamente. La modifichi finché non ti piace visivamente.

- Esportazione: A questo punto hai due scelte:

- Scelta A: Esporti direttamente il codice React per usarlo nel tuo software.

- Scelta B: Esporti il progetto in Google AI Studio (BUILD).

- Fase Logica (Build): Una volta passato in AI Studio, quel disegno diventa “vivo”. Aggiungi le regole business (es. “se l’utente clicca qui, salva i dati”).

Riassumendo la differenza principale

- Stitch = Forma. Crea l’aspetto e l’esperienza utente velocemente (specialmente da voce).

- Antigravity = Esplorazione. Genera esperienze applicative sperimentali e creative.

- AI Studio Build = Sostanza. Rende l’applicazione funzionante, intelligente e connessa al mondo reale.

La vera forza sta nel fatto che non sono più strumenti isolati: Stitch può “passare la palla” ad AI Studio, permettendoti di saltare tutta la parte noiosa della scrittura del codice grafico e concentrarti solo sulla logica.

La categoria dei “Computer Use Tools” (Umani Artificiali)

Quando parliamo di strumenti come Claude Code, Claude Cowork, Copilot Cowork e appunto Google Antigravity, non stiamo più parlando di semplici chat che rispondono a domande. Stiamo parlando di Agenti.

Immagina la differenza tra un architetto che ti disegna il progetto su un foglio (AI Classica) e un muratore che prende in mano i mattoni e costruisce il muro da solo (Computer Use Tool).

Google Antigravity: L’Agente Autonomo

In questo scenario, Google Antigravity si posiziona come il “braccio operativo” del sistema. Ecco cosa significa essere un “Computer Use Tool”:

1. Agisce autonomamente sul tuo computer (o cloud) A differenza di Stitch che si limita a generare codice che tu devi copiare e incollare, Antigravity ha le “mani”.

- Se gli chiedi di creare un’applicazione, lui non solo scrive il codice, ma crea fisicamente le cartelle sul disco.

- Può nominare i file, organizzarli in sottocartelle (es.

/src/components), e salvare tutto automaticamente senza che tu tocchi la tastiera.

2. Gestione File e Cartelle Questa è la funzione rivoluzionaria. Antigravity può navigare il file system:

- Può leggere file esistenti per capire il contesto.

- Può spostare, rinominare o cancellare file inutili.

- Può installare le librerie necessarie per far funzionare il software. In pratica, fa il lavoro noioso che di solito fa lo sviluppatore (setup dell’ambiente, gestione cartelle, configurazione).

Il nuovo confronto: Stitch vs Antigravity vs AI Studio

Ora il quadro è completo e possiamo vedere chi fa cosa nel “team” di Google:

- Google Stitch (Il Designer Veloce):

- Ruolo: È specializzato nella velocità visiva.

- Azione: Tu parli, lui disegna l’interfaccia (UI) e ti dà il codice “grezzo” (React). È perfetto per l’ideazione e la creatività istantanea.

- Limite: Ti dà i pezzi (il codice), ma non li assembla nella struttura finale del progetto.

- Google Antigravity (Il Costruttore Autonomo):

- Ruolo: È specializzato nell’esecuzione materiale.

- Azione: Prende l’idea (o il codice di Stitch) e la trasforma in un progetto funzionante. Crea le cartelle, gestisce i file, corregge gli errori di compilazione in autonomia. È simile a Claude Code: ragiona come un programmatore umano che ha accesso al terminale.

- Forza: Può lavorare da solo su compiti complessi (es. “Rifattorizza questa cartella e ottimizza il codice”).

- Google AI Studio – BUILD (Il Direttore Tecnico):

- Ruolo: È il luogo della logica e della strategia.

- Azione: È qui che definisci “il cervello” dell’applicazione. È l’ambiente professionale dove monitori cosa fanno gli agenti (Antigravity) e dove configuri i modelli AI affinché funzionino al meglio.

Esempio pratico del flusso integrato

Immagina di voler creare un’applicazione per gestire una lista della spesa.

- Fase 1 (Stitch): Parli a Stitch: “Voglio un’app elegante per la spesa con sfondo scuro”. Stitch genera in 10 secondi l’interfaccia grafica e il codice React del componente visivo.

- Fase 2 (Antigravity): Prendi quel codice e lo passi ad Antigravity (o gli dai l’istruzione vocale). Antigravity, essendo un Computer Use Tool:

- Crea una nuova cartella

progetto-spesa. - Genera i file

App.js,index.html,package.json. - Inserisce il codice di Stitch nel file giusto.

- Esegue i comandi per installare le dipendenze.

- Se c’è un errore, lo legge e lo corregge da solo.

- Crea una nuova cartella

- Fase 3 (AI Studio Build): Se l’app deve collegarsi a un database intelligente, entri in AI Studio per configurare le API e la logica dei dati, dando “l’intelligenza” al progetto che Antigravity ha costruito.

In sintesi: Mentre Stitch ti fa vedere l’idea e AI Studio Build la fa pensare, Antigravity è quello che si sporca le mani: scrive i file, crea le cartelle e compie azioni reali sul computer, rendendo lo sviluppo molto più simile a una conversazione con un collega umano che lavora per te.

Gemma 4: Google rilascia il nuovo standard dell’AI Open Source

L’evoluzione dei modelli aperti punta a sfidare i giganti proprietari con efficienza e potenza senza precedenti.

Google ha presentato ufficialmente Gemma 4, l’ultima iterazione della sua famiglia di modelli di intelligenza artificiale open source. Basato sulle stesse innovazioni tecnologiche di Gemini, Gemma 4 si posiziona come il modello aperto più potente mai rilasciato da Mountain View, offrendo prestazioni eccezionali pur mantenendo un’architettura leggera.

Perché è una svolta?

- Accessibilità: Disponibile gratuitamente per sviluppatori e ricercatori.

- Efficienza: Ottimizzato per girare localmente su hardware consumer e dispositivi edge.

- Performance: Supera i benchmark di categoria, avvicinandosi ai modelli closed-source più blasonati.

Democratizzare l’AI

Con questo rilascio, Google non solo fornisce pesi del modello “aperti”, ma anche un ecosistema di strumenti per il fine-tuning e l’integrazione responsabile. L’obiettivo è chiaro: permettere a chiunque di costruire applicazioni avanzate senza dipendere esclusivamente da API a pagamento.

Risorse Video

Esplora i workflow e le innovazioni dell’intelligenza artificiale.

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.