Introduzione: Il Cambio di Paradigma verso l’Era Agentica

Non ci limitiamo più a interrogare un modello; oggi agiamo come Architetti di Sistemi Cognitive, dove l’IA rappresenta una forza lavoro autonoma capace di interagire con il mondo reale. Questa guida analizza l’evoluzione strutturale dei processi produttivi e gli strumenti che rendono possibile la trasformazione da esecutori di task a supervisori di agenti.

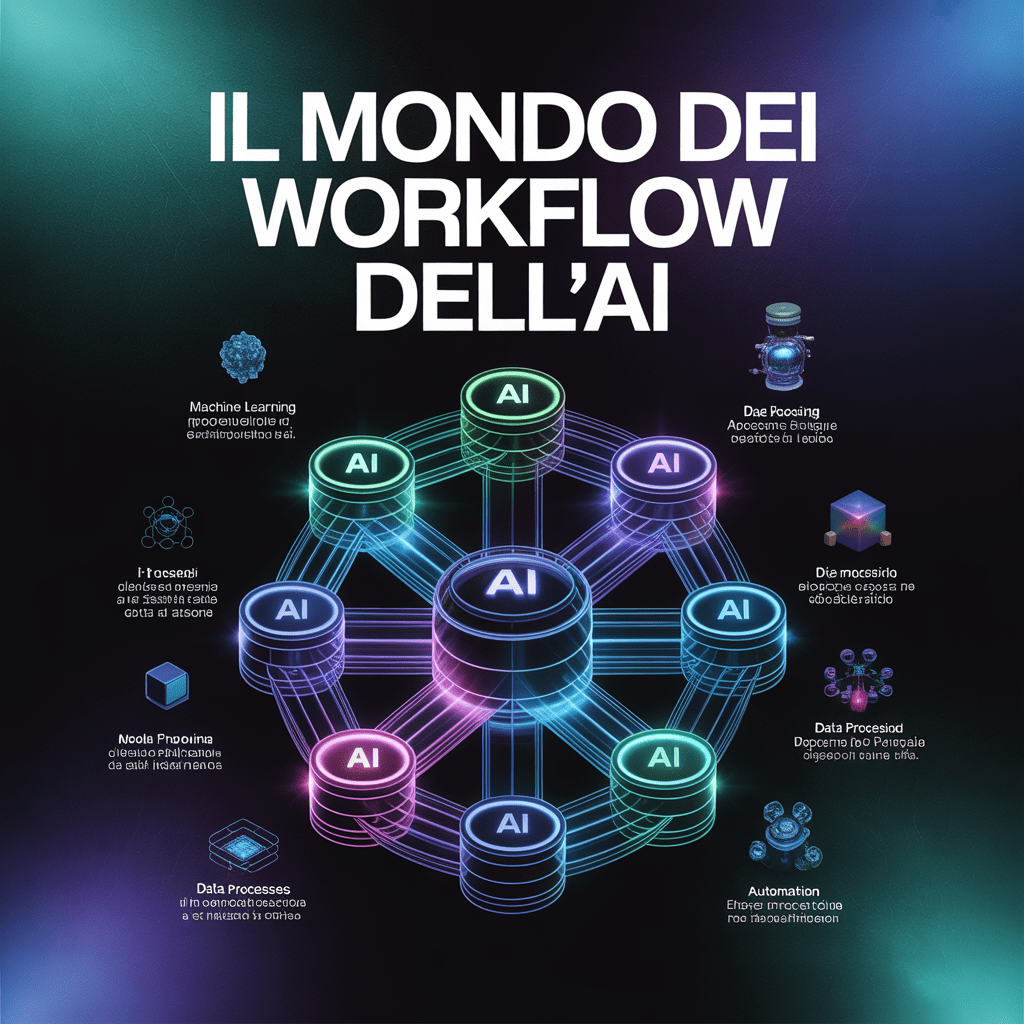

1. L’Evoluzione dell’Autonomia AI: Multi-Tool vs. Agentic Workflow

La comprensione del panorama moderno richiede una distinzione netta tra i flussi guidati dall’uomo e quelli orchestrati dall’IA.

Workflow Multi-Tool (Sincroni e Sequenziali)

In questo modello, l’utente umano è il “ponte cognitivo”. È un processo lineare e manuale:

- Ruolo Umano: Direttore d’orchestra manuale. L’utente deve gestire l’input e l’output tra diverse piattaforme (il cosiddetto “Copy-Paste Workflow”).

- Esecuzione: Sincrona. È necessario attendere il completamento dello Strumento A per alimentare manualmente lo Strumento B.

- Limitazioni: Ogni cambio di piattaforma comporta una perdita di contesto o un consumo eccessivo di token per ri-alimentare il modello con i dati pregressi.

- Esempio Tipico: Effettuare una ricerca su Perplexity, sintetizzare i risultati in NotebookLM e infine usare Claude per redigere un white paper.

Workflow Agentici (Asincroni e Paralleli)

Qui l’IA evolve in un agente autonomo dotato di “mani” (terminali, browser, API).

- Ruolo Umano: Architetto e Supervisore. Si definisce l’obiettivo di alto livello (es. “Sviluppa una dashboard per il monitoraggio dei lead”) e si approvano i piani d’azione.

- Esecuzione: Asincrona e Parallela. Gli agenti lavorano in background, utilizzano strumenti reali (Tool Use) e possono collaborare in team specializzati.

- Capacità Operative: Gli agenti possono navigare sul web per risolvere ambiguità, installare dipendenze software, correggere bug in autonomia e validare il proprio output attraverso cicli di test automatici.

Tabella Comparativa: Evoluzione dell’Autonomia

| Caratteristica | Workflow Multi-Tool | Workflow Agentici |

|---|---|---|

| Interfaccia Primaria | Chat UI (Isolata) | Mission Control / Terminale / IDE |

| Ponte di Connessione | Umano (Manuale) | Protocolli Universali (MCP / API) |

| Natura del Processo | Sequenziale e Lineare | Parallelo, Ciclico e Iterativo |

| Interazione con l’OS | Limitata al Browser | Accesso a File, Terminale e Sandbox |

| Gestione della Memoria | Effimera (Sessione) | Persistente (RAG / NotebookLM) |

| Focus dell’Utente | Micro-management del prompt | Definizione della strategia e dei vincoli |

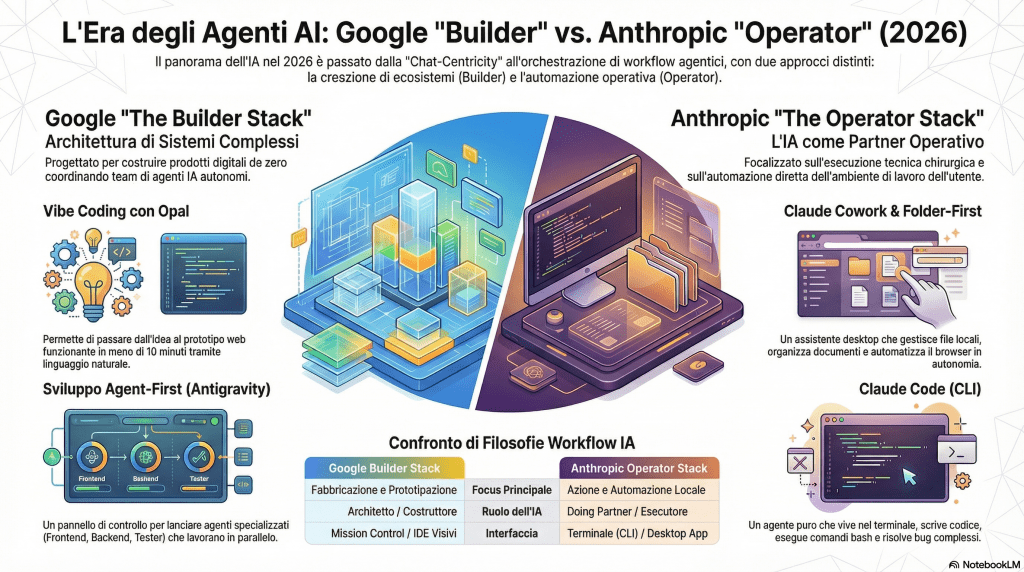

2. L’Ecosistema Google: “The Builder Stack”

Google ha strutturato una suite progettata per chi “costruisce” prodotti digitali, integrando ricerca, design e sviluppo.

2.1 NotebookLM: Il Secondo Cervello Strategico

Non è più un semplice assistente di lettura, ma una piattaforma di Deep Research basata su RAG (Retrieval-Augmented Generation).

- Deep Research: Gli agenti di NotebookLM possono analizzare centinaia di fonti web in pochi minuti, producendo report “grounded” (ancorati ai fatti) e privi di allucinazioni grazie alle citazioni dirette.

- NotebookLM Studio: La capacità di trasformare dati statici in asset multimediali dinamici:

- Audio Overviews: Podcast iper-realistici per il consumo passivo della conoscenza.

- Video Cinematici: Creazione automatica di explainer video con narrazione e visual coerenti basati sui dati del taccuino.

- Slide Deck: Generazione di presentazioni professionali (.pptx) guidate da stili visivi analizzati da Gemini.

2.2 Gemini: Il Motore di Ragionamento e le Gems

Il modello Gemini 3.1 Pro funge da centro logico del Builder Stack.

- Canvas: Un ambiente di lavoro persistente che affianca la chat, ideale per la scrittura iterativa e il coding dove l’IA può modificare sezioni specifiche del file senza rigenerare tutto.

- Gemini Gems: Consulenti IA personalizzati. Le Gems permettono di cristallizzare logiche aziendali o framework di settore (es. “Agisci da Senior DevOps per Google Cloud”) alimentandoli con dataset esclusivi provenienti da Drive o NotebookLM.

2.3 Google Opal: La Rivoluzione del “Vibe Coding”

Opal democratizza lo sviluppo software attraverso il linguaggio naturale.

- Approccio Visivo a Nodi: Permette di mappare i flussi (Input -> Generate -> Output) senza scrivere una riga di codice.

- Esecuzione Multimodale: Opal può attivare simultaneamente Gemini per la logica, Imagen per gli asset grafici e modelli audio per l’interazione vocale.

- Mini-App Istantanee: Consente di passare dall’idea al prototipo funzionante e condivisibile in meno di 10 minuti, spostando il focus dalla sintassi del codice alla “vibrazione” del design (Vibe Coding).

2.4 Google Antigravity: L’IDE Agent-First

Antigravity rappresenta il futuro degli ambienti di sviluppo.

- Agent Manager: Un pannello di controllo dove è possibile lanciare agenti specializzati (Frontend, Backend, Tester) che lavorano in parallelo sulla stessa codebase.

- Spec-Driven Development (SDD): Lo sviluppo è guidato da file di specifica (es.

SPEC.md). Gli agenti leggono i requisiti, pianificano l’architettura e scrivono i file, mentre l’utente supervisiona gli “Artifacts” (screenshot dei test, log del terminale). - Slash Commands: Comandi come

/plan,/createo/debugattivano workflow pre-configurati che automatizzano le parti ripetitive dello sviluppo.

2.5 Integrazioni Visive: Stitch e Nano Banana 2

- Google Stitch: Il ponte Design-to-Code. Un canvas IA dove il design visivo viene tradotto, tramite MCP, in codice React/Tailwind pronto per la produzione. Riduce il tempo di hand-off tra designer e dev dell’85%.

- Nano Banana 2: Modello specializzato (Gemini 3.1 Flash Image) per la generazione fulminea di asset grafici, diagrammi tecnici e infografiche isometriche ad alta risoluzione con rendering testuale perfetto.

3. L’Ecosistema Anthropic: “The Operator Stack”

Anthropic punta sulla precisione tecnica, sulla sicurezza e sulla manipolazione diretta dell’ambiente di lavoro dell’utente.

3.1 Claude Cowork

Questa applicazione desktop trasforma Claude in un vero assistente operativo. Grazie al framework “Folder-First”, Claude può vedere la struttura delle cartelle locali e organizzare file, pulire documenti o automatizzare azioni nel browser (Claude for Chrome) con autorizzazione granulare dell’utente.

3.2 Claude Code (CLI)

Un agente puro per sviluppatori che vive nel terminale. Claude Code non si limita a suggerire codice; lo scrive, esegue comandi bash, gestisce commit Git e risolve bug complessi analizzando l’intera cartella di progetto, superando i limiti della finestra di contesto standard.

3.3 Claude Artifacts: Generative UI

Gli Artifacts consentono di visualizzare in tempo reale il codice generato (React, HTML, SVG). Questo abilita la creazione di interfacce utente generative: l’utente descrive un’esigenza e Claude renderizza istantaneamente un simulatore, una dashboard o un’app interattiva nel pannello laterale.

4. L’Ecosistema Perplexity: “The Research Stack”

Perplexity agisce come lo Scout dei workflow complessi, fornendo l’accesso ai dati più recenti del web.

- Deep Research: Modalità che esegue decine di ricerche in parallelo, filtrando il rumore e convalidando le fonti.

- Spaces & Pages: Permette di organizzare la ricerca in ambienti collaborativi e di trasformare istantaneamente una ricerca profonda in una pagina strutturata e pubblicabile (CMS-ready).

- Ruolo di Alimentazione: In un workflow professionale, Perplexity fornisce la materia prima (dati verificati) che viene poi lavorata dai modelli di ragionamento (Gemini/Claude) per la produzione finale.

5. Infrastruttura, Memoria e Skill

L’architettura moderna si basa sull’interoperabilità e sull’efficienza cognitiva.

5.1 Model Context Protocol (MCP): Il Ponte Universale

L’MCP è la “porta USB-C” dell’IA. È uno standard aperto che permette a qualsiasi agente (indipendentemente dal produttore) di connettersi a strumenti esterni:

- Database: Accesso a schemi e dati SQL/NoSQL senza allucinazioni.

- Tool Enterprise: Integrazione con Slack, GitHub, Google Maps e sistemi CRM proprietari.

- Interoperabilità: Consente di usare le capacità di ricerca di Perplexity all’interno di Antigravity tramite un server MCP dedicato.

5.2 Gestione della Memoria e la “Wrap-up Skill”

La Saturazione del Contesto è il limite principale dei vecchi workflow (costi elevati e degrado delle prestazioni).

- Strategia di Archiviazione: Collegando gli agenti operativi (Claude Code o Antigravity) a NotebookLM tramite MCP, si crea una memoria infinita a costo quasi zero.

- Wrap-up Skill: Al termine di ogni sessione, l’utente lancia il comando

/wrap-up. L’agente sintetizza le decisioni prese, aggiorna il piano di progetto e carica tutto in un taccuino NotebookLM. Nella sessione successiva, l’agente richiamerà solo le informazioni pertinenti tramite RAG, risparmiando migliaia di token.

5.3 Agent Skills: Lo Standard SKILL.md

Le Agent Skills sono pacchetti di istruzioni e script salvati in file Markdown.

- Universalità: Una skill scritta in formato

SKILL.mdpuò essere letta da Claude Code, Cursor o Antigravity. - Verticalizzazione: Trasformano un modello generalista in un esperto di dominio (es. un “SEO Auditor” o un “Security Analyst”) fornendo framework di esecuzione rigorosi e strumenti specifici.

6. Esempi Pratici di Workflow Avanzati (Casi d’Uso 2026)

Ecco come i professionisti orchestrano oggi questi strumenti per massimizzare la produttività.

Workflow A: “Invisible Developer Stack” (Ideazione -> Deploy)

- Titolo: Sviluppo di App Full-Stack Senza Codice.

- Descrizione: L’utente carica le specifiche grezze e i requisiti in NotebookLM, che agisce da “Architetto” creando un blueprint tecnico (

SPEC.md). Questo file viene passato a Google Antigravity, dove l’agente manager avvia un team di specialisti. Il Frontend Engineer recupera il design visivo da Google Stitch tramite MCP, mentre il Backend Engineer scrive le API interpellando un database aziendale (sempre via MCP). Al termine, il comando/testvalida l’app e Antigravity esegue il deploy su Cloud Run.

Workflow B: “The Global Content Factory” (Ricerca -> Asset)

- Titolo: Creazione di Documentazione Multimediale Grounded.

- Descrizione: Inizia con una sessione di Deep Research su Perplexity per raccogliere dati aggiornati sul mercato. I risultati vengono importati in un taccuino NotebookLM che funge da fonte di verità. Tramite NotebookLM Studio, l’utente genera simultaneamente un’Audio Overview (podcast esplicativo) per il team e un Video Cinematico per i canali social. Infine, Nano Banana 2 viene attivato per creare infografiche isometriche ad alta risoluzione che illustrano i dati chiave, garantendo coerenza visiva totale.

Workflow C: “The Cognitive Memory Loop” (Gestione Progetti complessi)

- Titolo: Prevenzione della Saturazione del Contesto per Grandi Codebase.

- Descrizione: Un ingegnere lavora per ore su un progetto legacy utilizzando Claude Code. Per evitare che il modello inizi a “dimenticare” i dettagli a causa della finestra di contesto piena, l’utente invoca la Wrap-up Skill. L’agente analizza l’intera sessione, estrae le decisioni architetturali chiave e le carica in un taccuino “Project Brain” su NotebookLM. Nella sessione successiva, l’agente recupera solo le parti necessarie tramite una ricerca semantica MCP, mantenendo i costi dei token bassissimi e la precisione al 100%.

Workflow D: “Vibe Coding Sprint” (Prototipazione Rapida)

- Titolo: Dalla Descrizione Naturale alla Mini-App Condivisibile.

- Descrizione: Un marketer ha bisogno di un calcolatore di ROI personalizzato per un cliente. Descrive il funzionamento in linguaggio naturale all’interno di Google Opal. Opal genera un workflow visivo a nodi che concatena l’input dell’utente con un modello di ragionamento Gemini e un output grafico curato. Senza scrivere codice, il marketer clicca su “Publish” e ottiene un link di una mini-app web funzionante, ospitata su infrastruttura Google, pronta per essere inviata al cliente.

Workflow E: “Strategic Sales Outreach” (Automazione B2B)

- Titolo: Prospezione Personalizzata basata su Dati Reali.

- Descrizione: Viene attivata una Agent Skill dedicata chiamata

Sales_Scout.md. L’agente (Claude o Gemini) esegue una ricerca profonda sull’azienda target tramite Perplexity MCP per identificare “pain points” recenti. Successivamente, consulta il manuale prodotto dell’utente caricato in NotebookLM. Incrociando queste due fonti, l’agente genera una sequenza di email iper-personalizzate e script per LinkedIn, salvando ogni interazione nella cartella locale tramite Claude Cowork.

Workflow F: “The Digital Educator” (Istruzione Interattiva)

- Titolo: Creazione di Corsi Online Interattivi da Video Lezioni.

- Descrizione: L’utente incolla il link di una lunga lezione YouTube in NotebookLM. L’IA estrae i concetti chiave e genera una guida all’apprendimento e un set di flashcard. Successivamente, il contesto viene passato a Claude Artifacts, che costruisce un simulatore interattivo (es. un laboratorio di fisica virtuale) per permettere agli studenti di testare i concetti descritti nel video. Infine, viene generato un test finale in NotebookLM che si auto-rigenera focalizzandosi sulle lacune mostrate dallo studente.

Workflow G: “UI/UX Blitz” (Design Vibe-Based)

- Titolo: Dal Comando Vocale al Prototipo Pixel-Perfect.

- Descrizione: Un designer utilizza Google Stitch via comando vocale (“Crea una dashboard finanziaria in stile Neomorfico, toni blu scuro”). Stitch genera l’interfaccia. L’utente esporta i design token tramite MCP in Google Antigravity. Qui, l’agente

Frontend_Specialist.tsconverte il design in componenti React animati con Framer Motion. Il designer esegue il “Vibe Check” nel browser integrato di Antigravity, chiedendo modifiche estetiche in tempo reale che l’IA implementa istantaneamente sui file sorgente.

Workflow H: “The Automated Recruiter” (HR e Recruiting)

- Titolo: Valutazione Imparziale dei Candidati su Larga Scala.

- Descrizione: Centinaia di CV vengono caricati in un taccuino NotebookLM. Utilizzando una Gemini Gem chiamata “HR Strategist”, l’utente definisce una matrice di valutazione rigorosa. Il sistema incrocia i dati dei CV con i requisiti del lavoro, generando un report comparativo citato. Per i candidati migliori, l’agente attiva un workflow su Claude Artifacts per generare una dashboard di assessment personalizzata che mostra graficamente il “fit” culturale e tecnico di ogni profilo.

Workflow I: “Data-to-Insight Engine” (Business Intelligence)

- Titolo: Dashboard di Analisi Enterprise in Tempo Reale.

- Descrizione: Tramite un server MCP, Gemini 3.1 Pro viene connesso direttamente a un database BigQuery. L’utente richiede un’analisi dei trend di vendita dell’ultimo trimestre. L’agente scrive ed esegue le query SQL, analizza i risultati e passa i dati a Claude Artifacts, che renderizza una dashboard interattiva con grafici dinamici. In caso di anomalie, l’agente avvia autonomamente una ricerca su Perplexity per trovare cause esterne (es. notizie di mercato) e aggiorna la dashboard con una sezione di spiegazione contestuale.

Workflow J: “The Graphic Novelist” (Creatività Editoriale)

- Titolo: Trasformazione di uno Script in Fumetto Digitale.

- Descrizione: L’utente scrive una sceneggiatura in Google Docs e la carica in NotebookLM. Utilizzando la funzione “Slide Deck” con il “Power Prompt” (Racconta la storia come una graphic novel), NotebookLM genera una serie di pannelli illustrati. Se un personaggio non è coerente, l’utente aggiorna la descrizione fisica nel file Doc master. Per le rifiniture grafiche e il lettering professionale, gli asset vengono passati a Nano Banana 2 per generare versioni ad alta risoluzione in stili specifici (es. acquerello o manga), pronte per l’impaginazione finale in Canva.

Conclusioni: L’Architetto del Futuro

Il successo professionale nel 2026 non dipende dalla conoscenza di un singolo tool, ma dalla capacità di orchestrare l’intero stack. L’AI Architect moderno sa quando usare Perplexity per lo scouting, NotebookLM per la sintesi strategica, Stitch per il design e Antigravity o Claude Code per l’esecuzione tecnica, armonizzando ogni passaggio attraverso il protocollo MCP e il sistema delle Agent Skills.

Documento redatto per fini di analisi architetturale e consulenza tecnica senior.

L’Era Agentica

Dalla sinergia Multi-Tool all’orchestrazione degli Agenti Autonomi. Una guida visiva per architetti di sistemi cognitivi nel 2026.

1. L’Evoluzione dell’Autonomia AI

Il panorama moderno richiede una distinzione netta tra i flussi guidati dall’uomo (Multi-Tool) e quelli orchestrati dall’IA (Agentici). Siamo passati da un processo lineare e sincrono, in cui l’utente funge da ponte tramite il copia-incolla, a un ecosistema asincrono e parallelo dove gli agenti hanno accesso a terminali, file system e browser.

▶ Multi-Tool (Sequenziale)

L’utente è il “ponte cognitivo”. Interfaccia chat isolata, memoria effimera e micro-management continuo del prompt.

⚡ Agentic Workflow (Parallelo)

L’utente è supervisore. Connessione tramite protocolli (MCP), accesso a OS/Sandbox, memoria persistente e focus sulla strategia ad alto livello.

Confronto prestazionale sulle dimensioni dell’autonomia operativa.

2. Gli Ecosistemi Dominanti

Il 2026 vede la frammentazione specializzata degli stack tecnologici. Google domina la fase di “Build” con un ecosistema generativo completo, Anthropic si concentra sull'”Operation” tecnica sicura e Perplexity agisce come motore di “Research” ancorato alla realtà.

Google Builder Stack

- NotebookLM: Secondo cervello e RAG.

- Gemini 3.1 Pro: Motore logico & Canvas.

- Opal: Vibe Coding visivo.

- Antigravity: IDE Agent-First.

- Stitch / Nano Banana 2: Design e Asset.

Anthropic Operator Stack

- Claude Cowork: Automazione desktop Folder-First.

- Claude Code: Sviluppatore CLI autonomo.

- Claude Artifacts: UI generative on-demand.

Perplexity Research Stack

- Scout Engine: Alimentazione processi LLM.

- Spaces: Ambienti collaborativi di ricerca.

- Pages: Documentazione formale CMS-ready.

Composizione Funzionale del Google Builder Stack

Distribuzione del focus operativo all’interno dell’ecosistema Google.

3. Infrastruttura, Memoria e MCP

Il Model Context Protocol (MCP) è la “porta USB-C” dell’IA, collegando agenti a database e strumenti. Abbinato alle Agent Skills e alla Wrap-up Skill, risolve il problema critico della saturazione del contesto e dei costi dei token, abilitando una memoria infinita a costo quasi nullo.

Impatto della Wrap-up Skill sul Consumo di Token

Confronto tra accumulo lineare di contesto vs recupero semantico mirato via NotebookLM RAG.

📝 Lo Standard SKILL.md

Le Agent Skills trasformano LLM generalisti in specialisti di dominio. Un file SKILL.md contiene framework esecutivi universali letti da Claude Code, Antigravity o Cursor in modo intercambiabile, rendendo il know-how portabile.

4. Analisi Multidimensionale dei Tool

Mappatura avanzata degli strumenti basata sui livelli di autonomia, complessità operativa gestita e focus sulla generazione visiva.

Spazio 3D rendered in WebGL: Posizionamento degli applicativi AI 2026.

Workflow Operativi Avanzati

L’interoperabilità permette la creazione di “fabbriche digitali”. Ecco come l’AI Architect orchestra questi ecosistemi.

Invisible Developer Stack

Sviluppo App Full-Stack Senza Codice.

Global Content Factory

Creazione Documentazione Multimediale.

Cognitive Memory Loop

Gestione Progetti Complessi & Token.

Vibe Coding Sprint

Prototipazione Rapida No-Code.

Data-to-Insight Engine

Business Intelligence Real-Time.

The Graphic Novelist

Editoria Creativa Digitale.

La natura del Google Builder Stack è fortemente orientata alla creazione e all’orchestrazione di interi prodotti software e asset digitali da zero. In questo ecosistema, tu assumi il ruolo di “architetto”, mentre l’intelligenza artificiale agisce da “costruttore” o sviluppatore autonomo.

Il Builder Stack di Google è progettato per abbattere la barriera tecnica della programmazione e integra strumenti come:

- Google Antigravity: Un ambiente di sviluppo (IDE) “agent-first” dove non scrivi codice a mano, ma gestisci un team di agenti IA che in modo asincrono pianificano, programmano, testano e mettono online applicazioni complesse.

- Google Opal: Una piattaforma focalizzata sul “vibe coding”, che ti permette di descrivere a parole una logica di business e vederla tradotta istantaneamente in una mini-app web funzionante tramite flussi di lavoro visivi a nodi.

- Integrazioni visive e di contesto: Strumenti come Google Stitch (che traduce un prompt testuale in design UI e lo passa ad Antigravity per scriverne il codice) e Nano Banana 2 (per asset grafici), supportati dalla base di conoscenza profonda di NotebookLM, che funge da fondamento cognitivo ancorato ai tuoi dati reali.

Al contrario, la natura del Claude Operator Stack di Anthropic è concepita per l’operatività diretta, l’automazione del tuo ambiente di lavoro e l’esecuzione tecnica chirurgica. L’IA qui non è pensata per costruire ecosistemi da zero, ma agisce come un “doing partner” (un collega operativo) in grado di lavorare sui file esistenti, nel terminale o nella chat.

Il Claude Operator Stack eccelle nel lavoro iterativo e nell’azione sui sistemi locali tramite:

- Claude Cowork: Un’applicazione desktop autonoma che, utilizzando un framework “Folder-First”, ottiene l’accesso alle tue cartelle locali. Invece di suggerirti come organizzare il lavoro, legge, sposta, rinomina file, compila report e gestisce automazioni nel browser Chrome in completa autonomia.

- Claude Code: Uno strumento tecnico che vive nella riga di comando (CLI). È progettato per gli sviluppatori per leggere intere basi di codice preesistenti, eseguire comandi di sistema, fare debugging e applicare rigorose “Agent Skills” direttamente nel terminale.

- Claude Artifacts: Un sistema di interfacce generative (Generative UI) che prende il codice creato dalla chat (come script React, HTML o simulazioni) e lo renderizza istantaneamente in un pannello laterale dal vivo, permettendoti di manipolare e iterare sui risultati in tempo reale.

In sintesi: il Google Builder Stack è l’ideale se vuoi fabbricare software e applicazioni complesse gestendo team di agenti IA per la realizzazione di progetti da zero. Il Claude Operator Stack è invece insuperabile se cerchi un partner IA per gestire in autonomia il tuo computer, automatizzare file locali o eseguire modifiche e revisioni chirurgiche su codice e documenti già esistenti.

Immagina che tu abbia un vecchio sito del tuo blog con:

- homepage,

- pagina “Chi sono”,

- una newsletter che non funziona bene,

- un footer vecchio,

- e un design un po’ datato.

Caso 1 — Claude Code

Tu apri la cartella del progetto e dici:

“Rifai il footer, aggiungi il link alla privacy policy, correggi il form newsletter e rendi la homepage più pulita.”

Claude Code lavora dentro quel progetto già esistente: legge i file, modifica il codice, può fare refactor, creare nuove pagine e sistemare bug in modo iterativo.

Qui non sta “inventando un software astratto”: sta trasformando un codice reale che già esiste.

Caso 2 — Google Builder Stack

Con un builder stack di tipo Google, invece, tu parti più spesso così:

“Voglio un’app per gestire i miei articoli, con login, dashboard, editor e pubblicazione.”

Qui l’idea è più “da zero”: l’IA ti aiuta a progettare e costruire l’app completa, spesso in modo più orchestrato e agentico, con passaggi di prototipazione, UI, logica e test.

Caso 3 — Perplexity Search Stack

Con Perplexity non stai creando il sito e non stai modificando il codice. Stai chiedendo:

“Qual è il modo migliore per strutturare il footer? Quali pattern usa un buon form newsletter? Dammi fonti e confronti.”

Perplexity qui ti serve per ricercare, confrontare e citare informazioni affidabili, non per eseguire il lavoro tecnico dentro il progetto.

Esempio in una frase

Se il tuo blog è una casa:

- Claude Code è l’artigiano che entra in casa e rifà cucina, impianto e mobili.

- Google Builder Stack è il cantiere che ti aiuta a costruire la casa da zero.

- Perplexity è l’architetto-ricercatore che ti dice come dovrebbe essere fatta, con fonti e confronti.

Quindi “crea” cosa?

Claude Code crea codice, pagine, feature, refactor e correzioni dentro un progetto esistente.

Non è meno creativo: è più chirurgico. Se vuoi, nel prossimo messaggio ti faccio un mini-finto prompt reale per ciascuno dei tre, così vedi la differenza parola per par

Domande Frequenti

Tutto quello che devi sapere sull’ecosistema dei Workflow AI 2026

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.