La meccanica dell’invisibilità

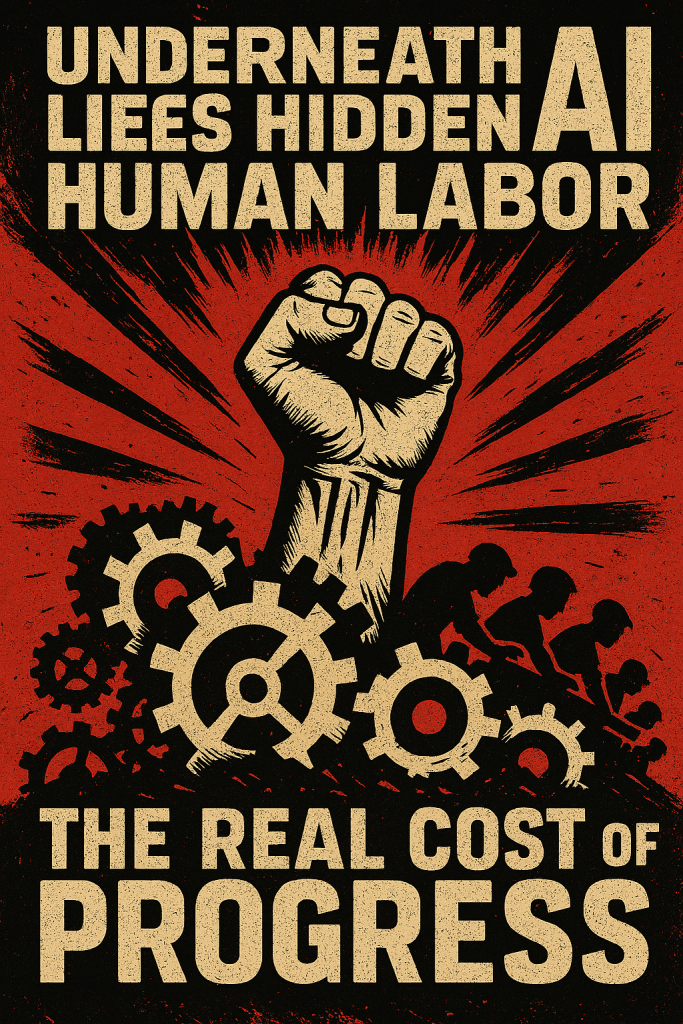

Voglio essere chiaro fin da subito: l’Intelligenza Artificiale non è magica. È lavoro umano travestito da automazione.

Quando ChatGPT mi risponde con apparente spontaneità, dietro ci sono migliaia di persone che hanno etichettato conversazioni, valutato risposte, corretto errori, ripulito contenuti tossici. Quando un’auto a guida autonoma “impara” a riconoscere un pedone, ci sono occhi umani che hanno cerchiato milioni di sagome in milioni di immagini. Quando un sistema di moderazione elimina contenuti violenti sui social media, ci sono moderatori – spesso in paesi del Sud del mondo – che passano otto ore al giorno immersi in un fiume di orrore, trauma dopo trauma, clic dopo clic.

È quello che alcuni ricercatori hanno definito “ghost work”: lavoro fantasma, presente ovunque ma riconosciuto da nessuno. E io, da umanista digitale che ha scelto di guardare oltre la patina scintillante della tecnologia, non posso fare finta di non vederlo.

I numeri che nessuno vuole mostrarti

Secondo uno studio di Mary Gray e Siddharth Suri pubblicato nel loro libro Ghost Work (2019), milioni di persone in tutto il mondo sono impegnate in micro-task digitali che alimentano i sistemi di AI. Amazon Mechanical Turk, una delle piattaforme più note, conta centinaia di migliaia di “turkers” che guadagnano spesso meno di 2 dollari l’ora per compiti ripetitivi e alienanti.

Un’indagine del 2021 condotta da Time Magazine ha rivelato che lavoratori in Kenya, pagati tra 1,32 e 2 dollari l’ora, hanno etichettato dati sensibili per addestrare ChatGPT, esponendosi quotidianamente a contenuti disturbanti senza alcun supporto psicologico adeguato.

Questi non sono numeri astratti. Sono vite umane.

Echi di una storia che non abbiamo mai voluto imparare

La storia, si sa, non si ripete mai identica. Ma fa rima. E le rime che sento oggi risuonano con quelle di epoche che credevamo superate.

I bambini tra gli ingranaggi

Durante la Rivoluzione Industriale, i proprietari delle fabbriche tessili scoprirono che i bambini erano “perfetti” per certi lavori: piccoli, agili, capaci di infilarsi sotto i telai in movimento per recuperare fili o sbloccare meccanismi. Costo del lavoro minimo, rischio per la vita massimo. Le loro dita venivano mutilate, i loro corpi deformati, le loro infanzie rubate. Ma le macchine continuavano a girare e i bilanci delle aziende a crescere.

La narrazione ufficiale dell’epoca celebrava il progresso industriale come inevitabile, necessario, glorioso. Chi osava parlare delle vittime veniva accusato di essere anti-progresso, di voler frenare il destino luminoso dell’umanità.

Il taylorismo e la macchina umana

Nel Novecento, Frederick Taylor perfezionò l’idea di ridurre l’essere umano a componente della catena produttiva. Ogni gesto cronometrato, ogni movimento ottimizzato, ogni secondo contabilizzato. Gli operai della Ford non erano persone: erano estensioni delle macchine, ingranaggi biologici in un sistema che celebrava l’efficienza sopra ogni cosa.

Charlie Chaplin lo immortalò in Tempi Moderni (1936): l’operaio letteralmente inghiottito dagli ingranaggi, trasformato in meccanismo, privato della sua umanità. Eppure quella logica – produttività a ogni costo – continuò a dominare per decenni.

I luddisti: visionari o retrogradi?

Quando i telai meccanici minacciarono il sostentamento dei tessitori artigiani inglesi all’inizio dell’Ottocento, questi si organizzarono e distrussero le macchine. Li chiamarono luddisti, e il termine divenne sinonimo di ottusa resistenza al progresso.

Ma io ho sempre pensato che avessero capito qualcosa di fondamentale: la tecnologia non è neutrale. Non è “progresso” per definizione. È progresso solo se migliora la vita delle persone, se distribuisce benefici invece di concentrarli, se libera invece di opprimere.

Il paradosso dell’AI: costruire il futuro senza diritto al presente

Eccoci qui, nel 2025. L’Intelligenza Artificiale viene celebrata come la tecnologia più rivoluzionaria della nostra epoca. Eppure…

La verità scomoda dell’etichettatura dei dati

Per ogni immagine che un sistema di AI riconosce, ci sono decine di persone che hanno trascorso ore a disegnare rettangoli intorno a oggetti, a classificare scene, a distinguere un gatto da un cane, un semaforo da un palo della luce. Questo lavoro viene chiamato “data labeling” (etichettatura dei dati) ed è assolutamente cruciale: senza di esso, nessuna AI potrebbe funzionare.

Chi lo fa? Spesso lavoratori precari in India, Filippine, Kenya, Venezuela. Piattaforme come Scale AI, Appen, Lionbridge gestiscono eserciti di annotatori che lavorano da casa, pagati a cottimo, senza contratti stabili, senza tutele sindacali, senza nemmeno la garanzia di un reddito minimo.

I moderatori dei contenuti: il trauma industrializzato

Un caso ancora più drammatico riguarda i moderatori di contenuti. Per mantenere Facebook, YouTube, TikTok “puliti” da violenza, pornografia infantile, terrorismo, suicidi in diretta, servono eserciti di persone che visionano materiale disturbante per ore ogni giorno.

Un’inchiesta del Guardian del 2022 ha documentato le condizioni dei moderatori outsourcing in Kenya che lavoravano per Meta (Facebook): turni estenuanti, esposizione continua a contenuti traumatici, supporto psicologico inadeguato, contratti precari con stipendi che raramente superavano i 600 dollari al mese.

Molti di loro hanno sviluppato disturbi post-traumatici da stress. Alcuni hanno tentato il suicidio. Ma quando apri Facebook e lo trovi “sicuro”, quella sicurezza è stata pagata con la salute mentale di qualcun altro.

La gig economy dell’intelligenza

C’è poi l’esercito dei lavoratori delle piattaforme digitali: quelli che addestrano chatbot conversando con loro per ore, che valutano la qualità delle risposte generate dall’AI, che “insegnano” al machine learning cosa è giusto e cosa è sbagliato.

Sono freelance digitali sparsi per il mondo, collegati attraverso piattaforme come Amazon Mechanical Turk, dove i compiti vengono pagati pochi centesimi l’uno. Un ricercatore del MIT, Antonio Casilli, li ha definiti “il proletariato digitale”: una classe lavoratrice globale, frammentata, invisibile, priva di rappresentanza.

Il mio disappunto non è nostalgia: è consapevolezza storica

Quando esprimo disagio verso questa situazione, non lo faccio perché sono contro l’innovazione. Lo faccio perché sono per l’umanità.

Come umanista digitale, credo profondamente che la tecnologia debba essere al servizio delle persone, non il contrario. E quando vedo ripetersi gli stessi schemi di sfruttamento che hanno caratterizzato ogni grande transizione tecnologica della storia, non posso rimanere in silenzio.

La retorica dell’inevitabilità

Ogni volta che sollevo questi temi, c’è sempre qualcuno che replica: “Ma è così che funziona il progresso. È inevitabile. Non puoi fermarlo.”

No. Il progresso non è inevitabile. O meglio: la tecnologia potrebbe essere inevitabile, ma il modo in cui la usiamo no.

Non era inevitabile far lavorare bambini di sei anni nelle miniere. Non era inevitabile tenere operai in catena di montaggio per sedici ore al giorno. Non era inevitabile distruggere le comunità artigiane senza offrire alternative. Tutte queste cose sono accadute perché qualcuno le ha scelte, perché qualcuno ha deciso che il profitto valeva più della dignità umana.

E oggi? Oggi non è inevitabile che i moderatori di contenuti vengano traumatizzati senza supporto. Non è inevitabile che i data labelers guadagnino pochi dollari al giorno. Non è inevitabile che il ghost work rimanga invisibile e sfruttato.

Cosa significa davvero “progresso”?

Il vero progresso non è la velocità a cui le nostre macchine elaborano dati. Non è la perfezione degli algoritmi. Non è nemmeno la capacità di un’AI di superare un test di Turing.

Il vero progresso è come trattiamo le persone che rendono possibile quel progresso.

È garantire condizioni di lavoro dignitose. È riconoscere il valore del lavoro invisibile. È distribuire i benefici dell’innovazione invece di concentrarli nelle mani di pochi miliardari della Silicon Valley. È costruire tecnologie che amplificano le capacità umane invece di sfruttarle.

Verso un’etica del riconoscimento

Cosa possiamo fare? Come umanista digitale, ho alcune convinzioni chiare.

1. Rendere visibile l’invisibile

Il primo passo è nominare ciò che viene tenuto nascosto. Parlare dei ghost workers, documentare le loro storie, portare alla luce le condizioni di lavoro che le aziende tecnologiche preferirebbero non far vedere.

Quando usi ChatGPT, sappi che dietro c’è lavoro umano. Quando guardi un video su YouTube filtrato dai contenuti violenti, ricorda chi ha pagato il prezzo di quella pulizia. La consapevolezza è già un atto politico.

2. Rivendicare trasparenza e responsabilità

Le aziende tecnologiche devono essere obbligate a rendere conto delle loro filiere produttive. Non basta dire “usiamo AI”. Bisogna spiegare: chi l’ha addestrata? In che condizioni? Con quali tutele?

Se un’azienda di moda deve dichiarare dove vengono cuciti i suoi vestiti, perché un’azienda di AI non dovrebbe dichiarare dove e come vengono etichettati i suoi dati?

3. Riconoscere diritti e dignità

I ghost workers devono avere contratti dignitosi, salari equi, tutele sociali, rappresentanza sindacale. Non è utopia: è il minimo sindacale di civiltà.

Ci sono già esempi positivi: alcune organizzazioni stanno sperimentando modelli cooperativi dove i lavoratori delle piattaforme digitali diventano co-proprietari. È un inizio.

4. Ripensare il concetto stesso di automazione

L’automazione non dovrebbe essere vista come sostituzione dell’umano, ma come liberazione dell’umano da compiti alienanti. Ma perché questo accada davvero, serve una redistribuzione del valore creato.

Dobbiamo porci la domanda fondamentale: a chi appartiene il valore generato dall’AI? Solo agli azionisti delle Big Tech? O anche a chi ha contribuito ad addestrare quei sistemi?

Una chiamata all’azione (personale e collettiva)

Non voglio concludere con pessimismo. Sono convinto che possiamo fare meglio. Che la tecnologia possa davvero essere liberatoria, se scegliamo di costruirla in modo diverso.

Ma per farlo, serve coraggio. Il coraggio di mettere in discussione narrazioni consolidate. Il coraggio di chiamare per nome lo sfruttamento quando lo vediamo, anche se si nasconde dietro interfacce eleganti e presentazioni PowerPoint patinate.

Serve anche empatia: la capacità di vedere l’altro, anche quando è dall’altra parte del mondo, anche quando il suo lavoro è invisibile, anche quando il sistema fa di tutto per tenerlo nascosto.

E serve memoria storica: ricordare che ogni volta che abbiamo ceduto alla retorica dell’inevitabilità, abbiamo permesso ingiustizie che poi ci sono voluti decenni per correggere.

Il fantasma che voglio diventare

Concludo con un’immagine. Se i ghost workers sono i fantasmi invisibili del digitale, io voglio essere un altro tipo di fantasma: quello che tormenta le coscienze, che non lascia dormire tranquilli, che ricorda insistentemente che dietro ogni schermo c’è sempre un essere umano.

Voglio essere il fantasma che infesta le conferenze sulla tecnologia dove si celebra l’AI senza mai nominare chi l’ha costruita. Voglio essere il fantasma che sussurra nelle orecchie dei CEO: “E i tuoi lavoratori? Stanno bene? Li hai mai guardati negli occhi?”

Perché alla fine, questo è ciò che significa essere un umanista digitale: non rifiutare la tecnologia, ma pretendere che sia profondamente, radicalmente umana.

E l’umanità si misura nel modo in cui trattiamo chi è più vulnerabile, chi è più invisibile, chi è più facilmente dimenticabile.

I fantasmi dell’AI non dovrebbero esistere. O meglio: dovrebbero smettere di essere fantasmi e diventare persone, con volti, nomi, diritti, dignità.

Questo è il futuro digitale che voglio contribuire a costruire. E spero che, leggendo queste parole, anche tu senta lo stesso bisogno di rendere visibile l’invisibile. 🌟

👻 FAQ: I Fantasmi dell’Intelligenza Artificiale

Domande e risposte sui ghost workers che costruiscono il futuro digitale rimanendo nell’ombra

I ghost workers (lavoratori fantasma) sono le migliaia di persone invisibili che svolgono il lavoro umano necessario a far funzionare l’Intelligenza Artificiale. Mentre le aziende tecnologiche celebrano l’automazione e l’efficienza degli algoritmi, dietro le quinte ci sono esseri umani che:

- 📝 Etichettano dati: disegnano rettangoli intorno a oggetti nelle immagini per insegnare alle AI a riconoscerli

- 🧹 Puliscono contenuti: moderano post violenti, pornografici o traumatici sui social media

- ✅ Validano risposte: valutano la qualità delle risposte generate dai chatbot

- 🔧 Correggono errori: identificano e segnalano quando l’AI sbaglia

Sono chiamati “fantasmi” perché il loro lavoro è invisibile: non appaiono nei comunicati stampa, non vengono menzionati nelle conferenze tecnologiche, eppure senza di loro nessun sistema di AI potrebbe funzionare.

Le cifre sono drammaticamente basse. Ecco alcuni dati concreti:

- 💵 Su Amazon Mechanical Turk, la paga media è inferiore a 2 dollari l’ora

- 🌍 In Kenya, i lavoratori che hanno etichettato dati per ChatGPT guadagnavano tra 1,32 e 2 dollari l’ora

- 📱 I moderatori di contenuti in outsourcing per Meta guadagnano circa 600 dollari al mese per turni estenuanti

- ⏰ Il lavoro è spesso pagato a cottimo: pochi centesimi per ogni micro-task completato

Per contestualizzare: molti di questi lavoratori guadagnano meno del salario minimo nei loro paesi, mentre le aziende per cui lavorano fatturano miliardi. È uno dei maggiori paradossi dell’economia digitale.

I ghost workers sono distribuiti globalmente, ma la maggior parte si concentra in paesi dove il costo del lavoro è più basso:

- 🇮🇳 India: uno dei maggiori hub per data labeling e micro-tasking

- 🇵🇭 Filippine: specializzata in moderazione di contenuti e customer service digitale

- 🇰🇪 Kenya: sempre più utilizzato dalle Big Tech per content moderation

- 🇻🇪 Venezuela: lavoratori che cercano reddito in una economia in crisi

- 🇺🇸 Stati Uniti: anche qui esistono ghost workers, spesso studenti o persone con lavori precari

La delocalizzazione digitale permette alle aziende di pagare salari bassissimi sfruttando le differenze economiche tra paesi, mentre mantengono i profitti nelle Silicon Valley del mondo.

Le conseguenze sono devastanti, specialmente per chi modera contenuti violenti:

- 🧠 Disturbo post-traumatico da stress (PTSD): esposizione quotidiana a violenza, abusi, suicidi

- 😔 Depressione e ansia: l’alienazione del lavoro ripetitivo e l’isolamento

- 💔 Desensibilizzazione emotiva: perdita della capacità di provare empatia dopo aver visto troppo orrore

- 😴 Disturbi del sonno: incubi ricorrenti legati ai contenuti visionati

- ☠️ Ideazione suicidaria: diversi casi documentati di lavoratori che hanno tentato il suicidio

Il supporto psicologico offerto è spesso inadeguato o inesistente. Un’inchiesta del Guardian ha rivelato che molti moderatori non hanno accesso a terapia professionale, nonostante siano esposti quotidianamente a contenuti che traumatizzerebbero chiunque.

Assolutamente sì. La storia si ripete con dinamiche inquietantemente simili:

- 🏭 Rivoluzione Industriale: bambini nelle fabbriche tessili, corpi mutilati dagli ingranaggi, mentre si celebrava il “progresso”

- ⚙️ Taylorismo: operai ridotti a estensioni delle macchine, cronometrati al secondo, privati di umanità

- 🧵 Luddismo: artigiani inglesi che vedevano distrutte le loro comunità dai telai meccanici, senza alternative

- 🔨 Catene di montaggio: lavoratori alienati che ripetevano lo stesso gesto per 16 ore al giorno

La costante? Ogni volta che una nuova tecnologia promette efficienza e automazione, c’è qualcuno che paga il prezzo invisibile di quel progresso. E ogni volta, la narrazione ufficiale celebra la macchina mentre ignora le persone.

Tecnicamente è legale, ma eticamente discutibile. Ecco perché:

- 📋 Contratti precari: la maggior parte dei ghost workers sono considerati “freelance” o “contractor”, non dipendenti

- 🚫 Nessuna tutela sindacale: non possono organizzarsi, non hanno rappresentanza

- 🌐 Vuoto normativo: le leggi sul lavoro faticano a regolare il lavoro digitale transnazionale

- 💼 Outsourcing: le Big Tech usano intermediari per distanziarsi dalla responsabilità diretta

- ⚠️ Assenza di standard globali: ogni paese ha regole diverse, facilitando lo sfruttamento

Alcune organizzazioni stanno cercando di cambiare le cose (come Fairwork, che certifica le piattaforme etiche), ma la strada è lunga. Servono leggi internazionali che proteggano i lavoratori digitali.

Questo è il grande mito dell’Intelligenza Artificiale. La realtà è molto diversa:

- 🎭 L’AI non è autonoma: ha bisogno di dati etichettati da umani per imparare

- 🔍 Supervisione continua: anche i sistemi “automatici” richiedono validazione umana costante

- 🧩 Compiti complessi: l’AI fatica con contesti ambigui, sfumature culturali, giudizi etici

- ♻️ Ciclo infinito: più l’AI cresce, più servono umani per addestrare nuovi modelli

- 🎨 Creatività e empatia: restano prerogative umane insostituibili

L’automazione non elimina il lavoro umano: lo nasconde, lo rende invisibile, lo svalorizza. Quando usi ChatGPT, non stai interagendo con “pura tecnologia”, ma con il frutto di migliaia di ore di lavoro umano che qualcuno ha reso possibile.

Ci sono azioni concrete che possiamo intraprendere, sia individualmente che collettivamente:

- 👁️ Consapevolezza: informarsi e informare altri sull’esistenza dei ghost workers

- 📢 Pressione sulle aziende: chiedere trasparenza nelle filiere produttive dell’AI

- ✊ Sostenere l’organizzazione: appoggiare i tentativi di sindacalizzazione dei lavoratori digitali

- 🗳️ Advocacy politica: spingere per leggi che tutelino i ghost workers

- 🤝 Preferire piattaforme etiche: scegliere servizi che certificano condizioni di lavoro dignitose

- 💰 Equa distribuzione del valore: sostenere modelli cooperativi dove i lavoratori sono co-proprietari

Come umanista digitale, credo che il primo passo sia rendere visibile l’invisibile. Ogni volta che parliamo di AI, dobbiamo ricordare le persone che l’hanno resa possibile. Solo così possiamo costruire un futuro tecnologico davvero umano.

🌟 Vuoi approfondire l’Umanesimo Digitale?

Scopri come mettere le persone al centro della rivoluzione tecnologica. Insieme possiamo costruire un futuro digitale più etico, consapevole e umano.

Inizia il Percorso 🚀📚 Risorse e Approfondimenti

Una collezione curata di articoli, reportage e analisi in italiano sui ghost workers dell’Intelligenza Artificiale. Scopri le voci di chi ha indagato il lato nascosto della rivoluzione digitale.

🔍 Perché leggere queste risorse?

Ho raccolto per te i migliori articoli, reportage e analisi pubblicati in italiano che documentano la realtà dei lavoratori invisibili dell’AI. Ogni risorsa offre una prospettiva unica: dalle inchieste giornalistiche alle analisi accademiche, dalle testimonianze dirette alle proposte di cambiamento. Questi testi sono essenziali per chiunque voglia comprendere davvero cosa c’è dietro l’apparente “magia” degli algoritmi e per costruire insieme un futuro digitale più etico e umano.

🎯 Il lavoro invisibile

Intervista fondamentale a Mary Gray, antropologa e coautrice del libro “Ghost Work”, che ha studiato per anni le condizioni dei lavoratori invisibili dell’AI. Gray spiega come dietro ogni “automazione” ci siano persone reali, spesso altamente istruite, che lavorano in condizioni precarie.

- Il paradosso dei servizi on-demand

- Lavoratori istruiti in lavori invisibili

- La necessità di un nuovo contratto sociale

Leggi l’articolo →

👻 Ghost worker: il fantasma all’opera

Un’analisi lucida e diretta sulla realtà dei ghost workers in Italia e nel mondo. L’articolo descrive la giornata tipo di chi “nutre le macchine” che poi faranno a meno di noi, e denuncia salari minimi, competizione globale al ribasso e la “tassa” che i lavoratori devono pagare per essere visibili sulle piattaforme.

- Platform economy e gig work

- Salari inferiori a 2$/ora

- Il “pizzo” delle piattaforme digitali

Leggi l’articolo →

⚡ I proletari dell’intelligenza artificiale

Reportage approfondito che racconta i “sottoproletari dei dati”: chi sono, dove lavorano, quanto guadagnano e quali traumi psicologici subiscono. Include interviste a esperti come Teresa Numerico e Antonio Casilli, e documenta i primi tentativi di sindacalizzazione.

- Traumi psicologici dei moderatori

- Lavoratori italofoni in Nordafrica

- Movimenti sindacali in Kenya e Germania

Leggi l’articolo →

🌍 Un’intelligenza non così artificiale

Articolo recente che racconta le storie di Dylan Baker (ex-Google) e Oskarina Fuentes, due voci che hanno deciso di parlare apertamente dei bias nei sistemi di IA e delle condizioni di lavoro di chi produce i dati. Include la loro testimonianza al Parlamento Europeo.

- Testimonianza di un ex-ingegnere Google

- Lavori del clic e micro-task

- Intervento al Parlamento Europeo

Leggi l’articolo →

📖 Il lavoro invisibilizzato dietro l’IA

Recensione del libro “Waiting for Robots” di Antonio Casilli, sociologo che smonta il mito dell’IA autonoma. L’articolo spiega come lo sviluppo tecnologico non cancelli il lavoro umano, ma lo trasformi rendendolo invisibile e più facilmente sfruttabile.

- Microwork e lavoro sui social media

- Disuguaglianze globali

- Proprietà collettiva dei dati

Leggi l’articolo →

💬 5 Neologismi sul Lavoro Digitale

Articolo che introduce e spiega i termini chiave del lavoro digitale contemporaneo: ghost work, hope labor, hyperemployment. Perfetto per chi vuole comprendere il linguaggio con cui si descrivono queste nuove forme di sfruttamento.

- Ghost Work: lavoro invisibile online

- Hope Labor: lavoro gratuito per visibilità

- Hyperemployment: lavoro estenuante per algoritmi

Leggi l’articolo →

🛡️ NO AI LAVORATORI FANTASMA

Campagna sindacale della UIL contro la precarietà e il lavoro invisibile in Italia. Documenta i 3 milioni di lavoratori in nero nel nostro paese e propone azioni concrete per far “tornare persone” i lavoratori fantasma, con materiali scaricabili per la mobilitazione.

- 3 milioni di lavoratori sommersi in Italia

- Lotta alla precarietà

- Materiali per attivismo

Scopri la campagna →

🔬 I lavoratori invisibili guidano l’IA

Articolo tecnico che analizza il problema delle scarse prospettive di carriera per i ghost workers. Include proposte concrete di Sapih Savage (West Virginia University) per migliorare le condizioni: strumenti AI per valutare i task, formazione, stage e un cambio di narrazione.

- Strumenti per valutare la convenienza dei task

- Percorsi di formazione e sviluppo competenze

- Cambiamento della narrazione

Leggi l’articolo →

🚀 Vuoi approfondire l’Umanesimo Digitale?

Queste risorse sono solo l’inizio di un percorso di consapevolezza. Come umanista digitale, credo che la conoscenza sia il primo passo verso il cambiamento. Insieme possiamo costruire un futuro tecnologico più etico, equo e umano.

Se vuoi esplorare questi temi, discutere le implicazioni etiche dell’AI o collaborare per progetti di formazione e sensibilizzazione, sono a tua disposizione.

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.