Il Risveglio dei Conti

Mi ricordo perfettamente la prima volta che ho inserito il numero della mia carta di credito per pagare un’intelligenza artificiale. Era il febbraio del 2023, ChatGPT Plus era appena arrivato sul mercato a 20 dollari al mese, e io ero così affascinato dalla promessa di avere un assistente cognitivo sempre disponibile da non badare alla spesa. Ventidue euro circa, in Italia, che al cambio potevano sembrare il prezzo di due pizze e una birra. Un sacrificio accettabile per scrivere meglio, programmare più veloce, pensare più in grande.

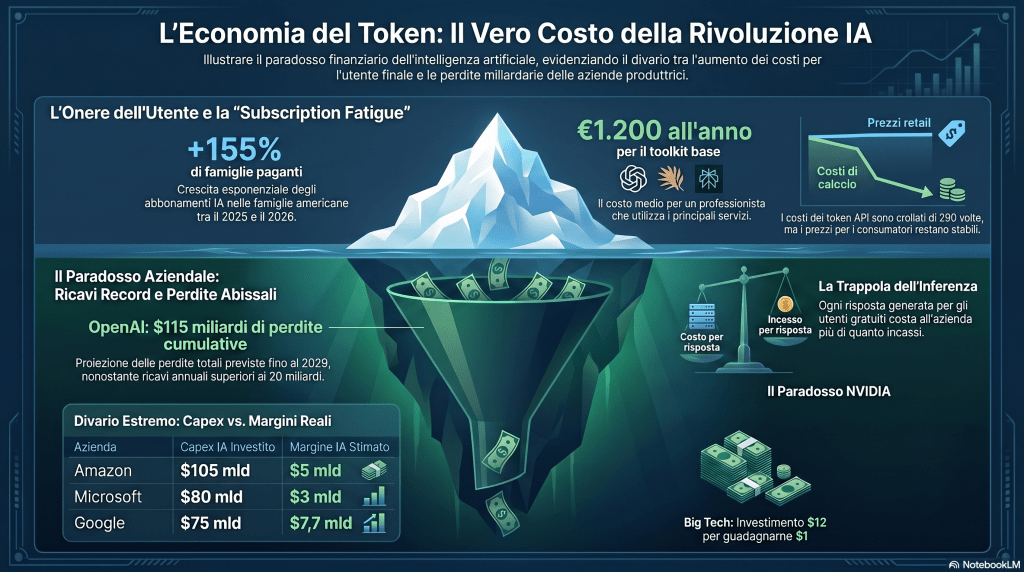

Quello che non sapevo era che quella prima transazione sarebbe diventata la punta di un iceberg finanziario che oggi, nel 2026, si è trasformato in un vero e proprio stile di vita: l’economia del token. E che quell’iceberg avesse due facce speculari e ugualmente sbalorditive, una per l’utente finale e una per le aziende stesse che quei servizi li costruiscono e li vendono.

Oggi guardo il mio estratto conto mensile e conto almeno sei abbonamenti attivi legati all’intelligenza artificiale. ChatGPT Plus a circa 23 euro (inclusa IVA europea), Claude Pro a 20 dollari, Midjourney per le immagini, Perplexity Pro, Microsoft Copilot, e un servizio di generazione contenuti che uso per lavoro. In totale, parliamo di circa 100-120 euro al mese, ovvero oltre 1.200 euro all’anno, solo per avere accesso a strumenti che tre anni fa non esistevano o erano completamente gratuiti.

E non sono il solo. Secondo i dati di PNC Bank pubblicati nell’aprile del 2026, la quota di famiglie americane che paga per un abbonamento AI generativa è cresciuta del 155% rispetto all’anno precedente. Eppure siamo ancora solo il 2% delle famiglie statunitensi, prevalentemente nei redditi più alti. Il che pone una domanda che nessuno vuole rispondersi: stiamo pagando per il futuro, o stiamo semplicemente finanziando il lusso di pochi?

I Numeri di un’Economia Invisibile

Per comprendere la portata del fenomeno, basta guardare i dati. OpenAI ha chiuso il 2025 superando i 20 miliardi di dollari di ricavi annuali, come confermato dalla CFO Sarah Friar, partendo da circa 8 miliardi nella prima metà dell’anno e accelerando nella seconda. Una crescita superiore al 200% rispetto all’anno precedente, con oltre 20 milioni di utenti paganti e quasi un miliardo di utenti attivi settimanali in totale. Questo significa che meno del 3% degli utenti paga, ma genera entrate sufficienti a rendere OpenAI una delle aziende a più rapida crescita nella storia della tecnologia.

Secondo le proiezioni di Gartner, la spesa globale per l’intelligenza artificiale raggiungerà i 2.520 miliardi di dollari nel 2026, con un aumento del 44% rispetto all’anno precedente. Una cifra che include infrastrutture, software, servizi e dati, ma che riflette una verità fondamentale: l’AI non è più un settore di nicchia, è l’ossatura stessa della nuova economia globale.

E qui si nasconde il paradosso più bruciante: i prezzi dei token API, quelle unità di calcolo che alimentano ogni risposta di un chatbot, sono crollati di 280 volte dal 2022 al 2024, secondo lo Stanford AI Index. I costi per le aziende sono precipitati, ma i prezzi al dettaglio per i consumatori sono rimasti stabili o sono addirittura aumentati. È come se il prezzo del greggio per le raffinerie fosse crollato di due ordini di grandezza, ma al distributore continuassimo a pagare 2 euro al litro. L’efficienza computazionale non si trasmette verso il basso: si capitalizza verso l’alto.

La Struttura dei Prezzi: un’Architettura di Dipendenza

La struttura a piani di ChatGPT è emblematica di questa strategia. Nel gennaio 2026, OpenAI ha lanciato ufficialmente ChatGPT Go a 8 dollari al mese, ampliando l’accesso a GPT-5.2 Instant con limiti più alti e memoria estesa. La gamma completa oggi è articolata così:

- Piano Free, accesso base a GPT-5.2 Instant, con un limite di circa 10 messaggi ogni 5 ore

- ChatGPT Go, 8 dollari al mese, con pubblicità e limiti intermedi

- ChatGPT Plus, 20 dollari al mese (circa 22-24 euro in Europa con IVA), accesso a GPT-5.2 Thinking

- ChatGPT Pro, 200 dollari al mese, accesso illimitato a GPT-5.2 Pro e Sora 2 Pro

- Team, 25-30 dollari per utente al mese per piccole imprese

In Italia, il piano Pro con IVA supera ampiamente i 220 euro al mese, una cifra che, nelle regioni del Mezzogiorno, può avvicinarsi al costo di un affitto mensile. Anthropic con Claude Pro propone tariffe simili, Google Gemini Advanced costa 19,99 dollari al mese, Perplexity Pro si aggira sui 20 dollari. Il risultato netto è che un professionista che voglia disporre di un toolkit AI completo spende facilmente 80-120 euro al mese, senza contare le versioni team o enterprise.

Ciò che rende questa architettura particolarmente insidiosa è la sua psicologia del rinnovo automatico. Non si compra un prodotto, si noleggia un accesso. E quel noleggio si rinnova ogni mese, contando sulla nostra abitudine, sulla nostra pigrizia, sulla nostra difficoltà nel premere il piccolo pulsante “Annulla” nascosto nelle impostazioni dell’account. Ogni servizio diventa un ingranaggio della nostra vita professionale, e questo è esattamente il punto: l’economia dei token non vende servizi, vende dipendenza strutturale.

Il Mercato si Frammenta, ma i Prezzi No

Nel 2026, il mercato dei chatbot generativi è molto più frammentato di quanto fosse due anni fa. Secondo i dati di Similarweb aggiornati a gennaio 2026, ChatGPT detiene il 64,5% del traffico web tra i chatbot AI, sceso però dall’86,7% di gennaio 2025, a dimostrazione di una concorrenza in crescita. Google Gemini ha guadagnato terreno, Microsoft Copilot si consolida nell’enterprise, e Claude AI ha raggiunto il 4,9% con una crescita trimestrale del 14%, la più alta del settore tra i player principali.

Questa frammentazione è una buona notizia in teoria: più concorrenti dovrebbero significare pressione sui prezzi. Ma nella pratica non è così. Nessuno dei grandi player ha abbassato i prezzi al consumatore. Tutti si muovono attorno alla stessa soglia psicologica dei 20 dollari al mese, come se ci fosse un accordo implicito. Il risultato è un’oligarchia di fatto che si spartisce un mercato in crescita esponenziale senza competere sul costo.

La vera guerra si combatte sull’upper end: chi offre il modello più potente a 200 dollari? Chi ha il miglior piano enterprise? L’utente comune, quello che vuole semplicemente uno strumento utile per lavorare o studiare, è intrappolato nel mezzo: troppo avanzato per accontentarsi del piano gratuito, troppo normale per giustificare 200 dollari al mese.

La “Subscription Fatigue” e il Costo Reale del Pensiero

Il mercato ha risposto a questa dinamica con un fenomeno che potremmo chiamare “AI subscription fatigue”, la stanchezza da abbonamenti AI. Su Reddit, thread interi sono dedicati alla domanda angosciante: “Qual è l’unico servizio AI per cui vale davvero la pena pagare?”. Su LinkedIn, post virali lamentano come i costi AI stiano erodendo i budget personali e aziendali.

Il problema non è solo il costo assoluto. È il costo invisibile della gestione. Oggi un professionista non solo paga per gli abbonamenti AI: deve anche decidere quale usare per quale compito, monitorare i limiti di utilizzo, aggiornare i piani quando arrivano nuovi modelli, confrontare continuamente le funzionalità. L’AI ha promesso di liberarci dal lavoro ripetitivo, ma ci ha regalato un nuovo lavoro cognitivo non retribuito: quello di gestire la nostra stessa infrastruttura di pensiero.

E poi c’è l’ironia suprema: anche pagando, i limiti ci raggiungono. Pago ChatGPT Plus e durante i picchi di utilizzo mi trovo davanti al messaggio “Hai superato i limiti orari”. Pago per un servizio che si presenta come illimitato ma che, nei fatti, è razionato. È come avere un abbonamento in palestra e scoprire che puoi entrare solo tre volte a settimana nei giorni di maggiore affluenza. Sei il cliente da trattenere e la risorsa da razionare, contemporaneamente.

Il Grande Paradosso: Miliardi di Ricavi, Miliardi di Perdite

Ed ecco dove l’economia del token rivela la sua contraddizione più clamorosa, quella che nessun comunicato stampa ama sottolineare. Le aziende che guidano la rivoluzione AI crescono a velocità record, generano decine di miliardi di ricavi, e continuano a perdere soldi a ritmo ancora più accelerato. Non nonostante il successo, ma proprio a causa di esso.

OpenAI è l’emblema perfetto di questa contraddizione. Nel 2025 ha superato i 20 miliardi di dollari di ricavi, una crescita straordinaria, ma ha contemporaneamente bruciato circa 9 miliardi di dollari di cash, spendendo 1,69 dollari per ogni dollaro guadagnato. Il 2026 è ancora peggio: i documenti interni prevedono una perdita operativa di 14 miliardi di dollari, con i soli costi di training dei modelli che raggiungono i 10 miliardi. E la proiezione a lungo termine è semplicemente vertiginosa: OpenAI prevede di accumulare 115 miliardi di perdite cumulative fino al 2029, prima di avvicinarsi alla redditività intorno al 2030. Eppure la sua valutazione sfiora gli 830 miliardi di dollari.

Per dare una misura concreta di questa cifra: 115 miliardi di perdite accumulate equivalgono a quasi quattro volte il costo del Progetto Manhattan in dollari odierni, e a circa un terzo dell’intero Progetto Apollo. È la scommessa finanziaria più grande mai fatta su una singola tecnologia nella storia dell’umanità.

Anthropic, la società madre di Claude, segue una traiettoria diversa ma non meno paradossale. È cresciuta da 1 miliardo di ARR nel dicembre 2024, con proiezioni che puntano a 20-26 miliardi nel 2026, una crescita che non ha precedenti nel settore tech.

Eppure i costi di infrastruttura e ricerca la mantengono profondamente in rosso, con un punto di breakeven atteso non prima del 2027-2028. La differenza strutturale con OpenAI è però significativa: Anthropic ha scelto un modello enterprise-first, con l’80% dei ricavi da clienti business come Deloitte, Salesforce e Microsoft, il che rende il suo percorso verso la redditività più credibile e meno dipendente dalla volatilità del mercato consumer.

Chi Guadagna Davvero: il Paradosso NVIDIA

Il quadro si fa ancora più vertiginoso se si guarda all’intero ecosistema. Un’analisi recente ha calcolato che Microsoft, Amazon, Google e Meta hanno investito complessivamente 332 miliardi di dollari in infrastrutture AI, ottenendo in cambio circa 28 miliardi di margini AI, un rapporto di 12 dollari investiti per ogni dollaro guadagnato.

| Azienda | Capex AI investito | Margine AI stimato |

|---|---|---|

| Amazon | $105 mld | $5 mld |

| $75 mld | $7,7 mld | |

| Microsoft | $80 mld | $3 mld |

| Meta | $72 mld | $2-3 mld |

| Totale | $332 mld | $28 mld |

L’unica azienda che sta effettivamente guadagnando dall’AI con margini solidi e documentati è NVIDIA. E il dato più paradossale di tutti è che una quota rilevante dei suoi ricavi proviene proprio dalle aziende che stanno perdendo di più. NVIDIA vende le pale durante la corsa all’oro, e le pale le comprano i cercatori d’oro che ancora non hanno trovato niente. È la metafora più perfetta e impietosa di questo momento storico.

La “Trap dell’Inferenza”: Perché Ogni Risposta Costa

C’è un dettaglio tecnico che spiega strutturalmente queste perdite e che è raramente comunicato al grande pubblico. Nella prima metà del 2025, i costi di inferenza di OpenAI, cioè il costo computazionale di elaborare ogni singola risposta, superavano i ricavi generati dagli utenti free. Ogni volta che un utente gratuito chiedeva qualcosa a ChatGPT, OpenAI ci rimetteva dei soldi. Ogni. Singola. Volta.

Questo è il nucleo strutturale del paradosso: l’AI è un prodotto dove il costo marginale di produzione è enorme e non scende abbastanza velocemente rispetto alla scala dell’utilizzo. Più utenti hai, più perdi, almeno finché non trovi un equilibrio tra costi computazionali e monetizzazione. Un equilibrio che, evidentemente, non è ancora stato trovato. Ed è per questo che i prezzi degli abbonamenti consumer non scenderanno presto: non per avidità pura, ma perché ogni token generato costa ancora molto più di quanto sembri dall’esterno.

La Promessa Democratica e la Realtà delle Diseguaglianze

Quando ChatGPT è arrivato, la narrazione era potente e seducente: l’AI avrebbe democratizzato la conoscenza. E in parte è vero. Ma ciò che nessuno ci ha detto è che la democratizzazione avrebbe avuto un prezzo, e che quel prezzo avrebbe selezionato chi può permettersi di stare al passo con la rivoluzione cognitiva.

Come umanista digitale, questa è la parte che mi preoccupa di più. Non i 20 dollari al mese in sé, una cifra sostenibile per molti professionisti occidentali. Mi preoccupa il divario cognitivo che si sta aprendo tra chi ha accesso agli strumenti AI più potenti e chi no. Tra uno studente universitario a Milano che può permettersi Claude Pro e uno a Lagos o a Palermo che usa il piano gratuito con limitazioni. Le disuguaglianze digitali del passato riguardavano l’accesso a internet. Le disuguaglianze del futuro riguarderanno l’accesso alla qualità del pensiero artificiale.

OpenAI ha già comunicato la volontà di continuare ad aumentare i prezzi degli abbonamenti di anno in anno. La logica è impietosa: prima ti fanno assuefare con un prezzo accessibile e un prodotto straordinario, poi alzano la tariffa sapendo che non puoi più farne a meno. Non è fantascienza distopica. È il normale funzionamento del mercato applicato a qualcosa che, per la prima volta nella storia, riguarda il potenziamento cognitivo dell’essere umano.

Un Futuro a Gettoni

Rifletto su tutto questo mentre il mio telefono vibra con una notifica: “Il tuo abbonamento a Claude Pro si rinnoverà tra 3 giorni.” Non lo annullerò. Non oggi, perlomeno. Perché Claude mi serve per scrivere, ChatGPT per programmare, Midjourney per le immagini. Ogni servizio è diventato un ingranaggio essenziale della mia vita professionale, e questo è esattamente il punto.

Queste aziende sono sostenute da valutazioni speculative enormi: OpenAI vale 830 miliardi pur prevedendo 115 miliardi di perdite cumulative nei prossimi anni. Gli investitori scommettono su un futuro monopolio cognitivo talmente dominante da giustificare qualsiasi perdita presente.

È la stessa logica di Amazon negli anni Novanta: bruciare cassa per comprare il futuro. Ma Amazon vendeva libri e poi pacchi. OpenAI vende qualcosa di molto più sottile: l’accesso al pensiero aumentato. E se la scommessa non dovesse funzionare, o se i finanziamenti si prosciugassero, il rischio non è solo una serie di fallimenti aziendali. È la destabilizzazione di infrastrutture cognitive su cui milioni di professionisti si sono già resi dipendenti.

Forse un giorno l’intelligenza artificiale diventerà un bene pubblico, accessibile e gratuito come l’acqua o l’istruzione di base. O forse no. Forse vivremo in un mondo dove ogni paragrafo scritto, ogni immagine generata, ogni risposta ottenuta avrà un costo microscopico ma incessante, dove il libero arbitrio di creare sarà condizionato dalla capacità di pagare.

Nel frattempo, io rinnovo il mio abbonamento e premo “Conferma pagamento” con la stessa rassegnazione con cui si paga una bolletta della luce. Perché in fondo, in questa nuova economia, l’intelligenza artificiale è diventata esattamente questo: un’altra utenza da pagare. Solo che invece di illuminare una stanza, promette di illuminare il futuro. E il prezzo, come sempre, lo paghiamo noi. Salvo poi scoprire che chi quella luce la produce sta ancora aspettando di capire come pagare la propria bolletta.

❓ Domande Frequenti

Tutto quello che devi sapere sull’economia del token e gli abbonamenti AI nel 2026

© 2026 Franco Bagaglia, umanesimodigitale.info

📚 Fonti e Riferimenti

Dati verificati da fonti primarie per l’articolo L’Economia del Token, maggio 2026

OpenAI

🗞️ OpenAI prevede perdite fino al 2028, profittabilità verso il 2030 Fortune, novembre 2025, documenti finanziari interni OpenAI 🗞️ $14 miliardi di perdite nel 2026, OpenAI cerca $100B di finanziamenti RD World Online, gennaio 2026, The Information 📈 Le previsioni interne di OpenAI: $14 miliardi di perdita nel 2026 Yahoo Finance, gennaio 2026 📰 OpenAI non raggiunge gli obiettivi di ricavi mentre corre verso l’IPO Reuters, aprile 2026, Wall Street Journal 🤖 Lancio ufficiale ChatGPT Go — disponibile in tutto il mondo OpenAI.com (fonte primaria ufficiale), gennaio 2026Mercato e Prezzi

📊 Quote di mercato chatbot generativi — aprile 2026 First Page Sage, aprile 2026 (ChatGPT 64,5%, Claude 4,9%, Gemini 15,3%) 💳 ChatGPT Pricing 2026: tutti i piani, livelli e costi nascosti Fritz.ai, aprile 2026 👥 Chi spende soldi per gli abbonamenti AI e perché Yahoo Finance, PNC Bank, aprile 2026 (crescita +155% abbonamenti AI) 💰 OpenAI Pricing 2026: piani individuali, organizzazioni e sviluppatori Finout, 2026Anthropic

🔬 Anthropic punta a $70 miliardi di ricavi entro il 2028 TechCrunch, novembre 2025 📉 Il miracolo della crescita e le sei fratture: Anthropic nel 2026 Substack, febbraio 2026 (ARR 10x in 14 mesi)Ecosistema AI e NVIDIA

🖥️ State of AI Report 2026: ricavi, costi e impatto economico NVIDIA Blog (fonte primaria), marzo 2026 📋 Analisi bilanci grandi aziende AI: $332 mld investiti, $28 mld margini LinkedIn, Paolo Perrone, aprile 2026 🌐 OpenAI affronta un anno decisivo nel 2026 The Economist, dicembre 2025Fonti verificate al 9 maggio 2026

umanesimodigitale.info ↗Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.