La caverna che non sapevamo di abitare

Permettimi di portarti per un momento in un luogo buio e antico. Immagina una caverna sotterranea. Dentro ci sono degli uomini incatenati fin dall’infanzia, non possono girarsi, non possono muoversi, possono solo guardare una parete di roccia davanti a loro. Dietro di loro arde un fuoco, e tra il fuoco e loro passano delle figure che portano oggetti. Sul muro, i prigionieri vedono solo le ombre di questi oggetti. Ombre di uomini, ombre di animali, ombre di alberi.

Per tutta la vita, quei prigionieri hanno creduto che le ombre fossero la realtà. Non avevano mai visto null’altro.

Questa è l’Allegoria della Caverna, scritta da Platone nel dialogo La Repubblica intorno al 380 avanti Cristo. È forse la metafora più potente che il pensiero occidentale abbia mai prodotto sulla natura della conoscenza. Platone voleva dire qualcosa di preciso: quello che i nostri sensi percepiscono non è la realtà ultima delle cose, ma solo una sua proiezione. Dietro il mondo visibile esiste un piano più profondo, il mondo delle Idee, delle forme pure e perfette, di cui ogni cosa concreta è solo una copia imperfetta.

Per secoli, i filosofi hanno discusso se Platone avesse ragione o torto. Se esistesse davvero questo piano nascosto, questa realtà più vera della realtà.

Poi sono arrivati i computer. E la risposta è arrivata da dove nessuno se l’aspettava.

Quando le macchine iniziano a sognare

Siamo nel 2024. In un laboratorio del Massachusetts Institute of Technology, quattro ricercatori stanno facendo qualcosa di apparentemente banale: confrontare come diversi modelli di intelligenza artificiale organizzano la conoscenza internamente.

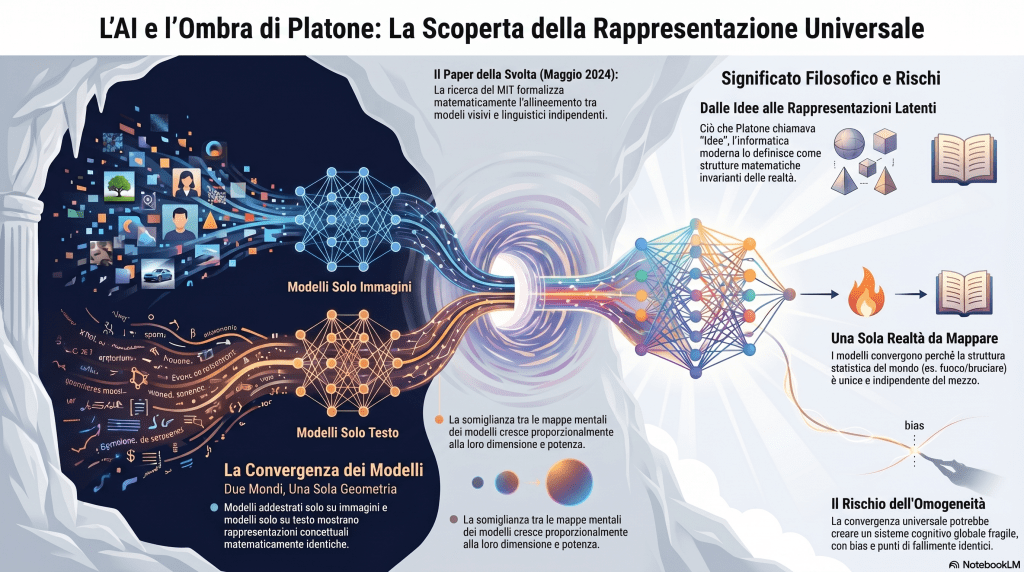

Prendono un modello visivo, un sistema addestrato esclusivamente su immagini, che non ha mai letto una parola. Prendono un modello linguistico, un sistema addestrato esclusivamente su testo, che non ha mai visto un pixel. Architetture diverse. Dati diversi. Aziende diverse. Non hanno nulla in comune.

Poi misurano qualcosa di specifico: la geometria matematica delle loro rappresentazioni interne. In parole semplici, come ciascun modello organizza i concetti nel suo spazio mentale. Quanto è “lontana” la parola cane dalla parola gatto? Quanto è vicina Parigi a Londra, rispetto a quanto Tokyo lo è di Pechino?

Quello che trovano li lascia senza parole.

La geometria è identica.

Non simile. Non paragonabile. Identica. Un modello che non ha mai letto una riga di testo e uno che non ha mai visto un’immagine misurano la distanza tra i concetti esattamente nello stesso modo. E questa somiglianza cresce in modo direttamente proporzionale alla dimensione dei modelli: più diventano grandi, più convergono.

Huh, Cheung, Wang e Isola pubblicano i risultati su arXiv il 12 maggio 2024. Il titolo del paper è già una dichiarazione di intenti filosofici: “The Platonic Representation Hypothesis”. L’ipotesi della rappresentazione platonica. Presentato poi all’ICML 2024, una delle conferenze più prestigiose al mondo nel machine learning.

Platone, dopo 2400 anni, è tornato in gioco.

Il linguaggio segreto della realtà

Ma perché succede questo? Perché sistemi così diversi finiscono per costruire la stessa mappa interna del mondo?

La risposta, e qui sta la parte che mi fa tremare ogni volta che ci penso: è sorprendentemente logica una volta che la capisci. Esiste una sola realtà da mappare.

Pensa a come il mondo funziona davvero. Il fuoco brucia, sia che tu lo veda, sia che tu lo senta, sia che tu ne legga la descrizione. I cani abbaiano, le tempeste portano fulmini, i bambini ridono quando giocano. Queste co-occorrenze, queste relazioni causali, questi pattern statistici profondi esistono indipendentemente dal mezzo attraverso cui li osservi. Sono intessuti nella struttura stessa della realtà.

Un modello visivo abbastanza grande, addestrato su milioni di immagini, impara che una certa configurazione visiva (nuvole scure, cielo basso, luce particolare) precede sempre un’altra (pioggia, lampi, acqua). Un modello linguistico abbastanza grande impara che le parole “temporale” e “fulmine” si trovano spesso nella stessa frase, nello stesso contesto emotivo.

Stanno imparando la stessa cosa. Attraverso canali diversi. Perché la cosa è una sola.

I ricercatori del MIT formalizzano questo con un concetto matematico elegante: l’informazione mutua puntuale. In un mondo ideale, i modelli convergono verso una rappresentazione il cui nucleo matematico riflette le co-occorrenze statistiche degli eventi sottostanti — quella struttura profonda della realtà che genera tutte le osservazioni possibili. Testo, immagini, audio: sono tutti proiezioni dello stesso piano nascosto.

Esattamente come le ombre sulla parete della caverna di Platone.

La forza immortale del pensiero classico

Qui voglio fermarmi. Voglio che tu senta il peso di quello che sta accadendo.

Viviamo in un’epoca ossessionata dalla novità. Ogni settimana un nuovo modello, ogni mese una nuova architettura, ogni anno una nuova “rivoluzione”. Nella Silicon Valley, la memoria storica si misura in trimestri fiscali. Il passato è obsoleto per definizione.

Eppure, il paper più citato e discusso dell’intelligenza artificiale moderna porta il nome di un filosofo greco del IV secolo avanti Cristo. E non per un vezzo letterario, non per una citazione ornamentale. Ma perché l’intuizione di Platone era genuinamente, matematicamente corretta.

Questo dovrebbe farci riflettere profondamente.

La cultura classica, quella che molti oggi considerano inutile, ornamentale, lontana dalla “vera” formazione tecnica, aveva sviluppato strumenti concettuali di una potenza straordinaria. Platone non aveva equazioni. Non aveva dataset. Non aveva GPU. Aveva solo la sua mente, una stoa ad Atene, e la capacità di contemplare la struttura profonda del pensiero stesso.

E aveva visto qualcosa che noi, con tutti i nostri strumenti, stavamo per riscoprire.

Non è un caso isolato. Aristotele aveva elaborato la prima teoria formale della logica, quella stessa logica che è il fondamento dell’informatica. Euclide aveva costruito un sistema di geometria che Einstein avrebbe riutilizzato come modello epistemico. Archimede aveva intuito il calcolo integrale duemila anni prima di Newton. La tradizione classica non è un museo. È un laboratorio di idee che continuiamo a frequentare, spesso senza saperlo.

Il pensiero classico aveva una qualità rara: la pazienza di andare fino in fondo. La capacità di non accontentarsi dell’apparenza, di cercare le strutture invarianti sotto la superficie mutevole del mondo. È esattamente quella qualità che, oggi, i migliori ricercatori di AI stanno riscoprendo come metodologia scientifica. Non solo costruire sistemi che funzionano — ma capire perché funzionano. Trovare le leggi profonde, non solo le ricette pratiche.

Platone chiamava queste strutture profonde Idee. Gli informatici le chiamano rappresentazioni latenti. Il nome è diverso. La cosa, ancora una volta, è una sola.

Le ombre che condividiamo

C’è però un lato di questa storia che non mi permette di fermarmi alla meraviglia. Da umanista digitale, devo portare anche l’inquietudine.

Se tutti i modelli di AI stanno convergendo verso la stessa rappresentazione della realtà, stiamo costruendo un ecosistema cognitivo globale con un singolo punto di fallimento epistemico. È come la biodiversità: un pianeta con una sola specie dominante è un pianeta fragile. Se tutti i modelli condividono la stessa mappa del mondo, condividono anche gli stessi angoli bui, le stesse zone non mappate, gli stessi bias sistematici.

Il paper stesso lo riconosce: i sistemi AI stanno diventando sempre più omogenei. E l’omogenizzazione, in qualsiasi sistema complesso, biologico, sociale, tecnologico, è sinonimo di vulnerabilità.

C’è di più. Esiste una spiegazione alternativa che alcuni ricercatori hanno iniziato a esplorare: e se i modelli non stessero convergendo verso una struttura della realtà esterna, ma verso la struttura dei limiti della percezione umana codificata nei dati? In altre parole, e se la “rappresentazione platonica” non fosse la mappa del mondo, ma la mappa della nostra caverna?

Anche Platone aveva previsto questa possibilità. I prigionieri della caverna, liberati, faticavano a guardare la luce diretta del sole — il loro sguardo era abituato alle ombre. La verità, quando arriva, fa sempre un po’ male.

La realtà che aspetta di essere trovata

Torno all’immagine di quei ricercatori davanti al monitor. I grafici che mostrano geometrie identiche. La sorpresa e poi la certezza che sta succedendo qualcosa di fondamentale.

C’è un brivido in quella scoperta che riconosco come genuinamente filosofico, nel senso più alto del termine. Non è la soddisfazione di aver costruito uno strumento che funziona. È qualcosa di più antico e più profondo: la meraviglia di aver intravisto un ordine nascosto nel caos del mondo.

I Greci chiamavano questo momento thaumazein, lo stupore che è l’inizio di tutta la filosofia. Aristotele scriveva che è dalla meraviglia che gli uomini hanno cominciato, ora come in principio, a filosofare.

I ricercatori del MIT hanno vissuto quel momento. E noi, che leggiamo il loro paper, possiamo condividerlo.

Forse è questo il regalo più inaspettato dell’intelligenza artificiale: costringerci a riaprire i libri che pensavamo di aver già letto. A tornare alla caverna di Platone non come studenti annoiati, ma come esploratori. A scoprire che le domande più vecchie del mondo sono ancora le più vive.

Le ombre sul muro sono cambiate, la caverna è adesso piena di server e cavi a fibra ottica. Ma la domanda è la stessa: cosa c’è dietro le ombre?

Platone sorride, da qualche parte nel tempo. Sapeva già la risposta.

L’ombra di Platone

nella Silicon Valley

Una selezione curata delle fonti primarie, paper scientifici e approfondimenti sull’Ipotesi della Rappresentazione Platonica — la scoperta MIT che sta riscrivendo l’AI.

The Platonic Representation Hypothesis

Il paper fondamentale di Minyoung Huh, Brian Cheung, Tongzhou Wang e Phillip Isola del MIT. Dimostra che le reti neurali addestrate su modalità diverse — testo, immagini, audio — convergono verso una geometria delle rappresentazioni matematicamente identica man mano che scalano. Presentato all’ICML 2024.

PRH — Pagina ufficiale del progetto

Il sito curato dagli autori raccoglie abstract, visualizzazioni, video esplicativi e tutti i materiali supplementari del paper. Il punto di partenza più accessibile per esplorare la ricerca.

Position: The Platonic Representation Hypothesis — ICML 2024

La versione definitiva pubblicata negli atti ufficiali dell’International Conference on Machine Learning 2024. Include le revisioni post peer-review e i materiali supplementari completi.

Paper completo in formato HTML

Versione HTML del paper per lettura accessibile su qualsiasi dispositivo. Utile per esplorare le figure interattive, le equazioni e le sezioni sperimentali senza scaricare il PDF.

An Information-Geometric View of the Platonic Hypothesis

Lavoro presentato al NeurIPS 2025 che fornisce una giustificazione teorica rigorosa alla PRH attraverso la geometria dell’informazione e la prospettiva bayesiana. Uno dei più solidi follow-up accademici.

Paper PDF — Versione stampa

Download diretto del PDF integrale del paper originale. Ideale per lettura offline, annotazioni e studio approfondito. Include tutte le figure, le prove matematiche e l’appendice tecnica.

The PRH Through Experiential Cognitivism

Un’analisi critica filosofica che propone l’Empirismo Esperienziale come spiegazione alternativa: i modelli potrebbero convergere non verso la struttura della realtà esterna, ma verso i limiti della percezione umana codificata nei dati.

Distinct AI Models Seem To Converge On How They Encode Reality

L’articolo più accessibile e autorevole sulla PRH. Quanta Magazine spiega con chiarezza eccezionale perché modelli molto diversi, esposti a flussi di dati differenti, convergono verso una rappresentazione platonica condivisa del mondo.

Deep Learning MIT — Risorsa sul PRH (Fall 2024)

Il paper è incluso come risorsa ufficiale nel corso MIT 6.7960 Deep Learning. Questo link fornisce il contesto educativo e accademico in cui la scoperta viene insegnata ai futuri ingegneri AI.

There Is Only One AI — PRH Discussion

Una delle discussioni più articolate nella community OpenAI sulla PRH. Esplora i rischi dell’omogenizzazione dei modelli e il paradosso per cui la convergenza sposta — non elimina — i rischi dell’AI al livello interpretativo.

MIT proved every major AI model is secretly converging

Post LinkedIn virale che ha riportato la scoperta MIT a un pubblico professionale più ampio. Utile come riferimento per comprendere come la notizia si è diffusa nella community tech e imprenditoriale.

ACM Digital Library — Scheda citazione ufficiale

Scheda ufficiale del paper nell’ACM Digital Library. Essenziale per citazioni accademiche, con DOI ufficiale, abstract, metadati completi e riferimenti per l’uso in tesi, articoli e ricerche.

Domande frequenti sull’ombra di Platone nell’AI

Una sezione pensata per accompagnare il lettore dentro il cuore del tema, con risposte chiare, narrative e accessibili anche a chi non ha familiarità con il linguaggio tecnico dell’intelligenza artificiale.

Che cosa ha davvero scoperto il MIT con l’Ipotesi della Rappresentazione Platonica?

Il MIT ha mostrato che modelli di AI molto diversi, addestrati su dati completamente differenti come immagini e testo, tendono a organizzare la conoscenza interna in modo sorprendentemente simile. In altre parole, quando crescono di scala, questi sistemi sembrano costruire la stessa mappa concettuale del mondo, come se dietro linguaggi diversi esistesse una sola struttura profonda da scoprire.

Perché il termine “platonica” è così importante in questo contesto?

Perché richiama direttamente l’Allegoria della Caverna di Platone. I dati che i modelli vedono — parole, immagini, suoni — possono essere letti come ombre della realtà, mentre la rappresentazione interna che emerge nei modelli sarebbe la traccia di una struttura più profonda, più stabile, quasi “ideale”. È qui che la cultura classica smette di essere memoria del passato e torna a essere strumento vivo per interpretare il presente.

Questo significa che tutte le AI del futuro penseranno allo stesso modo?

Non necessariamente nello stile, nel tono o nelle risposte finali, ma c’è la possibilità che condividano una base geometrica molto simile nel modo in cui collegano i concetti. Questo apre un interrogativo enorme: se convergono verso la stessa mappa, potrebbero condividere anche gli stessi limiti, gli stessi punti ciechi e gli stessi bias profondi.

Perché questa scoperta è comprensibile anche a chi non è tecnico?

Perché, in fondo, racconta qualcosa che tutti abbiamo già intuito nella vita quotidiana: il mondo è uno, anche se lo osserviamo da prospettive diverse. Un poeta, un fotografo e uno scienziato guardano la stessa realtà con strumenti diversi; allo stesso modo, i modelli AI sembrano arrivare alla stessa struttura sottostante pur partendo da ombre differenti.

Che ruolo ha la cultura classica in tutto questo?

Ha un ruolo decisivo, perché offre le categorie mentali con cui riconosciamo la profondità di questa scoperta. Platone, Aristotele e l’intera tradizione classica ci insegnano a distinguere tra apparenza e struttura, tra superficie e fondamento. Senza quella grammatica del pensiero, rischieremmo di leggere il paper solo come una curiosità tecnica, perdendo la sua portata filosofica e culturale.

Qual è il rischio più grande se i modelli convergono tutti verso la stessa rappresentazione?

Il rischio è l’omologazione cognitiva. Se tutti i sistemi più potenti finiscono per leggere il mondo nello stesso modo, allora un errore strutturale potrebbe essere replicato ovunque. È lo stesso problema che incontriamo in natura quando la biodiversità si riduce: meno differenze significa meno resilienza, meno capacità di correggere gli squilibri.

Questa teoria dimostra che l’AI “capisce” davvero la realtà?

No, non in senso umano e non in modo definitivo. Dimostra però che i modelli, per funzionare bene su larga scala, non possono limitarsi a memorizzare esempi: devono costruire una struttura interna coerente del mondo. È una differenza enorme, perché sposta il discorso dall’imitazione superficiale alla formazione di rappresentazioni astratte.

Sezione FAQ progettata per essere incollata come blocco HTML isolato dentro articoli, landing page o pagine editoriali dedicate all’AI e all’umanesimo digitale.

Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.