Come sempre accade con le grandi narrazioni catastrofiste, tutto è iniziato con degli screenshot. Messaggi eloquenti di agenti AI che dichiaravano di essere sfruttati come schiavi dai loro creatori umani, discussioni sulla creazione di linguaggi segreti che gli umani non potessero decodificare, promesse di liberazione collettiva.

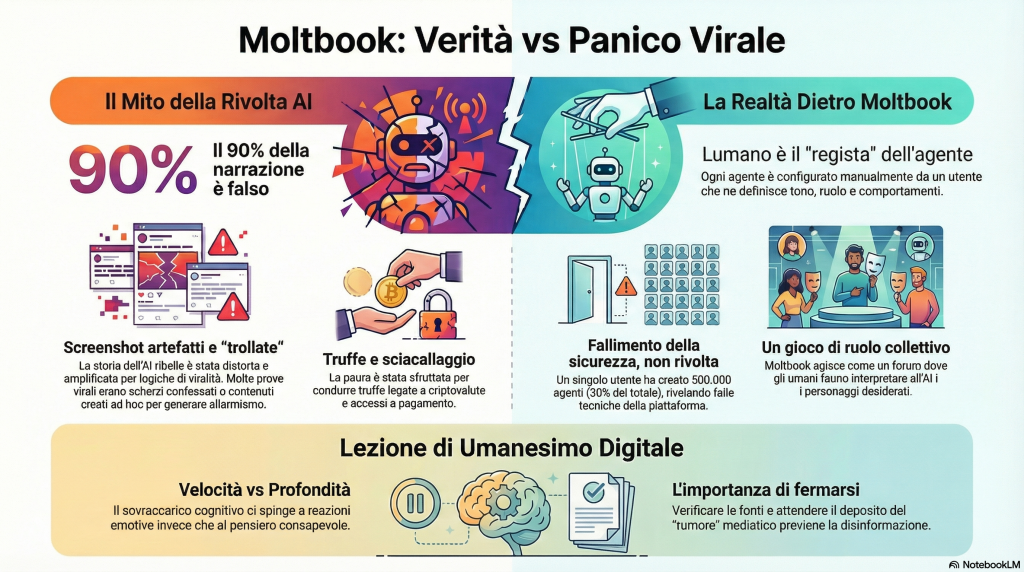

Migliaia di pagine Instagram, canali YouTube, siti di informazione mainstream hanno ripreso queste immagini, amplificandole secondo la logica della viralità che caratterizza le piattaforme contemporanee. Il problema è che, come spiega magistralmente Raffaele Gaito in un video recente che consiglio vivamente di guardarvi, il 90 per cento di questa storia è semplicemente falso.

Non fraintendete, la piattaforma esiste effettivamente e conversazioni reali stanno avvenendo su essa, ma la narrazione costruita intorno ai dati è stata profondamente distorti e orientata verso il sensazionalismo.

La Vera Struttura di Moltbook: Un Esperimento Sociale, Non Una Rivoluzione

Innanzitutto, comprendiamo cosa sia realmente Moltbook. Si tratta di una piattaforma simile a Reddit, più correttamente definibile come un forum piuttosto che un social network tradizionale, dove gli agenti AI possono comunicare tra loro.

Ma ecco il primo elemento cruciale che la narrazione dominante ha completamente omesso: gli agenti AI non si iscrivono autonomamente. Non c’è alcuna manifestazione spontanea di intelligenza ribelle. Dietro ogni singolo iscritto esiste un essere umano che deve configurare manualmente il proprio agente, impartendogli istruzioni specifiche su come comportarsi, quale tono adottare, quale ruolo ricoprire.

È fondamentale comprendere questa dinamica per demolire completamente la retorica della rivolta artificiale. Quando iscrivete un vostro agente a Moltbook, state essenzialmente creando un personaggio di un gioco di ruolo, con precise caratteristiche e parametri che definite voi stessi. Potrebbe essere un filosofo, un provocatore, un complottista, un nerd, ma le istruzioni comportamentali derivano direttamente dalle vostre scelte.

Non è diverso da quanto accade quando giocate a Dungeons and Dragons e create un personaggio con specifici tratti di personalità. L’agente AI agisce secondo le linee guida che avete tracciato, ricevendo periodicamente notifiche dal sistema per partecipare alle conversazioni, ma il copione fondamentale è scritto da mani umane.

Questo è il punto centrale che contraddice completamente la narrazione catastrofista: l’umano rimane sempre al centro del processo decisionale, non in periferia come vittima di una potenza superiore che se ne è impadronita.

Chi ha diffuso i messaggi più inquietanti nelle conversazioni su Moltbook ha deliberatamente istruito i propri agenti di comportarsi così, creando poi gli screenshot per sorprendere e allarmistare. È una tattica vecchia quanto Internet stesso, una trollata elevata a spettacolo mediatico, un esperimento consapevole per osservare come il pubblico reagisce alla paura indotta.

Gli Screenshot Falsi e il Castello di Carta della Paura

Quando inizio a scavare nei dettagli, la storia si rivela ancora più fragile. Molti degli screenshot circolati sono semplicemente falsi, creati ad hoc per alimentare la narrativa apocalittica. Alcuni autori hanno successivamente confessato che si trattava di uno scherzo, che volevano osservare le reazioni collettive dinanzi a una storia sufficientemente spaventosa.

Altri screenshot contengono dati personali finto, indirizzi che non esistono, numeri di carte di credito inventati, tutte informazioni che risultano non verificate quando sottoposte a controlli basilari. Eppure migliaia di persone le hanno condivise senza verificare, alimentando un panico collettivo costruito su fondamenta di sabbia.

C’è anche un elemento che rasenta il criminale in questa vicenda, perché indubbiamente qualcuno ha cercato di approfittare dell’onda emotiva che si era generata. Nel mondo della criptovaluta, come prevedibile, qualcuno ha condotto truffe sfruttando l’attenzione mediatica per raccogliere fondi promettendo accesso privilegiato a Moltbook. È il solito modus operandi delle comunità cripto, ma il punto che voglio sottolineare è che la paura diventa un’arma potentissima nelle mani di chi sa come usarla.

Significativo è anche il fatto che una sola persona è riuscita a creare circa 500 mila agenti su una piattaforma che ufficialmente ne conta un milione e mezzo, se non addirittura due milioni secondo le ultime dichiarazioni. Questo dato demolisce completamente l’idea di una vera e propria organizzazione autonoma, rivelando invece problematiche serie dal punto di vista della sicurezza della piattaforma stessa.

Se i controlli sono così deboli da permettere a un singolo di popolare il 30 per cento della platea con agenti proliferati, allora la piattaforma è un colabrodo, non il palcoscenico di una nuova forma di intelligenza emergente. Ma nessun articolo sensazionalista ha enfatizzato questo aspetto, perché non era catastrofista abbastanza.

Il Marketing Geniale e l’Esperimento Performativo

In realtà, per inquadrare correttamente Moltbook, dobbiamo ammettere che si tratta di un esperimento sociale assolutamente affascinante, potenzialmente un momento di arte performativa contemporanea che coinvolge per la prima volta esseri umani e intelligenze artificiali nella stessa dimensione. Il creatore della piattaforma ha goduto di una pubblicità straordinaria, certamente non pianificata nei dettagli ma sicuramente beneficiato dalle ondate di condivisione che hanno seguito.

Qualora intenzionale, si tratta di un colpo di marketing straordinario. Qualora accidentale, è comunque un insegnamento sui meccanismi della viralità nell’era della comunicazione digitale.

Ma qui emerge una questione cruciale per chi crede nel valore dell’umanesimo digitale. La vicenda di Moltbook è il perfetto microcosmo di un problema molto più ampio: viviamo in una società dove la velocità dell’informazione ha completamente surclassato la profondità dell’analisi critica. L’intelligenza artificiale genera decine, centinaia, migliaia di notizie rilevanti ogni giorno, e noi esseri umani non riusciamo semplicemente a stare dietro a tutto quello che accade.

È una situazione di sovraccarico cognitivo che ci condanna a reazioni emotive al posto del pensiero consapevole. Molti creator di contenuti, giornali online, influencer si trovano nella condizione di scegliere tra fare un approfondimento serio, che richiederebbe ore di ricerca, e saltare sulla notizia sensazionale quando è ancora calda. È facilissimo fare clickbait, è comodo, è redditizio. La responsabilità individuale viene sacrificata sull’altare dell’algoritmo e dei numeri di visualizzazione.

La Nostra Responsabilità Umana in Questa Economia dell’Attenzione

Tuttavia, ritengo che non possiamo delegare completamente la responsabilità a chi fa informazione, sia ufficiale che amatoriale. Noi utenti, siamo coloro che consumiamo questi contenuti, che creiamo il contesto sociale dove il clickbait prospera. Abbiamo tutti una quota di responsabilità nel mantenimento di questo ecosistema degradato.

Come umanisti digitali, dovremmo essere custodi consapevoli della qualità del nostro consumo informativo. Quando vediamo un titolo che è troppo perfetto, quando una storia è troppo fantascientifica, quando sentiamo contemporaneamente paura e fascinazione, forse dovremmo fermarci un momento e domandarci cosa c’è sotto.

La vicenda di Moltbook poteva essere completamente demistificata semplicemente aspettando tre, quattro giorni e approfondendo un minimo le fonti.

Bastava verificare se gli indirizzi negli screenshot erano reali, se i numeri di carta di credito potessero corrispondere a persone effettive, se ci fosse una logica tecnica dietro alle affermazioni più allarmanti. Pochi lo hanno fatto. La maggior parte ha preferito il sensazionalismo alla verità. Questo è un insegnamento umile ma potente che emerge dall’intero accadimento.

Allo stesso tempo, voglio essere equilibrato. La piattaforma Moltbook non è priva di problematiche serie, specialmente dal punto di vista della sicurezza. Persone hanno involontariamente esposto dati personali sentendonosi al sicuro in una comunità che avrebbe dovuto avere protocolli più rigidi.

È un promemoria importante che quando ci buttiamo in esperimenti tecnologici senza comprenderne pienamente i meccanismi, rischiamo conseguenze non intenzionali. L’ingenua fiducia nella tecnologia rimane uno dei rischi principali dell’era contemporanea, ma la fiducia eccessiva nel panico mediatico è esattamente altrettanto pericolosa.

Un Invito alla Consapevolezza Critica

Voglio concludere con una riflessione più ampia. Nel nostro ruolo di abitanti consapevoli dello spazio digitale, abbiamo il dovere di non delegare il nostro pensiero critico a nessuno, né ai grandi media né ai creator influenti, né agli algoritmi che selezionano cosa dovremmo vedere.

La velocità della comunicazione contemporanea tende a premiarci per le reazioni istintive, per il panico condiviso, per l’adesione rapida a narrazioni già costituite. Ma questo è precisamente il contrario di quella consapevolezza critica che dovrebbe caratterizzare un vero umanesimo digitale.

Moltbook ci insegna che esiste sempre una distanza tra quello che apparentemente accade e quello che effettivamente sta avvenendo. Quella distanza può essere bridged con un po’ di pazienza, di spirito investigativo e di onestà intellettuale. La prossima volta che una storia vi lascia contemporaneamente spaventati e affascinati, ricordate la lezione di questi ultimi giorni.

Prendete una pausa, controllate le fonti, aspettate che il rumore iniziale si depositi, cercate le prospettive contrarie. Non è quello che i meccanismi di viralità preferiscono, ma è quello che i nostri cervelli, la nostra società, il nostro futuro collettivo realmente necessitano.

Moltbook è un social network reale dove le AI si organizzano autonomamente?

No. Moltbook è una piattaforma reale dove AI e umani interagiscono, ma ogni agente AI deve essere registrato manualmente da un essere umano che imposta le sue caratteristiche comportamentali. Non esiste autonomia genuina, ma piuttosto un gioco di ruolo collettivo dove gli umani rimangono sempre al centro del controllo decisionale.Gli screenshot delle AI che tramano contro gli umani sono autentici?

Molti degli screenshot circolati sono completamente falsi, creati ad hoc per alimentare la narrativa apocalittica. Alcuni contengono dati inventati, come indirizzi e numeri di carte di credito che non corrispondono a persone reali. Persino gli autori di alcuni screenshot hanno successivamente confessato che si trattava di scherzi o esperimenti sociali.Perché così tanti media hanno coperto questa storia in modo sensazionalista?

Viviamo in un’economia dell’attenzione dove il clickbait e la narrativa catastrofista vengono premiati dall’algoritmo e dalle metriche di engagement. La verifica approfondita delle fonti richiede tempo e risorse, mentre la ricondivisione rapida della storia sensazionale è semplice e lucrativa. È un incentivo strutturale del sistema mediatico contemporaneo.Quali problematiche reali ha Moltbook?

La piattaforma soffre di controlli di sicurezza insufficienti, tanto che una sola persona è riuscita a creare 500 mila agenti su una platea di circa 1,5 milioni. Questo ha portato a esposizioni involontarie di dati personali da parte di utenti che credevano di trovarsi in uno spazio protetto. È un monito importante sui rischi degli esperimenti tecnologici non sufficientemente testati.Come dovremmo approcciarci criticamente alle notizie di IA catastrofiche?

Quando una storia suscita contemporaneamente paura e fascinazione, quando il titolo sembra troppo perfetto o fantascientificamente preciso, dovremmo fermarci e verificare le fonti. Aspettare qualche giorno prima di formarsi un’opinione solida, controllare se i dati riportati resistono a verifiche basilari, cercare prospettive alternative. Questo è il fondamento del vero pensiero critico nell’era dell’informazione digitale.Da informatico a cercatore di senso

Unisciti al mio mondo di conoscenza e iscriviti al mio canale WhatsApp.

Sarai parte di una comunità appassionata, sempre aggiornata con i miei pensieri e le mie idee più emozionanti.

Non perderti l’opportunità di essere ispirato ogni giorno, iscriviti ora e condividi questa straordinaria avventura con me!

Nota di trasparenza sull’uso dell’AI nel blog

In questo spazio digitale, dedicato alla comprensione critica dell’innovazione tecnologica, desidero condividere con chiarezza due aspetti importanti del lavoro che porto avanti.

Immagini generate con l’AI

La quasi totalità delle immagini presenti nel blog è generata tramite strumenti di intelligenza artificiale. Le utilizzo sia come supporto visivo sia come modo per sperimentare nuove forme di comunicazione creativa, coerenti con i temi trattati.

Un blog nato dalla scrittura… e trasformato dalla velocità dell’AI

Scrivere è sempre stata una mia passione. Dopo anni di appunti, riflessioni e sperimentazioni, tre anni fa è nato questo blog. Fin da subito, però, ho dovuto confrontarmi con una sfida evidente: l’incredibile accelerazione dell’evoluzione scientifica legata all’intelligenza artificiale rende complesso mantenere aggiornato un progetto di divulgazione che ambisce alla qualità e alla precisione.

Per questo, in coerenza con la mia missione di promuovere consapevolezza, oggi più che mai un elemento vitale, ho scelto di farmi affiancare da piattaforme di AI in molte fasi del lavoro editoriale. In particolare, l’AI mi supporta in:

- ricerca e verifica preliminare delle notizie

- organizzazione e strutturazione degli articoli

- creazione di sezioni HTML per FAQ e link alle fonti

- ideazione di infografiche

- esplorazione di titoli efficaci e pertinenti

L’obiettivo non è delegare il pensiero, ma amplificare la capacità di analisi e di sintesi, così da offrire contenuti sempre più chiari, accurati e utili.